La loi de modération des contenus haineux est le prochain grand texte de régulation des contenus en ligne. Le projet sera présenté au deuxième trimestre 2019. Dans une interview accordée au Figaro et un post sur le site américain Medium, Mounir Mahjoubi en a détaillé les grandes lignes.

Comment lutter contre « la haine en ligne » ? L‘arsenal de la législation est aujourd’hui dense. Depuis 2004, les hébergeurs ont l’obligation de révéler aux autorités les données de connexion de l’auteur d’un message litigieux. Ils ont par ailleurs à supprimer les contenus dits manifestement illicites. À l’époque, ces contenus se limitaient aux infractions très graves comme la pédopornographie, mais par l’effet du temps, des lois successives et de la jurisprudence, cette obligation a été étendue à d’autres faits comme les contenus attentatoires au droit d’auteur.

De plus, la loi sur l’égalité réelle entre les femmes et les hommes de 2014 a instauré d’autres obligations. Depuis, les intermédiaires doivent mettre en place un dispositif d’alerte afin que quiconque puisse leur signaler des abus de la liberté d’expression en ligne, en particulier les appels « à la haine à l'égard de personnes à raison de leur sexe, de leur orientation ou identité sexuelle ou de leur handicap ».

En 2018, le gouvernement a même introduit une infraction spécifique contre le « cyberharcèlement groupé ». Un délit destiné à sanctionner les effets de meute sur les réseaux sociaux, à savoir des propos « imposés à une même victime par plusieurs personnes, de manière concertée ou à l'instigation de l'une d'elles, alors même que chacune de ces personnes n'a pas agi de façon répétée ». Ou encore, ceux infligés à une même victime, « successivement, par plusieurs personnes qui, même en l'absence de concertation, savent que ces propos ou comportements caractérisent une répétition ».

Bien que dense, ce régime est jugé trop allégé par l’actuel gouvernement. Dans un futur projet de loi, attendu au deuxième trimestre, il entend faire adopter par le législateur de nouveaux encadrements pour purger les réseaux sociaux. « Il faut comprendre que les auteurs de contenus haineux comprennent que nous irons les chercher partout où ils sont et que nous ferons cesser leurs violences » annoncent Mounir Mahjoubi et Marlène Schiappa à nos confrères du Figaro.

Mise en quarantaine des contenus

Dans le plan d’action dévoilé par la secrétaire d’État à l’égalité et son homologue au numérique, les plateformes devront pouvoir mettre « en quarantaine » les contenus signalés. Cette obligation, inspirée du rapport Avia, frappera les contenus simplement considérés comme « illicites » par YouTube, Dailymotion, Twitter, Facebook ou encore Instagram.

C’est un glissement très important. Jusqu’à présent, comme expliqué ci-dessus, l’obligation de retrait ne concernait que les faits manifestement illicites, ceux dont l’illicéité était frappante, évidente, n’appelant à aucun autre jugement possible (une image pédophile).

Le texte va donc abaisser ce seuil de déclenchement en demandant aux réseaux sociaux de désactiver un message d’apparence louche.

Ce faisant, le rôle des intermédiaires va s’en trouver décuplé, puisqu’ils devront se mettre davantage encore à la place du juge pour qualifier la salubrité d’un contenu. Autant dire que le risque de faux positif va s’accroitre considérablement par l’effet de la loi.

Le choix du gouvernement d’opter pour une simple suspension, non un retrait définitif, ne changera rien à l’affaire, mais tout au visage des réseaux sociaux : ils auront à ne laisser prospérer que les contenus d’apparence légale, ou hygiéniques pour reprendre l’expression d’Emmanuel Macron.

La suspension sera définitive ou non, puisque ces plateformes remettraient en ligne les messages uniquement « si le signalement n’apparaissait pas justifié », dixit Mounir Mahjoubi sur Medium.

Un retrait très rapide des contenus à risque

Pour les contenus cette fois « à risque », le projet de loi va organiser une obligation de retrait « très contraignant[e] », de « quelques heures » pour les gros acteurs, avec « sanction sévère » à la clef.

Pour les plus petits, dont le seuil n’est pas connu aujourd’hui, « des obligations trop strictes peuvent conduire ces acteurs à censurer de manière excessive » concède Mounir Mahjoubi, qui n’envisage donc pas qu’un tel scénario puisse se produire sur Twitter ou Facebook alors qu’une arme de plusieurs milliers d’euros sera plaquée sur leur tempe.

Ces petits hébergeurs, en tout cas, auront des obligations plus allégées, dont aucun détail n’est fourni.

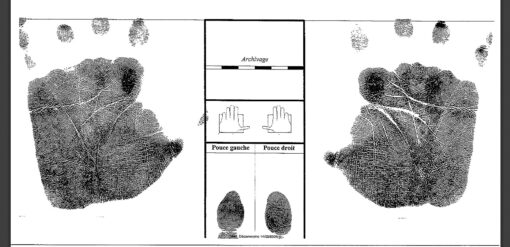

Petites ou grosses, ces plateformes devront renseigner très rapidement les données de connexion des auteurs des propos litigieux, dans un délai de quelques heures et sanctions en cas de retard.

Capacité d’appel des internautes

Et les internautes ? Dans une situation comme dans l’autre, les plateformes devront informer « systématiquement leurs utilisateurs des suites données à leur signalement, en précisant notamment si ce dernier faisait effectivement entorse aux règles de modération ».

Les auteurs des contenus dénoncés disposeront quant à eux de la capacité de faire appel, pour espérer que le réseau social change d’avis.

Pourquoi ? Tout simplement parce que les instruments automatisés ou non « commettent encore de nombreuses erreurs », admet le secrétaire d’État au numérique.

Une détection automatisée des contenus suspects

Malgré la reconnaissance de cette défaillance des systèmes de retrait, le plan d’action a déjà les yeux rivés sur la « détection automatique des contenus suspects ». Rien de moins.

Afin de rendre cet arsenal plus réactif, croit savoir le secrétaire d’État au numérique, « il existe des moyens technologiques permettant un traitement plus efficace du contenu dès sa parution – et même avant ».

Il incite en conséquence les plus grosses plateformes à « mobiliser les instruments d’intelligence artificielle qu’elles ont commencé à déployer au cours des dernières années à des fins de modération ».

Son exemple fétiche ? La tuyauterie de Facebook qui « revendique ainsi d’éliminer la quasi-totalité des contenus terroristes avant qu’ils aient pu être diffusés ». En somme, dans l’esprit du gouvernement, si cela fonctionne sur Facebook à l’égard de l’incitation ou de l’apologie du terrorisme, cela doit nécessairement marcher pour les contenus « haineux ou dangereux ». D’ailleurs ce réseau social est cité plusieurs fois en modèle sur Medium.

L’exemple de l’Origine du Monde, qualifié de pornographique et non d’artistique par les machines de Marck Zuckerberg, n’est malheureusement pas rappelé.

Le locataire de Bercy a surtout confiance en l’avenir. Et quel avenir : « les contenus haineux ou dangereux présentent généralement des caractéristiques plus complexes, mais, avec le temps, il est envisageable que les algorithmes des plus gros réseaux sociaux soient suffisamment entraînés pour en assurer une détection rapide ». Des algorithmes capables de faire la distinction entre le « lol » et les vraies méchancetés, le sarcasme, ou le flirt avec la ligne rouge ?

Mise en avant du « contenu positif » sur les réseaux sociaux

Le plan prévoit d’autres pistes, pour certaines inscrites dans la loi : les plateformes devront par exemple accompagner les victimes, « leur présenter en détail les options qui s’offrent à elles en matière de poursuites, leur proposer une mise en relation avec des partenaires associatifs ou services d’écoute ».

Elles seront surtout incitées « à pousser du contenu positif sur l’ensemble de la surface dont elles disposent, en facilitant l’accès à du contenu pédagogique » afin de sensibiliser les citoyens.

Des contenus positifs mis en avant, des contenus suspects mis en quarantaine, la scène Internet sera-t-elle aussi palpitante qu’une séquence produite par Disney ?

Coucou le CSA !

Notons que les règles de modération en vigueur pour chaque plateforme devront faire l’objet d’un audit. Un audit qui « pourrait être confié à un régulateur » explique avec pudeur Mounir Mahjoubi.

Le nom « CSA » transpire à chaque ligne puisque celui-ci est déjà en charge de la régulation des contenus audiovisuels et des « fake news ». La récente loi éponyme l’autorise à adresser aux plateformes des « recommandations visant à améliorer la lutte contre la diffusion de telles [fausses] informations », quand la directive sur les services de médias audiovisuels étend ses compétences sur les vidéos créées par les utilisateurs sur YouTube ou Dailymotion.

Le projet intègrera enfin un volet judiciaire. Exemple donné : Démocratieparticipative.biz, site raciste bloqué à la demande de la justice, mais réapparu sous une autre extension. « La multiplication des « sites miroirs », qui vident de leur portée les décisions de justice, contribue également à affaiblir nos moyens d’action : nous devrons renforcer l’efficacité de notre arsenal pour lutter contre ces contournements manifestes de notre droit et éviter de subir la réapparition de sites nauséabonds » tambourine Mahjoubi.

Rappelons que la décision de blocage, révélée par Next INpact, portait sur le nom de domaine www.democratieparticipative.biz ou « tout site comportant le nom democratieparticipative.biz ». Une formulation pour le moins malheureuse qui n’a pas empêché le site de revenir en ligne, via Tor.

Commentaires (106)

#1

#2

Eh beh … aves les gilet jaunes, ils vont avoir un boulot monstre avec cette loi !

(Cf le pigiste qui a été “confondu” avec une acteur …)

#3

Jusqu’à preuve du contraire, le nu ne représentant pas un acte sexuel n’est pas pornographique.

#4

#5

Il incite en conséquence les plus grosses plateformes à « mobiliser les instruments d’intelligence artificielle qu’elles ont commencé à déployer au cours des dernières années à des fins de modération ».

l’intelligence des milliers de philippins payés au lance pierre en secret par FB pour faire croire que c’est de l’intelligence artificielle qui filtre les contenus?

on va encore rire, tiens.

#6

Le nu est hyper répandu dans l’art quelque soit la période…. Il y a de l’art pornographique et c’est loin d’être l’origine du monde  " />

" />

#7

Twitter va s’écraser de lui même je pense. Les influenceurs vont partir d’eux mêmes et ne resteront que des communautés d’idées (plus ou moins crasses) sans aucun intérêt.

#8

Une fois de plus, les coquins pondent une loi qui par le miracle de mielleux sentiments va faire disparaître le problème qu’ils ont eux-mêmes créés, encouragés et institutionnalisés. " />

" />

Le droit à la libre expression parlée ou écrite est consubstantiel au droit de penser librement, c’est une valeur canonique. De la même manière qu’on ne peut accepter la physique en rejetant la gravité, on ne peut pas/plus penser librement si l’expression est arbitrairement limitée.

Mais c’est le but, diront-les plus téméraires…

#9

#10

#11

Le mot omis mais opératif est « LIBREMENT » : ne pas pouvoir s’exprimer LIBREMENT est en effet une atteinte à penser LIBREMENT.

On nous aurait menti quand on nous affirme que les réseaux sociaux sont les fabriques ultimes à l’individualisme forcené ?

A-t-on réfléchi au fait qu’il valait peut-être mieux laisser les individus s’exprimer en parole et en écrit plutôt qu’en acte ? Mais non, il vaut mieux afficher et légiférer sa fausse vertu et sa noblesse de façade, c’est tellement plus payant à court terme…

J’appelle cela de la pensée et législation gonzo.

#12

#13

#14

#15

#16

Je viens de relire mon Larousse. Il dit que la pornographie relève de la Présence de détails obscènes dans certaines œuvres littéraires ou artistiques…

Du coup je vais lire ce qu’est l’obscène : qui blesse ouvertement la pudeur, surtout par des représentations d’ordre sexuel ou scatologique…

Si notre brave Gustave Courbet blesse la pudeur de certains en 2019 nous sommes tombés bien bas dans notre société !!!!

#17

Je suis également curieux de savoir comment un nu peu relever du domaine de la pornographie… étant entendu que la vulgarité n’est par définition pas de la pornographie !

#18

Parce que l’art permet de percevoir au delà de ce que les 5 sens perçoivent : par exemple, quand Van Gogh fait son autoportrait, ce n’est pas son visage qu’on voit. Une oeuvre d’art est sensée représenter autre chose que le factuel.

NB: “l’Origine du Monde” n’est pas pornographique car la pornographie est sensée provoquer une excitation sexuelle… il me semble, cela-dit chacun ses fantasmes.

#19

De mémoire, pour la classification pour les films utilise un critère assez intelligent qui est celui du but de provoquer l’excitation chez celui qui voit l’image.

Un nu artistique, des tribus qui vivent à poil =/= porno.

Un type qui se pougne avec l’air lubrique, une cam-girl qui se dandine -> porno.

Edith : et forcément, à quelques secondes près, il faut que ça sente le barbecue …

#20

Concernant les filtrages de facebook, c’est un peu plus compliqué qu’un problème algorithmique : c’est aussi et surtout un problème de culture, avec des milliers de “digital labours” indo-asiatiques qui interprètent des consignes nord-américaines dans un cadre moral pseudo-normatif. Autrement-dit, Facebook ne modère pas, Facebook ne filtre pas, ou alors Facebook le fait très mal, vraiment très mal (et sans compter que Facebook se complaît très bien dans ses “erreurs”).

#21

La posture pseudo morale de toutes ces agitations politico-législative est basée sur un modèle simpliste de psycho-sociologie appelé GAM (ou General Aggression Model) qui présuppose que l’exposition répétée à des contenus violents pourrait favoriser l’émergence de pensées agressives et donc la survenue de schémas cognitifs, émotionnels puis comportementaux violents/agressifs.

Ce qui est ironique mais surtout révélateur est que sur la base de cette hypothèse, est que les personnes supportant cette pathologisation de jure des comportements sont les mêmes qui soutiennent, correctement cette fois, que les études sur les jeux violents ne montrent ni association ni encore moins d’augmentation entre exposition à la violence et un comportement agressif.

D’où on peut conclure que :

1/ la proposition du modèle est fausse ;

2/ les individus qui la soutiennent et la nient en même temps™ sont incohérents et dangereux.

#22

#23

#24

Ce projet de loi serait donc un projet de loi contre la connerie humaine … ? (en gros)

" />

" />

" />

" />

z’ont pas fini de ramer les gars qui vont devoir faire le tri.

.

#25

#26

J’avoue que, d’un point de vue purement technique j’ai du mal à voir comment ils veulent faire.

Ou alors le but est _juste_ de “masquer” au plus grand nombre et aux moins averti . Comme hadopi, un peu , sachant que les contenus “migrerons” en dehors des plates-forme majeures comme twitter & facebook , qui deviendront alors peut-être le myspace ou l’AOL du futur :-)

En fait ce genre de loi ne se situe quand dans un monde où il n’y aurait plus que des grands acteurs sur le net - et que , bien sur, ces grands acteurs tiennent compte de la fRance. Un peu comme ils tiennent compte de la russie & de son président , en fait -https://www.capital.fr/lifestyle/la-russie-sembourbe-dans-le-blocage-de-telegram… .

Donc oui, ça va emmerder (à peine) les gros acteurs, surtout OVH et d’autres hébergeurs, et en touchera une sans faire bouger l’autre aux acteurs visés. Et comme ça on sera bien sur qu’aucun service ne prendra le risque de ce lancer en France (surtout quand il est tellement simple de se lancer ailleurs).

J’espère par contre que la banalisation du filtrage des contenus sur les grandes plateforme va permettre l’émergence de plateformes a-centrées : Dans un contexte de grande contestation sociale et de fortes divergences d’opinion quant à l’avenir de la société, la tentation de la censure et celle de ne laisser que la “voix du gouvernement” sera très forte si les outils législatifs sont prêts.

#27

Pour ce qui est de l’appel à la participation des internautes, moi je rêve d’un bouton obligatoire, au design standard et unique reconnaissable parmi la charte graphique des sites (réseaux sociaux, forums, tout site ouvert aux commentaires) qui permette en 1 seul clic suivi de confirmation de signaler le contenu aux modérateur. Et un second clic+confirmation le signalerait à internet-signalement.gouv.

#28

Le meilleur moyen de lutter efficacement contre la haine est d’accepter qu’actuellement seul la haine n’est capable de changer les choses et de faire en sorte pour que ça change vraiment ! Je me souviens bien la dernière fois que j’ai utilisé “ la haine”, ça m’a permis en moins de 10 minutes de régler un problème administratif qui après 10 rendez vous “non haineux” n’ont servis à rien.

#29

Cette loi est dangereuse car on ne peut pas masquer des contenus de façon arbitraire, mais ceci-dit personne ne propose d’alternative credible pour le moment…

Il ne faut pas se voiler la face, il y a de vrai comportements toxiques sur les réseaux sociaux, et cela bousille la santé de beaucoup…

Le problème principal de la modération sur internet c’est que les flux de commentaires sont immenses…

Ne faudrait-il pas revenir à un système hybride de modération à priori / à posteriori :

#30

#31

et qui juge ce qui est toxique ou non ?

#32

#33

Comment l’ imposer ?

Par la loi tout simplement je dirai

On a besoin de règles (Et qui ne soient pas arbitraire comme la loi dont parle l’article)

Évidemment on ne pourra pas imposer ça a tout les sites du monde : Mais si on peut au moins imposer ça aux grosses plateformes ça serait un début…

De plus, ma proposition n’est pas centrée que sur le répressif

Quand à l’éducation : L’un n’empêche pas l’autre : Après il ne faut pas se leurrer, l’essentiel de l’éducation est assurée par la famille, même si l’école en fait beaucoup plus ça ne fera pas drastiquement diminuer la toxicité d’internet…

#34

Comme, OB l’a souligné, plusieurs plateformes mettent déjà en place ce genre de modération

Il ne me semble pas difficile d’identifier les comportement toxiques (harcèlement, insultes, diffusion d’information non-sourcées etc)

Ce qui est sur c’est qu’on ne peut pas rester dans la situation actuelle

#35

#36

#37

#38

#39

De mon point de vue, il y a deux niveaux de lecture :

On peut déjà débattre sur le 1er point, avec les évolutions apportées ces dernières années, et il y aurait pas à dire. Mais si l’on s’arrête sur le 2ème point, c’est là que le bât blesse le plus, dont cette loi qu’on nous pond n’est que le Nème avatar : c’est un glissement progressif du contrôle a posteriori par l’autorité judiciaire (indépendante, en tout cas le plus possible) vers un contrôle a priori par l’autorité administrative (donc l’État, donc l’exécutif), avec le filtrage d’éléments peut-être illicites mais c’est pas sûr.

Quand kevinz parle “d’un état qui s’autorise à être le seul juge…”, c’est bien ce qu’il souligne en creux. Or ce cas de figure (police administrative a priori) ne garantit plus une réelle liberté d’expression. C’est l’arbitraire d’un État, c’est le glissement vers l’autoritarisme. D’ailleurs, l’utilisation du mot hygiène est tout sauf anodin.

#40

“loi contre la haine” … C’est bien beau tout ça, normal de sanctionner les propos complètement délirants.

Le problème est que leur interprétation de “haine” est complétement aléatoire. Est “haine” ce qui les arrange.

Comme la loi “Anti Fake-News”, c’est une atteinte de plus à la liberté, celle de s’exprimer et de penser

La haine est une émotion humaine, c’est complètement ridicule de vouloir à tout prix l’interdire.

C’est mignon de vouloir tout aseptiser et vivre dans un safe-space rempli d’amour, mais bon, y a qu’à voir le résultat …

#41

Moi qui croyais naïvement que c’était déjà réprimé …

#42

Ce qui transpire c’est surtout le mot “censure” ici " />

" />

(même si c’est plus ou moins “camouflé”)

#43

#44

#45

Ce qui serait vraiment intéressant c’est de connaitre la proportionnalité de messages haineux par rapport au volume de message global.

Il y a une différence entre le ressenti et la réalité.

J’ai vraiment l’impression qu’on est sur la même lignée que Sarkozy, un fait divers, une loi.

A noter qu’il y a quelques années, les faits divers (comme leur nom l’indique) était des entrefilets positionnées en marge des journaux. Bon ils étaient largement couverts par des sources d’information aussi primordiales que Qui Police /Detective.

Hélas avec l’arrivée des chaines d’informations en continue, il faut de la matière et de l’audimat pour remplir la grille.

#46

#47

#48

#49

Il ne faut pas se voiler la face, il y a de vrai comportements toxiques sur les réseaux sociaux…

y-en a qui n’ont pas, encore, compris : que c’est en-train de se retourner CONTRE EUX

cette histoire “de Liberté d’expression”

2)….“très bien, d’autres ” s’en chargent, en essayant de supprimer l’anonymat (ça nous pend au-nez)

déjà que dans, bcp.*, de cas ils ont, fini par réussir, à se passer du Juge (reste le juge Administratif

mais il n’intervient qu’après-coup : exemple. “on commence par interdire à quelqu’un de manif. (GJ)

puis QUAND la manif. est passée : “…ah oui, vous AVIEZ raison, on n’aurait pas dû” (grrrrr) !!!

* de + en +

#50

#51

La loi existe déjà et est appliquée, je ne vois pas ce qu’il faut de plus !?

#52

#53

#54

#55

Voilà qui paraît violent et liberticide, mais on ne civilisera pas Internet avec des demi-mesures et des incitations au logiciel libre.

Bon courage, Monsieur le Ministre !

#56

#57

#58

#59

Qu’est-ce qui n’est pas critiqué en France ? Ces tribunaux n’ont même pas de budget, et là je te rejoins sur l’état lamentable de la Justice concernant son financement.

Pour le reste, pourquoi poser la question alors ? Un homme reste un homme, qu’il soit dans une institution ou une autre : son indépendance n’est pas plus garantie dans un cas comme dans l’autre, et ses motivations non plus. L’essentiel est d’avoir une formation appropriée : la concurrence fait le reste.

Parler du régalien en France fait un peu pitié alors que c’est précisément le régalien qui est délaissé par l’État qui préfère micromanager la société.

Giscard 2.0 ? Non, plutôt Friedman 3.0

#60

Qui te dit que ce n’est pas le cas? Connait-on vraiment les motivations de Courbet quand il a peint cette œuvre?

#61

#62

#63

#64

Ne fais pas l’idiot, tu as bien compris, comme tout le monde, qu’il n’était pas question d’interdire la haine, mais son expression.

Donc rassure-toi, les haineux pourront continuer de haïr librement, mais ce sera plus compliqué de l’exprimer.

#65

#66

C’était une commande privée qui n’avait pas vocation à être exposée.

#67

Ah oui en effet. Nous sommes donc là dans un cas particulier: l’artiste était “neutre”, et c’est du côté du commanditaire qu’il faudrait chercher la motivation qui permettrait d’écarter ou non le côté pornographique de l’œuvre.

#68

Pas vraiment, la pornographie sous entends un acte sexuel visible (pénétration fellation, …).

Là il s’agit d’une œuvre érotique, elle représente le sexe d’une des prostituées favorites du commanditaire.

#69

1/ C’est précisément l’avantage : l’obtention de la « puissance financière » résulte rarement du choix de l’incompétence…

2/ Dans un cadre privé, la rémunération serait évidemment privée. Cela n’affecte en rien la question d’indépendance. Ou alors on devrait remettre à plat l’ensemble de la justice administrative.

Je ne suis pas exactement sure que le système US soit meilleur ou plus performant. Les jurys pop. par ex. rendent trop souvent des décisions émotionnelles aussi regrettables qu’une absence d’indépendance.

J’ai lu quelque part (impossible de retrouver le papier) que plus de 90 % des litiges commerciaux étaient réglés en arbitrage, lequel est essentiellement un système purement privé de recours qui apparemment fonctionne correctement (avec ses règles propres). Je ne vois pas en quoi la médiation serait moins performante ou moins indépendante quand rendue par des individus dans un cadre privé.

#70

pas prostitué, maitresse, sinon il faudrait renommer l’opéra de paris “bordel”

#71

Sans parler du fait que les médiateurs poussent souvent à un accord coûte que coûte, quitte à ce qu’une partie rogne carrément ses droits.

Exemple : créance de 20 000 ; tu sais que le juge t’accorderait facilement 14 000, le reste étant plus discutable ; le médiateur propose de régler la situation à 6 000.

Sinon, ça se saurait si les avocats étaient assez intelligents pour proposer un accord …

#72

Tout à fait d ‘ accord , y aura toujours de l’ amour et de la haine à moins de lobotomiser les gens à base de médocs . Ce gouvernement se prend pour Dieu .

#73

#74

#75

@carbier serieusement, essaye de lire un peu entre les lignes et essaye de comprendre ce qu’on te dit, la tu traite tout le monde de naïf sous pretexte qu’on ne pense pas comme toi, c’est juste puéril et ca fait perdre de la valeur à tes propos aux yeux de tout le monde.

Entièrement d’accord avec le discours de l’Etat qui joue à Dieu, il y aura toujours des gens haineux, ca sert a rien de se battre contre le vent. Interdire l’expression publique ne sert qu’a conforter l’opinion de ceux qui sont dans l’erreur. Suffit de voir les résultats de la loi Gayssot, par exemple. La vraie solution réside dans la bataille ouverte d’arguments. Faut arreter de prendre les gens pour des neuneus incapables de penser par eux meme.

#76

Juste parce que tu as l’air d’être un spécialiste des insultes et messages haineux sur les réseaux sociaux, quelle est le ratio message normal/insulte sur ces dits réseaux ?

#77

#78

#79

#80

Ça change tout quand la sanction est immédiate

Et tout à fait en phase avec crocodule. En suivant ton raisonnement on a plus qu’a refiler le législatif à Facebook. Les gens y expriment des idées hop un algorithme qui pond un texte de lois. Pas con?

#81

#82

#83

#84

#85

#86

#87

#88

#89

#90

#91

Son exposition dans un lieu publique peut pour certains être du registre de la vulgarité !

#92

#93

#94

https://www.youtube.com/watch?v=BiYQ5Wco3y0

#95

#96

putain carbier tu me les brises, j’ai ni fesses de bouc, ni touiteure, je hais ces saloperies de resosocios la mort du net que j’aimais quand on était qu’entre nous, ce qui permettait des échanges beaucoup plus civilisé, ramenez moi en 1993 avant que les produits de banlieux et autres gros cons grace à free accèdent au net! Comme ça c’est claire? tu vas arretté une bonne fois pour toute de penser que je zone dans les poubelles du net! c’est peut etre tes habitudes mais pas les miennes!!!

Et non je ne veux pas que ma liberté de paroles soit bridé par une minorité de connard devenu audible grace à la démocratisation du net…ce qui entre nous arrange bien une autre minorité de connards au pouvoir qui veulent tout lissé afin de s’y maintenir..je veux voir qu’une seule tête et que ça file droit, en toute démocratie, mais pas trop quand même!

Je constate que ta définition de l’esprit des lois de Montesquieu t’échappe, apparemment en cours de philo on ne t’a fait lire que considérations sur les causes de la grandeur des romains et de leur décadence.

C’est bien dommage, dans l’esprit des lois on t’apprends des trucs sympa comme la séparation des pouvoir, mais c’est vrai que dans ta version hygiénique de la démocratie, t’as tendance à ne comprendre qu’un seul pouvoir, le législatif et le judiciaire pouvant, l’un etre regroupé avec l’executif, et l’autre vendu aux gafa.

Tu vois je pensais réellement que n’ayant pas des opinions similaire nous pouvions discuter, mais décidément non…tu fais parti des ces ultras libéraux pret a vendre la democratie pour leur prore profit

tiens, vais aller voter les trous de bal de la trinité aux prochaines elections rien que pour te montrer l’interet de toutes ces belles idées liberticide

Parce que bon, à l’imitation il vaut toujours mieux préférer l’originale!!!

#97

#98

Si on ne voit que des conneries sur les réseaux sociaux faut peut être changer “d’amis” et de “pages” qu’on fréquente… C’est un RESEAU. C’est toi qui le construit. Y’a des groupes de cons et des groupes de gens intelligents. Y’a ton groupe de connaissance avec qui tu partages rarement des fake news et autres engueulades, vu que bin, ce sont les gens que tu fréquentes quotidiennement. Et il y a les espaces publics (commentaire Le Monde, RT, BFM, groupe de platistes…), qui n’ont rien d’inhérents aux réseaux sociaux ; c’est l’extension des sections commentaires qui existaient déjà sur d’autres sites, extension du PMU, du repas de famille où personne n’est d’accord… Si on ne VEUT PAS risquer de se faire insulter en ligne, bin on ne RACONTE PAS sa vie sur des espaces publics, ou alors on assume ; comme en vrai.

C’est facile de critiquer un outil qu’on utilise pas. Mais je suis d’accord que ce sont des lieux favorisant les débordements à cause de l’effet de masse. Mais ça, encore une fois, c’est social, pas numérique.

#99

Puisque vous m’avez toustes l’air très concerné-e-s, je tiens juste à préciser que j’ai distribué hier une dizaine de CD du documentaire sur Aaron Swartz et je vous encourage à en faire autant si ce n’est plus (et ce quelle que ce soit “votre” communauté).

#100

#101

#102

Nos heures sombres ne doivent pas nous détourner du sens de la vie.

:-I

#103

#104

c’est vrai, vous n’applaudissez pas des 2 mains a toutes les lois liberticides passées depuis 10ans, mais ce n’est pas grave, ils ne sont pas fachos, ils en ont juste les lois, relis Montesquieu!! Ils expose les fondements de ce qu’est une démocratie, et dedans il y a clairement la SEPARATION DES POUVOIRS.

Il y a quoi qui te dérange tant la dedans? c’est vulgaire, c’est pas nouveau monde disruptif start up nation?

Et non je vote pas le loup pour faire peur au berger, je suis tout simplement l’ecolo qui libere l’ours, juste pour vous faire chier!

C’est pas toi qui dernièrement nous disais qu’il y en avait marre de benala? Bizarre la justice INDEPENDANTE, et non un truc administratif vient de le coller en taule…et je veux que ce genre de chose soit encore possible. C’est injurieux?

#105

#106

https://www.youtube.com/watch?v=X9D7h5OlTo0