Le 25 juillet dernier, le CSPLA lançait une mission consacrée au filtrage des contenus. Un chantier destiné à « éclairer » les autorités françaises dans les négociations sur la future directive sur le droit d’auteur. Nous publions ci-dessous le rapport qui sera présenté le 19 décembre au ministère de la Culture.

Pour mémoire, l’article 13 de cette future directive est l’objet de tous les espoirs pour l’industrie culturelle, et de toutes les angoisses pour les acteurs en ligne.

Et pour cause, il veut obliger ces derniers, lorsqu’ils stockent et donnent accès à un grand nombre d'œuvres, à coopérer avec les titulaires de droits en mettant à disposition notamment un système de reconnaissance automatisé ou toute autre technologie efficace, « appropriée et proportionnée » .

Il compte également obliger les intermédiaires à fournir aux titulaires de droits « des informations suffisantes sur le fonctionnement et la mise en place [de ces] mesures », informations accompagnées de « comptes rendus réguliers sur la reconnaissance et l’utilisation des œuvres et autres objets protégés ».

Le filtrage d’aujourd’hui, un système à l’efficacité très critiquée

Quel changement par rapport à la situation actuelle ? Aujourd’hui, chaque plateforme est libre de mettre en œuvre ou non ces dispositifs. C’est sur une base purement volontaire que YouTube a déployé Content ID, que Dailymotion a fait le choix de Signature, technologie proposée par l’Institut national de l’audiovisuel et d’audible Magic pour les parties sonores.

Ces outils n’ont pas seulement vocation à orchestrer une sorte de police privée en interne. Ils facilitent également la monétisation des titulaires de droit, du moins ceux qui n’ont pas le mot « blocage » tatoué sur le fond de la rétine.

Cependant, dans le rapport d’Olivier Japiot et de Laure Durand-Veil, commandé en août dernier par le Conseil supérieur de la propriété littéraire et artistique, les mots ne sont pas assez durs pour critiquer cet état des lieux.

Pourquoi ? Déjà, selon eux, le titulaire de droits n’est jamais assuré qu’un contenu illicite une première fois bloqué ne sera pas remis en ligne. Par exemple, YouTube sait prévenir ce genre d’atteinte, mais, aux yeux de la mission du CSPLA, « c’est sur la base d’une technologie relativement sommaire (hachage MD5, cf. infra) qui ne permet de reconnaître qu’un fichier strictement identique : tout fichier modifié même légèrement pourra échapper à ce filtrage ».

Du coup, les titulaires de droits se voient astreints à scruter ces remises en ligne sans cesse. Et encore, cette quête ne vaut que pour les espaces ouverts au public, étant quasi impossible face aux contenus échangés dans les groupes fermés sur Facebook.

Pas d’obligation de « stay down »

Au-delà de tout, les deux auteurs estiment que les juges ont trop souvent tendance à qualifier ces plateformes comme des hébergeurs, ce qui les dérange visiblement.

Cette étiquette ne permet en effet d’engager leur responsabilité que si, alertées de la présence d’un fichier illicite, elles restent inactives ou ne le suppriment pas « promptement ». Par comparaison, celui qui n’est pas hébergeur, mais éditeur, est cette fois responsable dès le premier octet de contrefaçon mis en ligne.

Ce n’est pas tout. Le 12 juillet 2012, la Cour de cassation a estimé qu’on ne pouvait astreindre ces hébergeurs à une obligation de « stay down » visant à empêcher juridiquement la remise en ligne d’un contenu une première fois notifié. La haute juridiction a estimé en effet que cela reviendrait à les astreindre à une obligation générale de surveillance des contenus stockés sans limitation dans le temps, ce que le droit européen interdit.

« Les titulaires de droits doivent donc attendre la réapparition de ces contenus sur la plateforme pour demander à nouveau leur retrait », se lamente à nouveau la mission sur le filtrage, pour qui « en pratique, rares sont ceux qui disposent des ressources leur permettant d’organiser une veille permanente afin de repérer les contenus illicites figurant sur Internet et d’en demander le retrait ».

D’autres problèmes à la pelle

Si « la reconnaissance automatique de contenus représente une piste prometteuse », d’autres soucis se posent : « Tous les titulaires de droits ne sont pas systématiquement autorisés à utiliser les outils de reconnaissance de contenus » ajoute le rapport. Ainsi :

« Facebook indique que son outil Rights Manager est réservé aux entreprises. Quant à YouTube, il évalue les candidats en tenant compte de plusieurs facteurs, comme la popularité de leurs oeuvres, le nombre de notifications-retraits qu’ils ont émises et la qualité de ces notifications, afin de limiter le risque de retraits abusifs. »

En outre, la fourniture d’empreintes représente un coût :

« Certes, les plateformes YouTube et Facebook proposent aux titulaires de droits de réaliser elles-mêmes les empreintes des oeuvres à protéger, s’ils acceptent de les leur fournir. Ceci permet notamment de faire de nouvelles empreintes en cas de mise à jour de l’outil, pour contrer les tentatives de contournement mises en oeuvre par les pirates. Mais les plateformes n’offrent pas de véritables garanties quant au risque de fuite accidentelle des œuvres originales ».

Les problèmes s’en retrouvent démultipliés puisqu’il n’y a pas « d’harmonisation des systèmes de gestion des contenus ». Enfin, la transparence des outils de détection est jugée insuffisante.

« Les capacités de reconnaissance de la technologie sont elles-mêmes difficiles à mesurer. Certes, des considérations de secret industriel, ou simplement de confidentialité pour éviter le contournement des techniques de détection, sont à prendre en compte. Cependant, les titulaires de droits sont contraints de s’en remettre aux déclarations des plateformes, sans possibilité d’expertise indépendante. »

L’article 13 de la future directive, un « progrès réel »

Après une peinture pour le moins négative de la situation actuelle, les deux auteurs en arrivent au fameux article 13 du projet de directive.

Cette fois, la prose change du tout au tout : un « progrès réel », une proposition « équilibrée et réaliste au regard des intérêts en grande partie divergents des plateformes, des titulaires de droits et des utilisateurs »...

C’est bien simple, selon le rapport, pour les titulaires de droit, c’est l’assurance de bénéficier de nouvelles garanties sur la fiabilité des outils de reconnaissance automatique des contenus. La transparence est renforcée.

Pour les plateformes ? Le texte blinderait leur réputation tout en rééquilibrant les relations concurrentielles avec les plateformes qui proposent des contrefaçons. Mieux : elle apporterait a priori une meilleure sécurité juridique. On comprend pourquoi en lisant le considérant 38 du projet de directive : celle-ci refusera le statut d’hébergeur à toutes les plateformes qui auraient le tort d’optimiser la présentation ou feraient la promotion des œuvres (notre actualité).

Pour elles, soit des pans entiers d’Internet actuellement abrités sous le statut de l’hébergeur, cette exclusion les rendrait directement coupables des contrefaçons voire les astreindraient à signer des accords de licence avec les sociétés de gestion collective…

Un renforcement de la sécurité juridique pour des utilisateurs sans droit

Pour les utilisateurs, on touche du doigt le nirvana : « ils bénéficieront, comme les plateformes, du renforcement de leur sécurité juridique lorsqu’ils mettent en ligne des contenus dont ils ne possèdent pas tous les droits ».

On voit assez mal quelle sécurité renforcer lorsqu’on ne dispose pas de droit, mais selon Olivier Japiot et Laure Durand-Veil, « leurs risques de poursuite judiciaire seront très fortement réduits puisque les contenus les plus sensibles pourront être automatiquement bloqués avant toute diffusion et que les utilisateurs concernés auront la possibilité de solliciter éventuellement l’accord de l’ayant droit par l’intermédiaire de la plateforme ».

Une réduction assez particulière, puisque ce système de filtrage saura à la volée quelle adresse IP a tenté de mettre en ligne un contenu pour lequel elle ne dispose d’aucun droit…

La mission considère aussi que cet article 13 leur permettra de bénéficier « des accords de monétisation conclus entre les plateformes et certains titulaires de droits, notamment dans le domaine de la musique, [ce] qui leur permettront de diffuser de manière licite une grande partie de leurs contenus sans avoir à demander l’autorisation préalable des titulaires de droits concernés ».

On peut rêver : ils pourront même espérer toucher des revenus lorsque l’utilisateur est lui-même devenu titulaire de droits avec la création d’un contenu. Une piste qui exige cependant une analyse un peu plus fine que le passage d’une vidéo au tamis du filtrage…

Les points perfectibles de l’actuel article 13

Quelques nuages dans ce ciel bleu néanmoins : le rapport considère que des critères un peu plus précis devraient être utilisés par le législateur européen.

Plutôt que prévoir des obligations de filtrage pour les intermédiaires qui stockent un « nombre élevé » d’œuvres, le rapport juge plus raisonnable de se focaliser sur le nombre de « vues » car « une plateforme proposant un nombre réduit de films populaires récents générant un grand nombre de consultations est plus dommageable qu’une plateforme proposant de nombreuses oeuvres que personne ne consulte. »

Le texte souffre d’autres flous. Par exemple, l’exigence de mesures « appropriées et proportionnées » risque d’être un foyer à contestation. D’ores et déjà, deux blocs censés coopérer à l’avenir s’affrontent :

« Les plateformes redoutent que les titulaires de droits, soutenus par certains États membres, se montrent trop exigeants en termes technologiques. Elles font en particulier valoir qu’elles ne seront probablement jamais capables d’identifier toutes les oeuvres sous droits, et a fortiori au sein de celles-ci d’identifier tous les droits protégés (par exemple, toutes les images ou textes apparaissant dans des vidéos). En sens inverse, les ayants droit craignent au contraire que les plateformes ne soient tenues qu’à une obligation très minimaliste qui ne protège pas réellement leurs droits. »

La Hadopi et l’article 13 du projet de directive

Autre cas : quand l’article 13 demande aux prestataires de services de fournir « aux titulaires de droits des informations suffisantes sur le fonctionnement et la mise en place des mesures, ainsi que, s’il y a lieu, des comptes rendus réguliers sur la reconnaissance et l’utilisation des oeuvres (…) », qu’entend-on par cette obligation de transparence ?

Pour y voir plus clair, la mission imagine de faire labelliser ces normes techniques par le Comité européen de normalisation. En France, « ce rôle pourrait ainsi être dévolu en France à la Haute autorité pour la diffusion des oeuvres et la protection des droits sur internet » avance-t-elle encore, puisque le Code de la propriété intellectuelle confère à la Hadopi une mission sur les mesures techniques de protection.

Le rapport demande en tout cas qu’il soit mis clairement fin à l’interdiction du « stay down » : « Il faudrait préciser clairement dans la directive que les plateformes doivent empêcher la remise en ligne du contenu contrefaisant », et ce afin de contrecarrer ces juges qui osent encore s’appuyer sur la directive de 2000 sur la société de l’information, laquelle interdit la surveillance généralisée qu'implique cette technique.

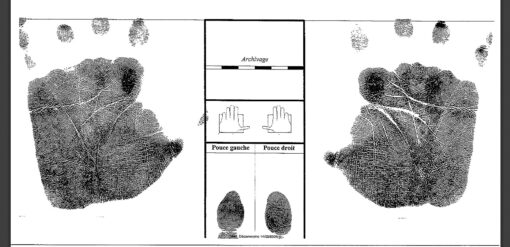

Et pour couronner le tout, il souhaite que « les dispositifs techniques mis en place par les plateformes permettent la réalisation simple et gratuite des empreintes numériques (ou plus généralement l’identification des oeuvres à protéger), sans imposer de renouvellement trop fréquent de celles-ci, notamment en permettant le dépôt de copies des oeuvres en qualité dégradée (par exemple en noir et blanc ou sous forme d’extraits), à charge pour la plateforme de mettre à jour automatiquement les empreintes (comme le fait par exemple YouTube) ».

Un blocage pro actif, et des assignations en justice facilitées

L’article 13 prévoit un régime permettant aux internautes de contester les décisions de filtrage. La mission a sur ce point une riche idée. Déjà, « il serait souhaitable que les plateformes écartent automatiquement, au moins à un premier niveau, les contestations les plus fantaisistes », celles par exemple fondées sur l’achat préalable d’un CD ou DVD, avant la mise en partage d’une œuvre.

De plus, les plateformes devraient « exiger que les utilisateurs, lorsqu’ils contestent un blocage, qu’ils fournissent leur nom et leurs coordonnées téléphoniques et postales, en vérifiant au minimum leur identité (par la transmission d’une copie d’une pièce d’identité) ».

Intérêt ? Les titulaires de droits pourraient plus facilement « vérifier leur licence éventuelle et, dans l’hypothèse où une suite judiciaire s’avèrerait nécessaire, disposer des informations minimales en vue d’une assignation ».

En somme, l’article 13 permettra - paraît-il - de renforcer la sécurité juridique des utilisateurs sans droit, mais le rapport du CSPLA en profite pour faciliter les actions en justice à leur encontre : leurs données personnelles pourraient être fournies sur un plateau aux avocats des ayants droit.

Ce rapport, dont le contenu n’engage que ses auteurs, sera présenté demain au Conseil supérieur de la propriété littéraire et artistique. On pourra le télécharger ci-dessous (MàJ 17h47 : nos confrères de Contexte ont également sorti ce document la semaine dernière).

Commentaires (14)

#1

…. leurs données personnelles pourraient être fournies sur un plateau aux avocats des ayants droit…

“100 balles et un Mars, non” ?

#2

La vache, c’est triste … des mesures royales pour les ayants-droits, de la vaseline pour les utilisateurs. Il y a quelques années j’avais encore bon espoir sur l’évolution du droit d’auteur …

#3

Oui, c’est du foutage de gueule. Mais le Conseil supérieur de la propriété littéraire et artistique va trouver ça génial: je prend les paris ! A ce niveau, on ne fait pas réaliser une étude sans être certain à l’avance des conclusions.

#4

Pour les utilisateurs, on touche du doigt le nirvana : « ils

bénéficieront, comme les plateformes, du renforcement de leur sécurité

juridique lorsqu’ils mettent en ligne des contenus dont ils ne possèdent

pas tous les droits ».

Enorme !!!!

On voit bien le but , ici : que les ayant-droit disposent d’une voie légale (et contraignante) d’aller siphonner les GAFA, en dehors de toute procédure contradictoire que ce soit.

(Et accessoirement, toucher du pognon même pour le contenu qu’ils ne possèdent pas , après tout là où il y a de la gêne il n’y a pas de plaisir….)

Accessoirement, courir des mois après des particuliers pour toucher 3 francs 6 sous et une efficacité nulle en terme d’image et de menace…

#5

“Sous-titre filtré”

" /> NextINpact n’est plus sûr

" /> NextINpact n’est plus sûr  " />

" />

#6

Personnellement je ne vois pas comment de telle mesures pourraient être efficaces :

Ici ce sont les conséquences du problème qui tentent d’être résolue et non la source du problème elle même… comme bien souvent.

#7

C’est carrément festival!!

Et réduire la période du droit d’auteur pour diminuer la charge des oeuvres illicites à reconnaitre ça été évoqué?

#8

#9

La même rengaine, ad nauseam :

« Payez-moi très cher pour avoir l’insigne distinction de récolter l’obligation de faire gratuitement mon travail à ma place. »

#10

Oui enfin c’est un rapport financé hein, donc forcement partisan. Moi j’attends l’étude qui dit qu’il faut une plateforme où tout l’audio-visuel quel qu’il soit soit disponible sans délai aucun, un peut comme pour la musique (c’est fou, je ne connais plus personne qui pirate de la musique), et on réglerait enfin le “problème”.

#11

5 ou 10 ans serait plus raisonnable de mon point de vue.

#12

Encore une belle rigolade la part de l’exception culturelle Francaise

#13

@ Ami-Kuns

Plus ou moins 30 ans, c’est déjà pas mal, Les nouvelles générations apprécient d’autre chose et ne savent pas tout acheter (un jeu à 60 €, coûte déjà quelque CD ou films en moins acheté). Une Médiathèque musicale ou de film ou séries, dépasse en quantité énorme ce qu’il y avait, il y a 50 ans. La redevance, doit lâcher prise, l’augmenter sans cesse est une escroquerie. Ne dit-on pas l’abondance diminue la valeur ? (ou plutôt l’inverse, “que la rareté augmente sa valeur”. Les deux dans le même sens ne peut marcher ). Un jour où l’autre, ça va péter

Les jeux électroniques n’auraient pas existé, la vente de cd, films, aurait été plus importante. Les invasions de sauterelles meurent quand elles ne trouve plus de nourriture. Les artistes se retrouvent dans le même cas. il ne peut y avoir plus de blé

#14

Ils sont gravement atteints.

Aller au point de craindre une potentielle « fuite accidentelle des œuvres originales » par les plateformes et donc les obliger à une efficacité maximale de blocage par des originaux DEGRADES qui donc va forcément nuire à cette même efficacité, c’est très fort. Je voudrais bien connaître le nom de la drogue qu’ils ont consommé, histoire d’éviter.

On croirait un remake de la discussion de loi sur le droit d’auteur où le rapporteur refusait d’entendre parler d’une exception aux droits pour les associations concevant des livres pour personnes aveugles, sous prétexte d’un risque de « fuites »… Déjà là le caractère rapace était très prononcé.

Prétendre que les utilisateurs auront une sécurité juridique renforcée mais oser exiger de leur part leur identité s’ils daignent faire une contestation et cela en vue d’une potentielle assignation, c’est aussi très fort. J’aimerai déjà voir si ça passerait devant un tribunal car on ne peut pas s’inculper soi-même, or là c’est tout comme… Et ça montre qu’ils sont davantage que des rapaces.

En tout cas, ils auraient fait de très bons agents au temps de la Sta[censuré pour éviter des déboires juridiques].