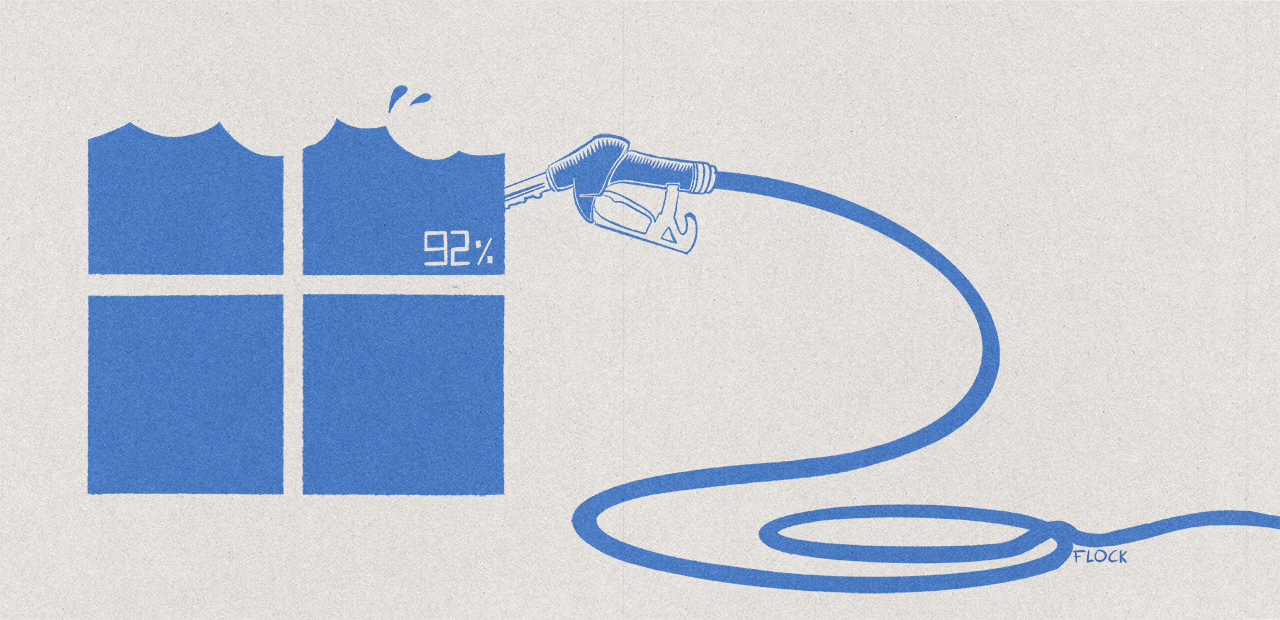

Un projet de règlement de la Commission européenne, que le Sénat s'apprête à discuter, veut faire surveiller, par des IA, l'intégralité du web, des emails et messageries chiffrées, afin d'identifier les « violences sexuelles sur mineurs ». Au-delà de son impossibilité technique, la proposition ferait de nombreuses victimes collatérales.

En mai 2022, la Commission européenne présentait une nouvelle proposition de règlement « visant à prévenir et à combattre les abus sexuels sur les enfants en ligne », afin d'obliger les fournisseurs de « certains services » à « détecter, signaler et retirer les matériels relatifs aux abus sexuels commis sur des enfants dans le cadre de leurs services » :

« Les obligations de détection concernent le matériel connu (photos et vidéos rechargées qui ont été précédemment repérées comme constituant du matériel relatif aux abus sexuels sur les enfants), le matériel nouveau (photos et vidéos qui n'ont pas été précédemment repérées) et le pédopiégeage (ou "grooming", une pratique selon laquelle les auteurs d'abus sexuels sur les enfants tissent une relation de confiance et un lien émotionnel avec des enfants afin de les manipuler, de les exploiter sexuellement et de les abuser). »

La Commission précisait que seraient concernés les « services d'hébergement et les services de communications interpersonnelles (tels que les services de messagerie), les boutiques d'applications et les fournisseurs d'accès à l'internet », comme le précise le projet de règlement :

« Afin d’atteindre les objectifs du présent règlement, celui-ci devrait s’appliquer aux fournisseurs de services susceptibles d’être utilisés à mauvais escient à des fins d’abus sexuels sur enfants en ligne. Étant donné qu’ils sont de plus en plus souvent utilisés à ces fins, les services de communications interpersonnelles accessibles au public, tels que les services de messagerie et les services de messagerie électronique sur l’internet, dans la mesure où ils sont accessibles au public, devraient être couverts par le présent règlement. »

La proposition prévoit qu'ils « devront déployer des technologies qui soient les moins intrusives au regard de la vie privée en l'état actuel de la technique dans le secteur, et qui limitent autant que possible le ratio d'erreurs (faux positifs) ».

Une obligation de résultat et non de moyens

Le chiffrement de bout en bout (End-to-end encryption, ou E2EE) étant a priori incompatible avec de telles obligations, la Commission bottait en touche en rétorquant que ces dernières « sont technologiquement neutres, c'est-à-dire qu'elles ne précisent pas quelle technologie devrait être utilisée pour la détection », et qu' « il s'agit d'une obligation de résultat et non de moyens, qui laisse au fournisseur le choix de la technologie à exploiter, sous réserve du respect de garanties strictes ».

La Commission précisait qu' « une technologie de chiffrement peut notamment être utilisée », eu égard au fait que « le chiffrement est un outil important pour la protection de la cybersécurité et de la confidentialité des communications ».

Elle soulignait néanmoins que « cependant, des criminels pourraient abuser de son utilisation comme canal sécurisé pour dissimuler leurs actes, ce qui entraverait les efforts visant à traduire en justice les auteurs d'abus sexuels sur les enfants ».

Et ce, alors qu' « une grande partie des signalements d'abus sexuels sur les enfants [...] proviennent de services déjà chiffrés ou susceptibles de l'être à l'avenir ».

La Commission relevait que selon les estimations du National Centre for Missing and Exploited Children (Centre national américain pour les enfants disparus et exploités, NCMEC), « plus de la moitié de ses signalements CyberTipline disparaîtront avec un chiffrement de bout en bout, ce qui fera que les abus ne seront plus détectés, à moins que les fournisseurs ne prennent des mesures pour protéger également les enfants et la vie privée de ces derniers dans le cadre de services chiffrés de bout en bout » :

« Les analyses montrent que la perte estimée serait de 2 100 signalements par jour, alors que ces signalements auraient pu permettre de sauver des enfants d'abus persistants et d'empêcher que des auteurs d'abus ne commettent de nouveaux abus. »

Un processus itératif à trois niveaux

Répondant aux risques de « surveillance de masse » qu'une telle proposition d'obligations pourraient engendrer, la Commission bottait là aussi en touche, rétorquant que l'obligation de détection « ne s'applique qu'à deux types de fournisseurs identifiés individuellement : les services d'hébergement et les services de communications interpersonnelles accessibles au public » et donc, incidemment, l'ensemble des personnes visitant des sites web, ou dotés d'adresses e-mail et messageries instantanées.

Elle n'en précisait pas moins que « le processus d'émission d'une injonction de détection est très détaillé et vise à limiter les mesures à ce qui est strictement nécessaire », et qu'elle devrait franchir trois paliers successifs :

« Ce n'est que si les autorités estiment qu'il existe des preuves d'un risque important d'utilisation abusive et que les motifs justifiant l'adoption de l'injonction de détection l'emportent sur les conséquences négatives pour les droits et les intérêts légitimes de toutes les parties concernées, eu égard en particulier à la nécessité d'assurer un juste équilibre entre les droits fondamentaux de ces parties, que les autorités annoncent leur intention d'envisager une injonction de détection. »

La Commission soulignait que le fournisseur devrait en outre consulter l'autorité chargée de la protection des données dont elle dépend, et procéder à une analyse d'impact afférente, avant qu'une telle injonction puisse être ordonnée.

De plus, « ce n'est que si les autorités nationales confirment ensuite une troisième fois qu'un risque important persiste qu'elles pourraient demander une injonction à une autre autorité indépendante ou à une juridiction » :

« Ce processus itératif à trois niveaux garantit que les mesures sont limitées dans toute la mesure du possible, afin de faire en sorte qu'elles soient strictement nécessaires. »

Une détection effectuée de manière automatique et anonyme

Rappelant que « la législation impose une obligation de résultat et non de moyens », et que « les autorités nationales doivent tenir compte de la disponibilité et de l'adéquation des technologies pertinentes », la Commission concluait que « cela signifie qu'une injonction de détection ne sera pas émise si l'état de développement de la technologie est tel qu'il n'existe aucune technologie disponible permettant au fournisseur de se conformer à l'injonction » :

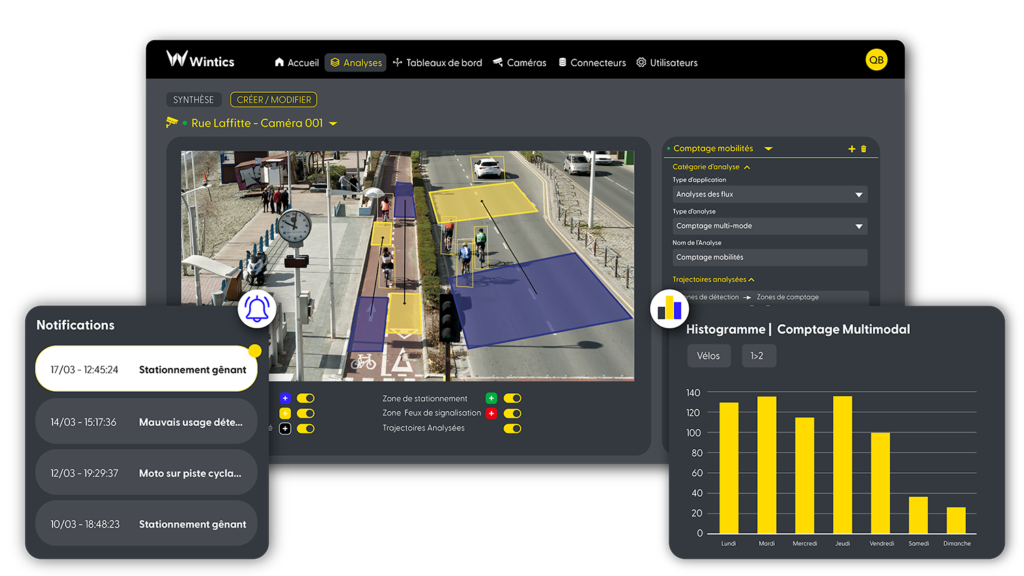

« La détection est effectuée de manière automatique et anonyme, au moyen de technologies de pointe qui garantissent la plus grande efficacité possible et réduisent au minimum l'incidence sur le droit à la vie privée des utilisateurs. »

Le projet de règlement prévoit aussi de créer un nouveau centre, placé auprès d'Europol, chargé de prévenir et combattre les abus sexuels sur les enfants. Celui-ci sera en charge d'une liste de technologies utilisables et devra consulter le Comité européen de la protection des données (CEPD) à ce sujet :

« Il est également consulté sur les meilleures manières de déployer ces technologies pour garantir le respect des règles de l'UE applicables en matière de protection des données à caractère personnel. »

Dès lors, concluait la Commission, « il résulte de tout ce qui précède que les possibilités d'émettre des injonctions de détection et de procéder à la détection sont très réduites et limitées à ce qui est strictement nécessaire, tout en évitant tout abus des pouvoirs de détection ».

40 % des personnes suspectées avaient moins de 18 ans

L'eurodéputé Patrick Breyer, membre du Parti des pirates allemand, a répertorié les nombreux problèmes que posent ce « ChatControl ». Non content de signer « la fin de la confidentialité de la correspondance numérique », à mesure qu'elle est incompatible avec le chiffrement de bout en bout, cette forme de techno-solutionnisme pourrait générer plus de problèmes qu'elle n'en résoudrait.

Breyer relève en effet que 80 % des signalements reçus par la police fédérale suisse « ne sont pas pénalement pertinents », mais relevant notamment de photos de vacances anodines montrant des enfants nus jouant sur une plage notamment. De même, en Irlande, seuls 20 % des signalements reçus en 2020 par les autorités ont finalement été confirmés comme relevant de la pédocriminalité.

De plus, souligne l'eurodéputé, et « même avec un taux de réussite de 99 %, cela signifierait que sur les 100 milliards de messages envoyés quotidiennement via WhatsApp, 1 milliard de faux positifs devraient être vérifiés », chaque jour. L'an passé, deux pères de famille américains avaient ainsi été soupçonnés, à tort, de pédophilie, pour avoir pris en photographie, à la demande de médecins, le sexe de leurs enfants.

Patrick Breyer relève également que ceux qui échangent le plus de contenus pédocriminels le font surtout sur le dark web, ou encore en s'échangeant des liens vers des archives chiffrées protégées par des mots de passe, pas en pièces jointes de courriels ou de messageries chiffrées.

Si certains le font, ils sont en outre bien plus nombreux à le faire de façon légitime et consensuelle, sous forme de sextos, y compris entre mineurs. Les enquêteurs risqueraient dès lors d'être noyés sous un tombereau de « faux positifs », ainsi que de sextos partagés entre mineurs consentants.

La police allemande relevait ainsi qu'en 2021, près de 40 % des personnes suspectées d'avoir diffusé des contenus « pédopornographiques » sur Internet avaient moins de 18 ans, une proportion encore plus importante pour ceux qui avaient été accusés d'en posséder (sans forcément en avoir diffusé, NDLR), sur leurs smartphones notamment :

« En 2021, un total de 28 661 suspects (2020 : 12 516) ont été enregistrés. Parmi eux se trouvaient 11 666 jeunes âgés de 14 à 17 ans et 3 870 enfants de moins de 14 ans. La proportion de suspects mineurs était d'environ un tiers en 2020 (cas résolus : 1 650 enfants et 3 388 jeunes) et est maintenant passée à 54 %. »

En 2021, Apple avait certes tenté de déployer un mécanisme de recherche locale d'images de violences sexuelles sur mineurs, mais fait machine arrière suite à la bronca, et « compte tenu des retours des clients, des groupes de défense des droits, des chercheurs et d'autres personnes ».

- Apple va chercher des contenus pédopornographiques dans les iPhone américains

- Pédopornographie : Apple remet ses mesures controversées à plus tard

- Des mouchards dans vos poches ?

Sauf à installer des portes dérobées dans les messageries chiffrées, on peine à imaginer comment une telle proposition pourrait être mise en œuvre par les fournisseurs de messagerie. Or, l'installation de telles portes dérobées, serpent de mer régulièrement agité par les autorités dans le monde entier, nuirait à l'ensemble de la société, et est à ce titre dénoncé, depuis des années, par les professionnels de la cryptographie et de la cybersécurité, jusqu'aux anciens patrons de la NSA ou du GCHQ, son homologue britannique.

- Chiffrement de bout en bout : la Belgique veut une porte dérobée

- Le Congrès américain s'attaque (encore) au chiffrement de bout en bout

- Les Five Eyes, l’Inde et le Japon demandent à passer à travers le chiffrement de bout en bout

Nous reviendrons, dans un second article, sur la réponse de la commission des affaires étrangères du Sénat à cette proposition de règlement européen :

Commentaires (32)

#1

J’attends avec impatience le jour où un apotre du technosolutionnisme suggèrera des algos basé sur du chiffrement homomorphe pour pouvoir détecter des contenus interdits sans avoir à déchiffrer le message… Pour ensuite devoir leur expliquer que non, ça ne marche pas comme ça et qu’ils ne comprennent rien et ajoutent “ça doit être possible, révisez votre copie, en attendant, on vous met une obligation de résultat vous avez l’habitude”

#2

On arriverait à une solution dans laquelle un couple qui partagerait par exemple une photo de leur enfant tout nu pour montrer une varicelle aurait pour conséquence la visualisation par de multiples inconnus de cette photo. C’est un peu aberrant…

#3

20 ans après : Ils sont désespérants !

#4

Poisson d’avril

#5

« visant à prévenir et à combattre les abus sexuels sur les enfants en ligne »

afin d’obliger les fournisseurs de « certains services » à « détecter, signaler et retirer

les matériels relatifs aux abus sexuels commis sur des enfants dans le cadre de leurs services »

“c’est compris, hein” !

#6

Et c’est reparti pour un tour…

Même son de cloche au Royaume-Uni:.

C’est touchant de naïveté.

#7

Obligation de résultat et IA dans la même phrase. Comique.

#8

C’est hallucinant comme cette phrase n’a aucun sens. La Commission nous explique que si aucune technologie ne permet d’effectuer une détection “qui garantissent la plus grande efficacité possible et réduisent au minimum l’incidence sur le droit à la vie privée des utilisateurs” alors la détection ne pourra être mise en place. Mais la condition est tellement flou que n’importe quelle technologie fera forcément l’affaire. “La plus grande efficacité possible” et “réduire au minimum”, ce sont des termes qui veulent juste dire qu’on doit faire au mieux selon ce qui est technologiquement possible à l’instant t. Donc si “la plus grande efficacité possible” est proche du néant aujourd’hui en utilisant la meilleure technologie disponible actuellement, la condition est donc validée (on ne peut pas faire mieux aujourd’hui) et on peut donc mettre en place la détection.

#8.1

Ça ne fait pas partie du communiqué, mais il a été généré avec ChatGPT

En pratique, quelle que soit la méthode utilisée pour écrire ce texte, c’est juste un monument de langue de bois qui ne dit juste absolument rien et donne l’illusion d’un truc réfléchi, tout en étant construit sur du vent.

#8.2

C’est pourtant simple : on doit faire du mieux qu’on peut, mais on n’est pas obligé de faire mieux que ce qu’il est possible de faire

#9

“seuls 20 % des signalements reçus en 2020 par les autorités ont finalement été confirmés comme relevant de la pédocriminalité”.

20% de délits constatés, c’est déjà bien, ça peut être dissuasif pour les autres.

100% des fouilles dans les aéroports ne donnent pas des délits confirmés non plus, on doit arrêter les fouilles pour ne pas embêter les faux positifs ?

“De plus, souligne l’eurodéputé, et « même avec un taux de réussite de 99 %, cela signifierait que sur les 100 milliards de messages envoyés quotidiennement via WhatsApp, 1 milliard de faux positifs devraient être vérifiés »,”

Et non… 99% de réussite parmi les messages suspectés, avoir 1 milliard de faux positif signifie que tous les messages contiennent une image ou un terme visé, or ce n’est pas le cas. C’est 99% des messages suspects seulement, donc beaucoup, beaucoup moins.

#10

J’ai exactement eu la même réaction en listant le titre et le chapeau.

#11

J’imagine que la feuille de route de la Commission Européenne ressemble à cela :

Étape 1 : Obligation pour les fournisseurs de services numériques d’utiliser des technologies de surveillance de masse (si elles existent) pour lutter contre la pédopornographie.

Étape 2 : Obligation pour les fournisseurs de services numériques de développer ces technologies si elles existent pas.

Étape 3 : Remise en cause du chiffrement de bout en bout pour les services en ligne d’échange de messages puisque les acteurs malveillants l’utilisent et déjouent la surveillance.

Étape 4 : Interdiction du chiffrement de bout en bout personnel (via GPG, etc.), puisque les acteurs malveillants l’utilisent et déjouent la surveillance, sauf pour les transactions économiques, l’authentification, etc.

Étape 5 : Extension régulière du champ de la surveillance de masse au fur et à mesure que le temps passe puisque si vous n’avez rien à vous reprocher alors vous n’avez rien à cacher.

Étape 6 : [Juste pour être sûr] Bien préciser que cela n’est pas un poisson d’avril !

#12

Quoi ?!!?? mais… Quoi !?!?

Ah… Si c’est pour protéger les mineurs alors d’accord.

Vous n’êtes pas contre la protection des mineurs, n’est-ce pas ?

n’est-ce pas !?

#12.1

“le pied dans la porte, quoi”…. !!!

#13

On se rappelle l’histoire de l’ïa de google qui confond photo d’enfants malade envoyé au médecin et photos “pédopornographique”. Résultat ce brave homme a été blanchi (par la police) mais google n’a rien voulu savoir et comme ce monsieur avait toute sa vie numérique chez google (personne n’est parfait) il a tout perdu

#14

Non, c’est 1% qui contiendraient à tord, un message considéré comme problématique et seraient suspects justement…

Donc 1 milliard de messages à vérifier manuellement.

#14.1

Non, on parle d’un taux de réussite de 99%, cela voudrait dire que sur 100 messages identifiés comme problématiques, 99 le sont réellement et un seul est un faux positif. On ne peut donc pas appliquer ce pourcentage directement au volume total de messages.

Néanmoins, tous les messages identifiés comme problématiques doivent être vérifiés pour écarter les faux positifs (et c’est de cette vérification qu’on déduit le taux de réussite), un algo avec un fort taux de réussite permettrait juste de gaspiller le moins de ressources possibles à vérifier des contenus innocents.

Donc quand bien même seuls 0.05% des échanges sur WhatsApp seraient identifiés comme problématiques, cela donnerait 50 millions de messages à vérifier par jour… il va en falloir, des Kényans.

Du coup, même en corrigeant le chiffre avancé, il me semble l’argument reste pertinent : le volume est juste monstrueux.

#15

Techno-solutionnisme est effectivement le mot-clé dans cette affaire. Car il me semble que le numérique permet uniquement de partager ce genre de contenu multimédia à grande échelle mais il y a toujours des personnes en chair et en os qui produisent ce genre de contenu. Et les enquêtes policières doivent justement s’attaquer à ce genre de trafic.

#16

Vu que la majorité des abus, sexuels et/ou violents, sur mineurs ont lieu à l’intérieur du cadre familial, à quand la “vidéo-protection” de ceux-ci par un ensemble de caméras dans toutes les pièces de l’habitation parentale. On vous promet que seuls les personnes désignées par les autorités pourront visionner les images, de préférence en direct ?

#17

En premier lieu, veuillez interdire la vente de téléphones portables aux mineurs…

#18

Il faut lire le paragraphe au dessus qui parle de 80% des signalements reçus puis ensuite du mêmes chiffre à 99%, c’est un politique qui manipule les chiffres en changeant consciemment de données pour appuyer ses arguments, un classique.

Breyer relève en effet que 80 % des signalements reçus par la police fédérale suisse « ne sont pas pénalement pertinents », mais relevant notamment de photos de vacances anodines montrant des enfants nus jouant sur une plage notamment. De même, en Irlande, seuls 20 % des signalements reçus en 2020 par les autorités ont finalement été confirmés comme relevant de la pédocriminalité.

De plus, souligne l’eurodéputé, et « même avec un taux de réussite de 99 %, cela signifierait que sur les 100 milliards de messages envoyés quotidiennement via WhatsApp, 1 milliard de faux positifs devraient être vérifiés », chaque jour. L’an passé, deux pères de famille américains avaient ainsi été soupçonnés, à tort, de pédophilie, pour avoir pris en photographie, à la demande de médecins, le sexe de leurs enfants.

#19

Ca tombe bien c’est souvent les parents qui l’achètent.

C’est l’usage qu’il faudrait interdire aux mineurs.

Et là, en pratique tu fais comment ? Comme pour les délinquants, tu sucres les aides aux parents des contrevenants (cad de n’importe quel mineur choppé dans la rue avec un téléphone dans la poche ?)

Le problème c’est que balancer des lois, c’est que des mots sur du papier très cher à produire. Ca ne sert à rien si on a pas les moyens ni l’envie de les faire appliquer. Ca pose la question du type de société dans laquelle on veux vivre.

Les lois qui peuvent marcher sont celles qui convaincs les gens , pas celle qui les contraignent.

#20

Ce que tu es en train de dire c’est que tu as des “agents” qui zieutent les photos de vacances de privés personnes qui n’en sont même pas avertis simplement car une “IA” les a signalé ?

Ca te choques pas ?

#21

C’est un pied dans la porte pour casser deux concepts qui emmerdent les dirigeants, toujours avides de contrôler nos moindres faits et gestes

1- La correspondance privée (très protégée juridiquement)

2 - Le chiffrement de bout en bout.

#22

De plus, souligne l’eurodéputé, et « même avec un taux de réussite de 99 %, cela signifierait que sur les 100 milliards de messages envoyés quotidiennement via WhatsApp, 1 milliard de faux positifs devraient être vérifiés »

Au niveau actuel des IA le taux de réussite serait vraissemblablement bien supérieur. C’est dommage de défendre le non sens de ce projet de loi avec des chiffres sortis du chapeau alors que les arguments ne manquent pas.

#23

Je crois me rappeler que récemment, un couple a été inquiété parce qu’une photo prise pour le médecin est partie dans la nature.

#24

Il suffit d’interdire aux mineurs de créer un compte sur les RS et logiciels de chat …. ça tombe bien on va voir arriver une “superbe” méthode pour prouver qu’on est majeur.

#25

Ca donne presque l’impression que le but recherché est que la moitié de la population surveille d’autre moitié…

Surtout que là on parle “juste” des services centralisés qui coopèrent avec ce système : Aujourd’hui on peux créer des services a-centrés aussi - surtout avec la 5G qu’on nous vend :-)

#26

Quel est sérieusement le rapport entre internet et les violences sur mineurs ? Les violences sur mineurs existaient avant Internet et Internet ne permet pas de violence sur mineurs (enfin perso je ne comprends pas comment…)

Internet c’est un simple média, avec ce genre de raisonnement on peut tout interdire :

#27

Toujours le pretexte de la pédophilie pour réduire les liberté… c’est lassant. Avant ils essayaient de varier avec le terrorisme et le narcotrafique, maintenant ils ne font même plus d’efforts pour rendre leurs mensonges crédibles.

#28

Un très bel article, merci !