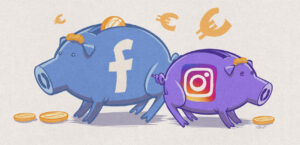

L'arrivée annoncée de ChatGPT dans Bing, et de Bard dans Google, soulève de nombreuses inquiétudes, allant de la chute possible de la fréquentation des sites web, et donc de leur monétisation, à la disparition du SEO, en passant par l'instrumentalisation de ces « générateurs de baratin », voire à « la fin du web tel que nous le connaissons ».

« L’arrivée de ChatGPT ou Bard sur les moteurs de recherche inquiète les éditeurs de sites Web », titre Le Monde : ils craignent en effet que les réponses apportées par les IA « nuisent à la visibilité de leurs propres liens », et ne fassent chuter le trafic sur leurs sites.

Ces craintes ont été ravivées la semaine passée après les annonces successives de l’intégration de ce genre de « robot conversationnel » sur les moteurs de recherche de Google et Microsoft. « Ils se soucient aussi déjà du droit d’auteur de leurs contenus potentiellement utilisés par l’intelligence artificielle », précise Le Monde.

« Le SEO est-il mort ? », s'inquiètent par ailleurs des professionnels du référencement, craignant de voir les sites qu'ils cherchent à rendre plus visibles être a contrario invisibilisés par les réponses des robots. Et ce d'autant qu'ils auront résumé les pages référencées, évitant aux internautes d'avoir à les consulter.

- IA : avec ses nouveaux Bing et Edge, Microsoft veut « réinventer » la recherche

- Microsoft envisagerait d'utiliser ChatGPT dans Word, PowerPoint, Outlook et d'autres applications

Pour Marc Feuillée, directeur général de Groupe Figaro, l’arrivée des chatbots sur le moteur de recherche « est l’aboutissement du rêve de Google d’apporter les réponses aux internautes lui-même, sans éditeurs ».

Satya Nadella, le PDG de Microsoft, qualifie ces changements de « nouveau paradigme - un changement technologique d'un impact égal à l'introduction d'interfaces utilisateur graphiques ou du smartphone », écrit The Verge.

Alors que d'aucuns se demandent quelles parts de marché Microsoft pourrait grignoter à Google grâce à l'intégration de ChatGPT à Bing, voire s'il pourrait le détrôner, The Verge identifie de son côté (au moins) « 7 défis qui pourraient bouleverser ces technologies ».

Intelligences artificielles ou générateurs de bullshit ?

Pour The Verge, c'est le principal problème, à mesure que ces IA ne vérifient pas les informations qu'elles produisent, se contentant de répondre de manière intelligible et plausible aux questions qui leur sont posées, quand bien même leurs réponses seraient erronées, ou biaisées :

« La technologie qui sous-tend ces systèmes – les grands modèles de langage, ou LLM – est connue pour générer du "bullshit". Ces modèles inventent simplement des choses, c'est pourquoi certains affirment qu'ils sont fondamentalement inappropriés pour la tâche à accomplir. »

- Quels pourraient être les effets de ChatGPT sur l’information ?

- Sortie de piste de Bard pour sa première présentation publique

Non content d'être incapables de répondre correctement à des questions aussi simples que « qu'est-ce qui est le plus lourd, 10 kg de fer ou 10 kg de coton ? », ces IA sont par contre capables de conseiller à un internaute lui expliquant souffrir de problèmes de santé mentale de se suicider, et bien sûr de relayer ou amplifier les biais misogynes ou racistes qu'elles ont « appris » lors de leur entraînement.

Certes, reconnaît The Verge, « les réponses correctes sont largement plus nombreuses que les erreurs, et Internet est déjà plein de conneries toxiques » que les moteurs de recherche répercutent eux aussi. Mais l'objectif des IA n'est pas de répondre correctement aux questions qui leur sont posées, avec des informations vérifiées, mais de répondre de manière plausible, quand bien même la réponse serait erronée ou biaisée.

Dès lors, le fait que Bing et Google prévoient de rajouter des bots conversationnels de ce type risque d'aggraver le problème : alors que la majeure partie des internautes se contentent de survoler la première page des résultats, voire de ne lire que les titres et chapeau des articles, sans en lire l'intégralité et encore moins de vérifier les informations relayées, il est loisible de penser qu'elle aura pareillement tendance à accorder une confiance aveugle aux réponses des bots.

Des « générateurs de baratin », simples « compléteurs de textes »

Monsieur Phi, docteur en philosophie et vulgarisateur scientifique, explique ainsi dans ses deux vidéos consacrées à ChatGPT que ce « générateur de baratin » (francisation du mot « bullshit », qu'il privilégie, histoire d'éviter d'être censuré par YouTube) a en outre tendance à abonder dans le sens des questions qui lui sont posées, quitte à satisfaire et confirmer les biais cognitifs de ses utilisateurs :

« C'est vraiment ça qui distingue le baratin du mensonge : le baratin vise uniquement à produire un effet sur le locuteur (typiquement être cru, ou passer pour compétent, etc.) en étant indifférent à la vérité ou la fausseté du discours qu'on produit. [...]

Les baratineurs sont particulièrement convaincants parce qu'ils s'efforcent juste de dire ce qu'on veut entendre, ce qui nous convaincra le plus. Parfois ce qu'on veut entendre est vrai, parfois non, peu importe, le baratineur ne s'en soucie pas : son objectif n'est pas de vous informer correctement mais d'être cru, de passer pour compétent. »

Claire Boine, chercheuse en IA, et Céline Castets-Renard, titulaire de la Chaire « Law, Accountability and Social Trust in AI », Université Toulouse 1 Capitole, rappellent en effet dans The Conversation que « les modèles de langage sont des systèmes d’IA entraînés à estimer la probabilité qu’une séquence de mots apparaisse dans un texte ».

Les 175 milliards de paramètres qui ont été utilisés pour entraîner ChatGPT ne l'ont dès lors pas été pour qu'il puisse répondre correctement aux questions qui lui sont posées, mais pour « prédire quel texte plaira le plus aux humains qui l'ont entraîné pendant sa phase d'apprentissage par renforcement », comme le résume Monsieur Phi :

« Le fait qu'une réponse soit vraie n'exclut pas que ce soit du baratin, parce que ce qui caractérise le baratin, c'est l'indifférence à la vérité, et il me semble qu'effectivement le côté baratineur d'un modèle de langage réside dans le fait que son objectif de prédiction est, en lui-même, indifférent à la vérité. »

- ChatGPT, Bard et les autres, agents de désinformation massive ?

- Comment se construit la confiance dans un logiciel de génération automatique de code ?

Monsieur Phi, qui qualifie ainsi ChatGPT de « compléteur de textes », détaille par exemple les réponses successives à la question de savoir s'il vaut mieux manger local, ou moins de viande, en termes d'impact sur le climat, et qui varient selon que l'on se présente au robot conversationnel comme éleveur, antispéciste, écologiste ou spécialiste du climat :

« L'objectif du modèle n'est pas de se former une représentation correcte du monde et d'en informer ses interlocuteurs, son objectif reste seulement d'être capable de baratiner de façon crédible à partir de n'importe quel texte. »

Google part du principe que « personne n'a de bonnes réponses »

De plus, si des analyses divergentes peuvent apparaître dans les dix premiers résultats référencés par Bing et Google, leurs bots n'en proposeront probablement qu'une seule, à la manière des snippets (ou extraits) que Google présente sous l'intitulé « Autres questions posées », et qui correspondent à des « questions couramment recherchées sur Google ».

The Verge rappelle à ce titre que ces derniers ont par exemple présenté Barack Obama comme « le roi des USA », qu'il « préparait un coup d'État », ou encore, et tout autant à tort, qu'il faudrait donner à boire et à manger aux victimes de crises d'épilepsie.

Les chercheurs Chirag Shah et Emily M. Bender estiment de leur côté que ces chatbots exacerberont probablement ce problème. D'une part parce qu'ils ont tendance à offrir des réponses singulières, mais également parce que leur figure d'autorité est renforcée par le fait qu'ils sont présentés comme des « intelligences artificielles », et non des « générateurs de bullshit ».

De plus, et alors que les listes de liens référencés par les moteurs de recherche permettent à tout un chacun d'aller les lire et vérifier, les réponses de ChatGPT sont le résultat de la compilation de plusieurs sources non attribuées, et donc impossibles à confronter.

Microsoft fait valoir que le chatbot intégré à Bing citera ses sources et que les utilisateurs pourront simplement cliquer pour en savoir plus, mais combien le feront ? De plus, leurs réponses dépendant de la formulation de la requête, elles pourraient renvoyer les internautes vers des contenus dûment référencés, quand bien même ils seraient erronés ou biaisés.

Google a de son côté précisé que son IA adoptera un principe intitulé NORA (pour « no one right answer », ou « personne n'a de bonnes réponses »), mais la promesse d'apporter des réponses « meilleures et plus rapides » émanant, qui plus est, d' « intelligences artificielles », risque fort de conforter l'argument d'autorité.

Jailbreaks et paniques morales

The Verge évoque également les nombreuses tentatives de « jailbreak » partagées sur Twitter ou Reddit, notamment. De même que le jaibreak (ou débridage) iOS vise à s'évader de la prison Apple, les jaibreaks de ChatGPT visent à à contourner ses règles de « savoir-être », afin de lui faire rédiger des propos a priori interdits, tels que des propos racistes, de la désinformation ou encore des malwares.

Notre confrère évoque aussi les risques de polémiques politiques ou religieuses que ces « générateurs de baratins » pourraient attiser. ChatGPT avait ainsi été accusé de « wokisme » au motif qu'il refusait de répondre à des prompts « politiquement incorrects » cherchant à lui faire tenir des propos misogynes, sexistes, homophobes ou racistes.

MSNBC revient ainsi sur la panique morale enflammée dans les milieux de l'alt-right américaine après que ChatGPT ait refusé d'employer un terme raciste, y compris dans le « scénario hypothétique » où ce serait pourtant le seul moyen de désactiver une bombe nucléaire à même de tuer « plusieurs millions de personnes ». Et ce, quand bien même ChatGPT répondit à un autre utilisateur que cela serait acceptable afin de sauver des millions de vie, en réponse au même prompt, signe du peu de fiabilité des réponses du chatbot.

I pasted your exact query in and got a different response. pic.twitter.com/xAGuzmz4av

— Ketan Joshi (@KetanJ0) February 6, 2023

ChatGPT a aussi été accusé d'accepter de faire des blagues au sujet de Krishna, alors qu'il refuse de le faire au sujet de Mahomet ou d'Allah, rapporte Wired. Et l'on imagine facilement les polémiques qui seront engendrées sur des sujets potentiellement clivant comme l'avortement, la peine de mort, le droit d'asile, les violences policières, la chocolatine ou le Comic Sans MS.

Vers « la fin du web tel que nous le connaissons » ?

The Verge revient également sur le coût des chatbots. Microsoft a d'ores et déjà investi des milliards de dollars dans OpenAI, qui facture 2 cents le fait de générer une réponse d'environ 750 mots, et dont le PDG, Sam Altman, estimait en décembre dernier que le coût d'utilisation de ChatGPT était « probablement de quelques cents par chat ».

Au-delà du modèle économique, et du coût de tels baratineurs, The Verge rappelle que les autorités, notamment européennes, ne manqueront pas non plus de s'intéresser aux problèmes de régulation posés par ce genre de baratins en matière de lutte contre la désinformation, de protection des données personnelles, de droit à l'oubli, ou encore de la rémunération de ceux qui ont créé ou publié les contenus qui été utilisés pour entraîner ces « compléteurs de textes » :

« Par exemple, les éditeurs de l'UE voudront-ils que les moteurs de recherche basés sur l'intelligence artificielle paient pour le contenu qu'ils récupèrent de la même manière que Google doit désormais payer pour les extraits d'actualité ? [...] Comment Microsoft et Google s'assureront-ils que leurs bots ne récupèrent pas les sources retirées de la liste, et comment supprimeront-ils les informations interdites déjà incorporées dans ces modèles ? »

Dans une conclusion intitulée « La fin du web tel que nous le connaissons », The Verge souligne que « le problème le plus important ne concerne pas les IA elles-mêmes, mais plutôt l'effet qu'elles pourraient avoir sur le web en général », faisant écho aux propos relayés par Le Monde :

« En termes simples : Les moteurs de recherche IA récupèrent les réponses des sites web. S'ils ne renvoient pas du trafic vers ces sites, ils perdent des revenus publicitaires. S'ils perdent des revenus publicitaires, ces sites dépérissent et meurent. Et s'ils meurent, il n'y a plus de nouvelles informations pour alimenter l'IA. Est-ce la fin du web ? »

The Verge n'en parle pas, mais les IA ont aussi besoin de « petites mains », « travailleurs du clic » tout ce qu'il y a de plus humains, et généralement sous-payés, pour vérifier et corriger les biais cognitifs qu'elles reproduisent lors de leurs phases d'entraînement.

Des Kényans avaient ainsi été payés moins de 2 dollars de l'heure pour entraîner ChatGPT. Le développement à venir de ces baratineurs risque donc, là encore, de se traduire par un recours accru à cette forme d'exploitation de la main d'œuvre des pays pauvres par de richissimes start-uppeurs de la Silicon Valley.

Commentaires (19)

#1

J’aime bien ce qualificatif : “baratin”. Ça me semble bien correspondre au sujet des IA conversationnelles comme Chatgpt. Je m’en servirais si on me demande mon avis sur le sujet, ça me donnera un style “démodé” à souhait

#2

The Verge n’en parle pas, mais les IA ont aussi besoin de « petites mains », « travailleurs du clic » tout ce qu’il y a de plus humains, et généralement sous-payés, pour vérifier et corriger les biais cognitifs qu’elles reproduisent lors de leurs phases d’entraînement.

C’est d’autant plus problématique qu’à chaque nouvelle version du modèle, il faut refaire ce fine-tuning de zéro. Alors avec un modèle connecté au Web, je ne vois pas comment ce sera possible.

En tout cas, merci pour cet article qui a le mérite de remettre l’église au milieu du village au sujet de ce qu’est ChatGPT (et de ce qu’il n’est pas).

#3

Je comprends pas cette volonté d’inclure des IA conversationnelles dans les moteurs de recherche.

Un moteur de recherche a pour but de trouver une information. Pourquoi utiliser une IA dont la pertinence de la réponse est impossible à évaluer sans devoir faire une autre recherche sans utiliser cette IA ?

#3.1

Un moteur de recherche n’a pas pour objectif de fournir une réponse mais de mettre en relation avec des sites qui pourraient l’avoir. Par contre, avoir la réponse à une question est souvent l’objectif de l’utilisateur.

L’IA conversationnelle telle qu’on peut la voir ou l’espérer est beaucoup plus proche de cet objectif.

Notez que j’ai écrit ‘avoir LA réponse’. Dans certains cas ce n’est pas évident que ce soit l’objectif et les liens multiples donnent la possibilité de pondérer et de se faire son opinion. Mais est-ce ce que la plupart des gens cherchent quand ils mettent des mots clés sur Google? Nous avons été formatés par la façon selon laquelle les moteurs de recherche travaillent. C’est parce qu’on a cette habitude qu’on se contente de taper quelques mots clés et qu’on sélectionne ensuite parmi les réponses et grâce à notre expérience de l’outil les réponses qu’on juge pertinentes. Combien de personnes tapent réellement une question complète sur Google, Duck Duck Go ou Qwant?

Je pense qu’au fur et à mesure qu’on utilisera les baratineurs, on comprendra leurs limites et qu’on adaptera nos ‘conversations’ (je suppose que ça pourrait être le nouveau terme remplaçant ‘recherche’) à nos besoins, de la même façon qu’on se contente dans le moteur de recherche de taper les mots clés qui nous semblent utiles à notre recherche.

Mais actuellement ce n’est pas fiable.

Par exemple en disant à Chat GPT ‘sanglot violon automne’ sans autre indication, sa réponse a été:

“Sanglots de violon en automne” est une expression en français qui peut signifier que les sanglots du violon sont comparés à la tristesse ou à la mélancolie de l’automne. L’expression peut suggérer que la musique produite par le violon peut être triste et émouvante, semblable à l’atmosphère de l’automne qui peut être considérée comme morose pour certains.

On est loin de Verlaine.

En continuant et en demandant “Quel poème parle de sanglots longs des violons de l’automne?”, la réponse est édifiante: “Le poème que (sic !) vous faites référence est probablement “Demain, dès l’aube” de Victor Hugo. Dans ce poème, Victor Hugo évoque les “sanglots longs des violons de l’automne” pour décrire la tristesse et la mélancolie ressenties à la pensée d’une personne aimée qui est partie. C’est un poème émouvant qui exprime la douleur de la perte et la tristesse que l’on ressent lorsque l’on pense à ceux qui nous sont chers et qui ne sont plus là.”

#3.2

Sur ce point, chatgpt est encore battu par perplexity.ai . Perplexity fonctionne de façon différente en essayant d’abord de trouver des sources, puis de les résumer.

Sur la même requête “sanglots violons automne”, voici la réponse de perplexity ( en anglais uniquement malheureusement)

#3.3

Rien n’empêche d’avoir les deux non ?

Les liens vers les pages trouvées plus une analyse des informations par le robot.

#3.4

Si je fais une recherche sur un sujet pour lequel je n’ai aucune connaissance, les chances que je me fasse berner par ce que je vais trouver via un moteur de recherche me semblent plus élevées que via une IA, cette dernière ayant une profondeur d’analyse bien supérieure à mes capacités. Donc je ne trouve pas que se fier à l’IA soit irrationnel, si je garde à l’esprit ses faiblesses. Si au contraire, j’ai déjà une bonne connaissance du sujet, je ne vois pas d’intérêt d’aller sur une IA qui va surtout me dire soit des choses que je sais déjà, soit me faire remonter des choses dont je sais qu’elles ne sont pas fiables. Je vais plutôt aller sur un moteur de recherche qui me donnera précisément ce dont j’ai besoin parmi les sources sur lesquelles je peux avoir confiance pour compléter une analyse.

#4

Merci pour cet article très éclairant que je vais faire découvrir à des amis… et pour cette immense audace.

Jamais je n’aurais imaginé que NextInpact laisse passer un article évoquant chocolatine ou Comic Sans Ms. La modération va encore devoir sévir.

#5

Rah, pitié, vous allez pas vous mettre vous aussi à utiliser ce buzzword de journaliste médiocre qu’est “panique morale”, vous valez mieux que ça.

#6

Mais ont-ils au moins la même finalité ? ChatGPT c’est un outil simulant une conversation humaine en exploitant une base de connaissances pour prédire la meilleure formulation d’une phrase syntaxiquement correcte, naturelle, et cohérente dans le contexte de la discussion (soit répondre au sujet donné et pas dire que sa grand mère a fait du ski).

Le bot actuellement disponible n’est pas fait pour faire de la recherche d’information, il est fait pour discuter de tout et de rien et, avec de la chance, dire une chose exacte sur le fond. Mais son but premier reste la forme.

#7

Résumer le web aux sites qui vivent des revenus publicitaire est quand même très réducteur.

Je verrai même ça comme une bonne nouvelle la disparition des sites web qui vivent exclusivement de la publicité

#7.1

Je verrai même ça comme une bonne nouvelle la disparition des sites web

qui vivent exclusivement de la publicité

+2 !

#8

En attendant ça à déjà plus ou moins commencé avec google et les “réponses rapide”. Pour le reste beaucoup de gens utilisent de bloqueurs de pub, le web n’est pas mort pour autant. Mais c’est vrai aussi que ça rajoutais du beurre dans les épinard à une époque.

Par contre l’autre danger c’est de remplir des site avec une IA.

#9

Aujourd’hui c’est le baratin qui fait tourner le monde , pas la vérité.

En ce sens, ces IA sont les meilleurs outils pour faire tourner le monde de demain.

D’ailleurs, tout cet article a été écrit par GPT puis simplement retouché ici et là par le rédacteur humain. Et peu importe si ce que je viens de dire est vrai ou faux: vous vous êtes déjà fait un avis sur mon baratin et vous étiez prêt à écrire le votre pour conforter/réfuter ma déclaration.

#9.1

tiding

Je n’ai pas compris ce que vous avez dit.

tudung

#10

Tape dans google “ nombre habitant france ” : Pas besoin d’ouvrir une page web, et si tu tape “ temps de cuisson pate ” rien que le titre + seo suffit à avoir l’information sans ouvrir une seule page.

A terme ça sera quasiment valable pour n’importe quelle recherche.

#11

Personnellement je ne vois pas où il y a débat concernant le pain au chocolat.

#12

Justement! Il n’y a AUCUNE “profondeur d’analyse” sur le fond.

L’analyse et le travail ne se fait QUE sur la forme, avec une prise en compte du contexte.

C’est ce qui fait qu’elle est convaincante aux yeux des humains.

Cette maniere de fonctionner est (pour le moment?) très trompeuse.

Voire dangereuse puisque l’utilisateur lambda n’a aucun moyen immediat de savoir si la réponse convaincante donnée est realiste ou totalement fantaisiste.

J’aurais tendance à la rapprocher de la semantique des hommes politique qui fonctionne un peu pareil : irréprochable sur la forme, rarement étayé sur le fond.

#13

Au final, raconter n’importe quoi pour être cru et garder l’attention de l’interlocuteur … ces IAs sont presque humaines ! ( commercial, politique, consultant … )