Next INpact a obtenu la version française du tableau de classification de la reconnaissance/analyse faciale issu du deuxième rapport du projet de recherche « La cartographie de l'utilisation de la reconnaissance faciale dans les espaces publics en Europe ». Analyse de ce rapport et de son tableau de classification réalisé par les experts grenoblois d'AI-regulation.com.

Faut-il interdire ou autoriser la reconnaissance faciale dans les espaces publics ? Dans un débat public, toutes les réponses ont leur place et leur légitimité tant qu’elles sont issues d’une connaissance exacte et complète du débat et des intérêts en cause.

Pour nourrir les débats autour de la RF, les chercheurs d'AI-Regulation.com, basés à Grenoble, ont imaginé un tableau de classification, accompagné d'explications et d'exemples retraçant les fonctions et les utilisations de la reconnaissance faciale dans les espaces publics.

Le fonctionnement du traitement facial

Ainsi, « un système de RF est composé d'un composant de traitement facial (FPC en anglais), dont les entrées proviennent d'une phase de prétraitement (par exemple la phase qui capture et prétraite les images), et dont les sorties sont post-traitées pour remplir l'objectif (ou la finalité) du système de RF ». Ceci posé, ce traitement facial « peut se caractériser par les entrées, les fonctionnalités (les finalités) et les résultats ».

Du côté des entrées, on trouve « des images faciales capturées (visages capturés) qui sont le plus souvent extraites des caméras de vidéosurveillance, qui peuvent ou non être utilisées en temps réel ». Elles peuvent toutefois « être fournies, dans d'autres cas, par un opérateur (par exemple, la photo d'une personne soupçonnée d'un crime est introduite dans le système par un officier de police) ».

De même, « les images faciales capturées peuvent concerner une seule personne (« 1 »)), par exemple une photo prise d'une personne au guichet électronique d'un aéroport en France à l'aide du système Parafe, ou toutes les personnes (« N ») présentes dans un environnement spécifique où des caméras biométriques sont déployées (par exemple toutes les personnes traversant une rue à Londres où des fourgons RF sont déployés par le Metropolitan Police Service) ».

Ensuite, ces images sont comparées à d’autres images de référence, soit fournies par l’utilisateur lui-même (par exemple sa photo contenue dans un passeport biométrique présenté à la frontière), soit présentes dans une base de données contenant des visages de référence (« M ») pour permettre la vérification (1-1) ou l’identification (1-M) de l’individu.

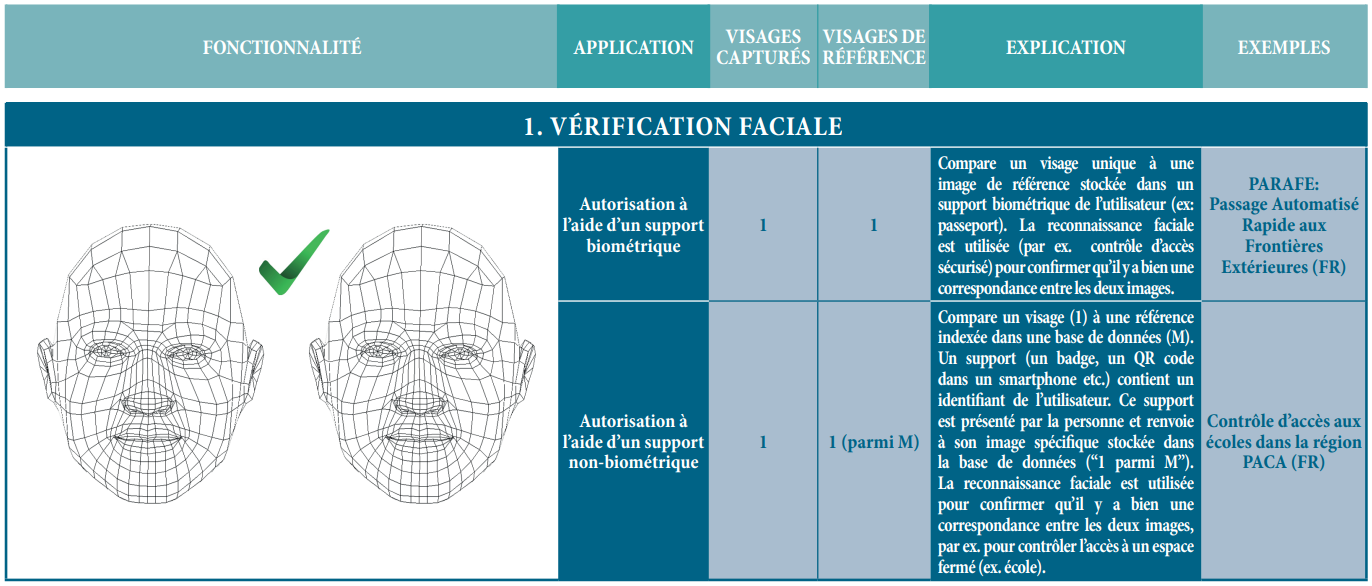

La vérification faciale, parmi les différentes fonctionnalités de la RF

Ceci posé, le rapport explique les trois fonctionnalités du traitement facial, schématisé dans un tableau de classification.

La vérification faciale se résume dans un tel cas à la comparaison de deux images faciales afin de vérifier s’il s’agit bien de la même personne. L’image capturée (1) est alors comparée à une (1) autre image fournie par l’utilisateur (par exemple, sa photo qui figure dans son passeport biométrique, lors d’un passage à la frontière).

L'identification faciale

L’identification faciale permet cette fois d’identifier une personne en comparant une image à X images se trouvant dans une base de données de référence afin de savoir si la personne s'y retrouve enregistrée. « Dans le cas de l'identification faciale, la comparaison des visages a lieu entre une image et un ensemble d'images. Les visages sont toujours vérifiés un par un par rapport à tous les visages de la base de données de référence ».

Dès ce stade, les chercheurs analysent trois sous-catégories :

- L’identification individuelle « où il y a une correspondance de visage avec une seule image faciale capturée et une base de données de référence (1-M) »

- La comparaison de visages à grande échelle « où il y a une correspondance de visage entre les visages capturés de toutes les personnes présentes dans une zone spécifique et une base de données de référence (N-M) »

- Le suivi du visage « où il y a une correspondance de visage entre les visages capturés de toutes les personnes présentes dans une zone spécifique (suivi) et les images de référence d'une seule personne (N-1) ou d'un groupe spécifique (N-M) »

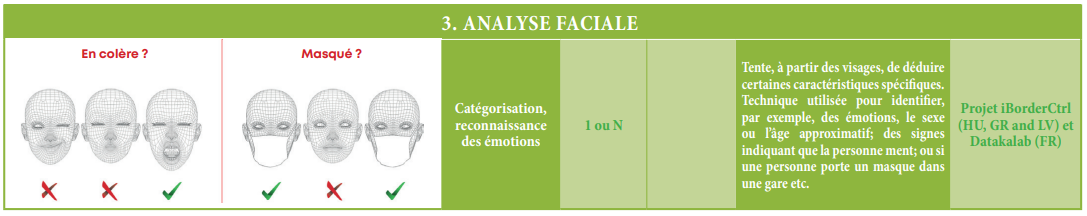

L'analyse faciale

Enfin, l’analyse faciale permet de « détecter certaines caractéristiques (sexe, race, etc.) ou certains états émotionnels (bonheur, colère, signes de mensonge, etc.). Contrairement aux deux autres fonctionnalités de base, [elle] n'implique pas la comparaison des visages ».

Ainsi, ces fonctionnalités « peuvent être appliquées à n'importe quels nombre et type d'entrées d'images, et peuvent être affectées à différents objectifs, donnant lieu à différentes variantes, avec différents impacts sur les droits individuels ».

Crédits : Institut MIAI Grenoble Alpes

Crédits : Institut MIAI Grenoble Alpes

Quant aux résultats de ce système, ils « dépendent de l'application ou du but spécifique pour lequel il est utilisé, des entrées reçues et des fonctionnalités utilisées ».

Par exemple, dans une vérification faciale « qui est utilisée dans une application pour "autoriser" les utilisateurs (par exemple le contrôle des passeports à la frontière), la sortie [le résultat] sera soit un "0" (échec de la vérification de l'identité de l'utilisateur et accès refusé), soit un "1" (identité vérifiée et accès accordé) ».

Or, « avec la fonctionnalité d'identification des visages, qui est utilisée par la police dans une application d'"identification individuelle" (par exemple, la comparaison des visages entre la photo d'un suspect dans une enquête criminelle et les images des personnes dans une base de données des forces de l'ordre), le résultat sera soit un "0" (échec de la recherche d'une correspondance), soit une liste d'identités associées aux probabilités ».

L’importance des objectifs/finalités de la RF

Les auteurs constatent qu’il est aussi important de comprendre les finalités de l’usage d’un système de RF afin d’évaluer les risques qu’ils représentent pour les droits fondamentaux. En effet, une même fonctionnalité peut être utilisée à des fins diverses et variées.

Par exemple, « la fonctionnalité d'identification des visages peut être utilisée à des fins d'"identification individuelle", comme lorsque la police dispose de la photo d'une personne soupçonnée d'avoir commis un crime et utilise la RF (de manière 1-M) afin de l'aider à identifier cette personne parmi celles figurant dans une base de données des forces de l'ordre ».

Cependant, « la même fonctionnalité peut également être utilisée dans une autre application, celle de la "comparaison de visages à grande échelle" (N-M), par exemple en scannant les milliers de personnes qui traversent une route afin de les comparer à une liste de criminels présumés ».

Dans les deux cas de figure, ni les personnes concernées (d’un côté un suspect et de l’autre tout passant sans différenciation) ni l’ampleur de l’utilisation de la RF ne sont comparables.

Ainsi, les experts constatent que « les problèmes soulevés par l'utilisation des systèmes de RF et les risques liés aux droits de l'homme, d'utilisation de la même fonctionnalité à des fins différentes et dans des contextes différents pourraient être très différents ».

Dans la même veine, « la même finalité pourrait être servie par différentes fonctionnalités, ce qui soulève, là encore, des considérations différentes en termes de risques et d'évaluation de la nécessité et de la proportionnalité » dans l’usage du système de RF.

Ainsi, le rapport indique que pour « parvenir à une classification satisfaisante des utilisations de la RF dans les espaces publics, il est donc nécessaire de prendre en compte à la fois les éléments techniques (les fonctionnalités du FPC et les entrées) et l'objectif pour lequel le système de la RF est utilisé ».

En effet, l’ensemble de ces éléments « détermineront les résultats du système et influenceront grandement l'évaluation des risques. Les conditions d'exploitation du système sont également primordiales à cet égard (opérateurs qui l'utilisent, autorisations, mesures de responsabilisation, etc.) » (page 10).

D’ailleurs, le rapport note que « l'industrie biométrique développe une grande variété d'outils pour des applications très différentes » et que le « tableau n'a pas l'intention d'être exhaustif ». Il est également précisé que « dans certains cas, en fonction de la manière dont les objectifs poursuivis par un opérateur sont gérés, une combinaison de ces techniques et applications peut être utilisée » (page 12).

En revanche, le tableau de classification « vise plutôt à présenter de manière accessible les principales fonctionnalités et applications de la RF qui ont été utilisées jusqu'à présent dans les espaces publics en Europe ». Par cette occasion, les auteurs souhaitent mieux nourrir les débats et la réglementation dans ce secteur pour le moins sensible.

Commentaires (13)

#1

Toujours pas de carte pour @Lyzz?

Très intéressants ces articles sinon :oui2:

#2

Si je comprends bien et en poussant un peu, la RF serait capable de repérer dans une foule des inconnus non identifiés dans une base de données mais dont le faciès trahirait des pulsions de vol ou de meurtre, avec risque imminent de passage à l’acte. Ce qui enclencherait illico une surveillance étroite et un contrôle d’identité. Ça devient pointu. Au moins dans les ambitions.

#3

Je ne vois pas le rapport entre la cardinalité (qui est en gros l’unique sujet de cet article) et la gravité : le fond du pb est l’objectif et la finalité des bases de données :

Que l’on face du 1-m ou n-m dans les 2 cas ne change absolument rien : Même pour une simple identification, Clearview sera illégale, à l’opposé il me semble parfaitement légitime que la police face du n-m pour chercher un terroriste ou enfant perdu dans une foule !

La technique est exactement la même dans les deux cas, ce qui change, c’est la source de données.

Le vrai pb de fond, ce sont les échanges de finalités de ces bases de données : Si un flic cherchait la photo d’identité de son rdv tinder c’est scandaleux ! Idem si Estrosi utilise la base des cantines pour reconnaitre un gamin qui fait du skate où c’est interdit.

Deuxième pb est la capture d’image : comment s’assurer que quand on filme une foule et fait tourner un algo n-m dans un objectif légitime, que ça ne construit pas en même temps une base de données de visages inconnus ?

#3.1

C’est pourtant ce qu’essaie de mettre en avant cet article : ce sont en bonne partie les objectifs qui sont à surveiller. Et pas que la cardinalité. Car chercher si 1 coupable est présent dans une foule ou si dans cette foule il y a potentiellement des personnes suspectes, l’objectif et l’atteinte à la vie perso sont fortement différents.

Et s’assurer que qq chose se passe techniquement comme prévu… Et bien il “suffit” de se donner les moyens techniques pour faire ce que l’on veut faire et pas plus. C’est super simple à cadrer, ça nécessite des moyens et connaissances pour le vérifier et contrôler (et donc c’est rarement fait), mais c’est une bête histoire de si on veut le vérifier ou si on laisse planer le doute sans rien contrôler.

PS : je pense être biaisé, car je n’estime déjà pas légitime que la police puisse chercher “qq chose” dans une foule comme ça, au petit bonheur la chance.

#4

Je résume : Il n’est plus possible de commenter cette actualité.

#5

Article intéressant

Avec des trolls comme toi ça sera bientôt plus possible en effet…

#6

Je t’invite à consulter le nombre de fusillade qu’il y à eu à nice ces dernier temps. Et je suppose que les habitants “normaux” des quartier populaire n’ont pas envie d’être associer à ça. Avoir la tête dans le sable ne te donnera pas raison.

M’enfin bon, peut être que je suis un gros con et que notre pays est intégralement sécurisé et que nous n’avons besoin donc d’aucune caméra d’aucune sorte :)

#7

T’es un mauvais troll.

#8

Je note qu’a chaque fois tu n’a absolument aucun argument à présenter.

#9

Ça existe déjà “manuellement” ça s’appelle des contrôles d’identités, et c’est ce qui est fait quand on recherche quelqu’un. La reconnaissance automatique n’est dans ce cas qu’un simple moyen d’accélérer le processus.

#9.1

Le traitement automatisé est compliqué si la source (ie: vidéosurveillance temps réel) ne permet pas l’identification ( ie: cadrage caméra sur le visage, distance, précision (en nb de pixel), luminosité/contraste, artefacts, masque, barbe/moustache, lunettes, etc etc) ou alors il est nécessaire d’accepter la marge d’erreur qui peut-être traduite en faux-positif ( fort taux d’alerte positive sur des fausses cibles) vs vrai-négatif (fort taux de non alerte sur des vraies cibles) .

Dit autrement, si cette technologie immature est utilisée les politiques devront choisir la taille du tamis: faible pour prendre un maximum de personnes pour satisfaire à la politique du chiffre vs forte pour satisfaire à la politique de la précision.

Je pense pouvoir dire raisonnablement que la première option sera préférée mais je peux me tromper.

#10

Facile: aucune. Ah si en début d’année, un flic a buté un gusse.

Ce qui explose, c’est le nombre de bavures, et ça, c’est incontestable.

#11

Je ne comprends pas pourquoi tu me réponds ça… C’est un simple outil : dans tous les cas en cas de doute le contrôle a lieu manuellement ensuite, en aucun cas ce type de traitement est 100% automatique sans intervention d’humain. Encore une fois, c’est une extension de ce qui se ferrait sans : un policier regarde la foule avec une photo d’un suspect, croit reconnaitre au loin un visage et va contrôler ses papiers.

Vidéo surveillance ou humain, il y’a une marge d’erreur qu’on lève en contrôlant les papiers : le policier se ferra berner de loin par une simple perruque, à l’inverse l’IA trouve des rapprochements pas toujours compréhensibles, mais ne se ferra pas berné par une simple barbe perruque ou moustache.