« DALL·E 2, dessine-moi un astronaute à cheval se prélassant dans un complexe tropical de l'espace en pixel art ». Un clic, et cette IA génère l’image réclamée. Cette nouvelle version permet de créer des images « réalistes » ou « artistiques » à partir d’un descriptif en langage naturel. Une solution qui questionne sur le terrain de la propriété intellectuelle.

OpenAI a été lancé fin 2015, avec deux co-présidents de renom : Elon Musk (Tesla et SpaceX) ainsi que Sam Altman (Y Combinator). À l’époque, c’était tout à la fois une alliance, une initiative et une société de recherche à but non lucratif sur tout ce qui touche à l’intelligence artificielle. En mars 2019 un changement important a été annoncé : OpenAI est devenue une société à but lucratif « plafonné ».

Elle s’est déjà fait remarquer pour certaines de ses publications, notamment en 2017 quand elle avait entrainé une intelligence artificielle avec des images de synthèses et de la réalité virtuelle où, pour simplifier, un ordinateur apprenait à un ordinateur.

L’entreprise revient aujourd’hui avec DALL·E 2 : « un nouveau système d'intelligence artificielle capable de créer des images réalistes et artistiques à partir d'une description en langage naturel ». Comme son nom l'indique, cette IA repose sur la suite de DALL·E lancée en janvier 2021.

OpenAI promet « des images plus réalistes et précises, avec une résolution quatre fois supérieure ». Et le moins que l’on puisse dire, c’est que – même sans être parfait – les résultats sont impressionnants et ouvrent le champ à de multiples possibilités, non sans soulever des questions de propriété intellectuelle.

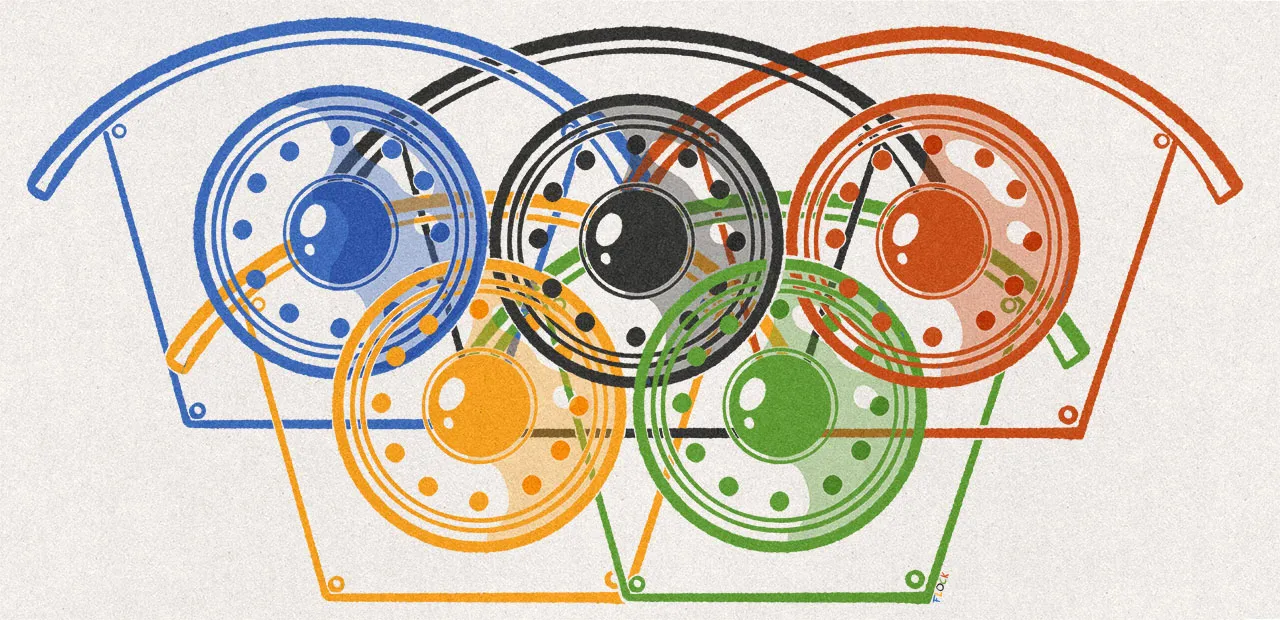

Combiner des concepts (parfois absurdes) et des styles

Le nom rend évidemment hommage au robot Wall-E de Pixar et à l’artiste Salvador Dali. C’est donc tout naturellement que la première image mise en avant dans la publication scientifique est un portrait de Salvador Dali avec une partie du visage robotisée. La demande était : « un vibrant portrait en peinture de Salvador Dalí avec la moitié du visage en robot ».

Ces images ont été générées à partir d’un texte

Non contente de créer des images à partir d’un texte, l'IA est capable de « combiner des concepts, des attributs et des styles ». Vous pouvez lui demander un « astronaute à cheval dessiné au crayon », ou encore « un astronaute se prélassant dans un complexe tropical de l'espace en pixel art », et pourquoi pas un rendu photoréaliste.

Les exemples mis en avant par les chercheurs à l’origine de DALL·E 2 sont parfois surprenants. Il est possible d’avoir une image photoréaliste d’un koala mettant un dunk ou faisant de la moto, d’un panda sur des patins à glace, d’un singe faisant de la comptabilité sur une table, de la Joconde avec une crête iroquoise, etc. La vidéo ci-dessous regorge d’exemples.

Dans certains cas, le rendu donne une image qui peut être assez étrange. Par exemple, dans la page 2 de ce PDF quand une fleur sort des mains, ou encore cette image signalée par un internaute sur Twitter. Cette image a été créée par DALL·E 2 à partir de la phrase suivante : « une photo de la devanture de magasin de fleurs pittoresque avec une façade vert pastel et blanche avec une porte ouverte et une grande fenêtre ».

Modifier des images existantes, à partir d’un texte

DALL·E 2 est aussi capable de modifier des images existantes, là encore simplement avec une demande en langage naturel. Dans ce cas, l’intelligence artificielle « peut ajouter et supprimer des éléments tout en tenant compte des ombres, des reflets et des textures ». Vous avez envie d’ajouter un corgi (une race de chien) dans une toile de maitre ou dans un décor réaliste ? Rien d'impossible.

Il en va de même pour des services plus terre à terre comme ajouter un canapé dans différents endroits d’une pièce. Des applications de ce genre en réalité augmentée existent déjà depuis longtemps chez certaines enseignes proposant du mobilier, mais il s’agit cette fois de se baser sur une demande textuelle, non plus sur des images de produits.

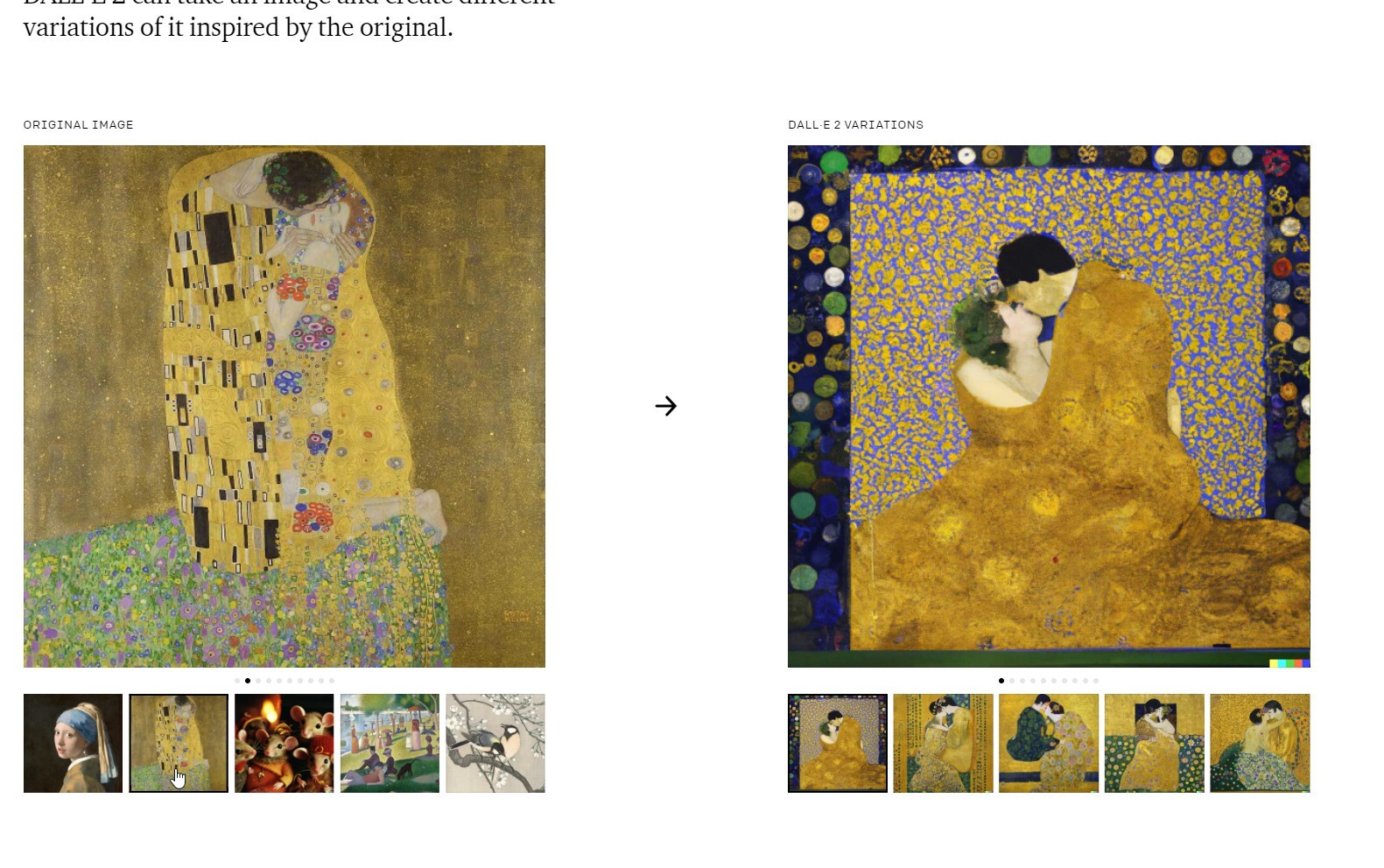

À parti d’une image, DALL·E 2 peut aussi créer « différentes variations inspirées de l'original ». Vous vous demandez ce que pourrait donner le portrait de La Jeune Fille à la perle de Johannes Vermeer ou Le Baiser de Klimt dans un style différent de leur auteur ? L’IA propose plusieurs variations de thèmes. Cela fonctionne également pour la photo d’une salle de bain et même pour le portrait robotisé de Dali dont nous parlions précédemment (créé à la base par DALL·E 2).

Un projet de recherche, une API privée (pour le moment ?)

Pour le moment, DALL·E 2 est présenté par OpenAI comme « un projet de recherche qui n’est pas actuellement disponible dans [son] API ». Seul un « groupe restreint d'utilisateurs » peut y accéder. Une ouverture à plus d'utilisateurs est prévue à l’avenir, sans précision sur l'agenda.

Plusieurs limitations ont été ajoutées par OpenAI afin de « limiter la capacité de DALL· E 2 à générer des images violentes, haineuses ou du contenu pour adulte » : « Nous ne générerons pas d’images si nos filtres identifient les demandes textuelles et les téléchargements d’images susceptibles d’enfreindre nos règles », ajoutent les chercheurs. Les protections résisteront-elles à une éventuelle ouverture massive de cette IA ?

Si l’on combine les résultats actuellement prometteurs de DALL·E 2 avec les techniques actuelles permettant de créer des visages humains plus vrais que nature et les deepfakes de manière générale, cela laisse entrevoir un éventail de possibilités assez impressionnant… mais tout aussi inquiétant. Partant du principe qu’une vidéo n’est qu’une succession d’images, pourrait-on imaginer la création de vidéos à partir de quelques phrases ou d'un simili scénario ?

Des questions juridiques vertigineuses

Juridiquement, les questions soulevées par cette technologie sont tout aussi vertigineuses, et pas seulement parce que ces nouveaux outils pourraient questionner sur l'utilité, dans un avenir proche, des banques d'images.

En 2018, une mission avait été lancée au Conseil supérieur de la propriété littéraire et artistique (CSPLA) pour plancher justement sur ces conséquences. « Lorsque l’IA se substitue à l’humain, se pose en effet la question de savoir si la réalisation finale peut bénéficier de la qualification d’œuvre de l’esprit », écrivait le CSPLA.

À qui appartient une image (ou une musique, etc.) créée par une IA ? Les œuvres de l'esprit sont le fruit d’une activité créatrice reflétant la personnalité de l’auteur par des choix libres.

La Cour de justice de l’UE avait rappelé récemment ces fondamentaux, en précisant que la notion « d’œuvre » concerne un objet (image, texte, vidéo, etc.) original, une création intellectuelle propre à un auteur. Et c’est seulement après vérification de ces conditions qu’un contenu est protégé par le monopole du droit d’auteur, avec l’armada d’outils prévus pour défendre son territoire.

Dans le rapport, fruit de cette mission, les professeures d’université Alexandra Bensamoun et Joëlle Farchy tempèrent : qu’ « un créateur utilise un pinceau, un burin, un appareil photo ou un instrument technologique de pointe ne modifie pas le raisonnement ».

Pour les deux enseignantes, « dès lors que l’IA reste un outil entre les mains d’un créateur-auteur, il faut convenir d’une sorte de principe de prééminence de l’humain, qui efface la machine et permet l’application classique des règles du droit d’auteur. Ainsi, dès lors qu’une personne humaine intervient de manière créative dans la création, l’outil utilisé importe peu ».

Qui est l'auteur d'une image créée par l'IA ?

Cependant, les formules sont plurielles, un contenu généré par une seule IA devrait en toute logique échapper au cadre du droit d’auteur (et même au copyright, comme l'avait décidé l’US Copyright Office en février dernier).

Certes, écrit le rapport, « on pourrait être tenté, en invoquant le modèle des œuvres plurales, d’octroyer la qualité d’auteurs du produit généré par l’IA aux différents créateurs amont. Mais cette voie est fragile, car les différents éléments ne se retrouvent pas dans la création finale ».

Si l’œuvre exige une création, laquelle se rattache à la conscience, à un créateur personne physique, cette qualité fait évidemment défaut pour des contenus sécrétés par une intelligence artificielle (ou une machinerie réelle). Le rapport sonde différentes formules qui permettraient d’identifier malgré tout un titulaire de droit.

Ce pourrait être le concepteur de l’IA. « Cette hypothèse a l’avantage d’identifier une personne humaine qui aura entretenu des liens très proches avec la machine, qui a été capable d’y inoculer ses propres biais et donc d’y laisser une certaine empreinte ».

Ce pourrait être encore l’utilisateur de l’IA, piste qui voudrait « que l’IA soit "l’auteur en fait" de l’œuvre, mais que seul l’utilisateur soit son "auteur en droit" dès lors que c’est à sa demande que l’IA a produit l’œuvre pour laquelle la protection du droit d’auteur est recherchée ».

Face aux difficultés, les deux universitaires imaginent qu’une loi pourrait intervenir pour trancher ces questions, quand pourrait être imaginé aussi un nouveau droit, calqué sur les droits voisins, au profit de la personne « qui prend le risque d'un retour sur investissement » en matière d’IA.

La SACEM ferme la porte au domaine public

La SACEM, qui est intervenue dans la mission en question, n’est pas très encline à considérer que ces contenus puissent entrer de facto dans le domaine public.

« Rien ne s’oppose [...] à ce que ces créations soient l’objet d’un droit de propriété. Elles représentent une valeur et doivent pouvoir être appropriées. La société a même intérêt à cette appropriation qui permettra la mise en valeur de la création intelligente et la désignation d’un responsable de son exploitation ». Dont les intérêts pourraient être représentés, au hasard, par un organisme de gestion collective ?

Commentaires (41)

#1

C’est impressionnant !

Tu veux une image pour illustrer un site web, ton enfant te demande un dessin de princesse à colorier, un ado veut un poster psychédélique pour sa chambre, tu veux incruster une personnalité dans un décor spécifique… Les possibilité sont infinies et je dirais que les questions de propriétés intellectuelles ne sont qu’une toute petite part de ce que cela peut changer dans la société !

#1.1

Ou plus inquiétant: « dessine moi une route hivernale jonchée de cadavres » (argument qui pourra être utiliser pour nier ses crimes ou accuser l’ennemi).

#2

“Dessine-moi le prochain président de la République” 😂

#3

J’espère bien que ce genre d’initiatives, d’ici quelque temps, mettra enfin un terme définitif à la notion archaïque de propriété intellectuelle telle que décrite et appliquée actuellement.

Ca a l’air très fun en tout cas, j’ai hâte de pouvoir essayer un jour, si possible

#3.1

mettra enfin un terme définitif à la notion archaïque de propriété intellectuelle..

j’espère aussi, p.c.q. c’est leur truc !

leur truc !

#4

” Dont les intérêts pourraient être représentés, au hasard, par un organisme de gestion collective ? “

Je me suis fais exactement la même réflexion en lisant la réponse de la SACEM.

“On ferme pas la porte mais presque, sauf si ça pouvait , au hasard, être une société comme la nôtre qui soit en charge de la gestion de leurs droits”

#4.1

Ce serait mieux qu’un système façon copie privée.

#5

Techniquement, on pourrait aussi simplement ne pas considérer ça comme des “œuvres” car en effet, il n’y a pas grand chose d’original dans les productions d’un tel programme. Il ne fait qu’associer des motifs (ici du texte) à un résultat (une image) à l’aide de connaissances qu’il a acquis. Il n’y a pas d’esprit, de but dans la création de la machine.

#6

Y a pas un site pour tester ce que ça donne ? je crois qu’il y a moyen d’y perdre des dizaines d’heures …. encore plus qu’avec google earth à son époque

#6.1

Il existe un Google Colab qui permet également de générer une image à partir de texte via une IA, cela utilise les moteurs VQGAN et CLIP

https://colab.research.google.com/drive/1go6YwMFe5MX6XM9tv-cnQiSTU50N9EeT?fbclid=IwAR30ZqxIJG0-2wDukRydFA3jU5OpLHrlC_Sg1iRXqmoTkEhaJtHdRi6H7AI#scrollTo=FhhdWrSxQhwg

c’est en espagnol mais simple à utiliser, on lance en premier et dans l’ordre les différents modules qui vont importer les fichiers dans la machine virtuel, dans Parámetros on entre son texte en anglais, on exécute ce module et enfin on lance la génération de l’image “Hacer la ejecución…”. Pour tester d’autres textes il suffit de de de refaire les deux dernières étapes

#6.2

merci pour le lien, je vais tester ça

#7

Je n’ai pas encore lu l’article, mais je souhaitais saluer le sous titre. Franchement, j’ai un humour tout pourri, mais je crois avoir trouvé mon maître.

#7.1

Je propose « Le slave adore DALL-E »

#8

On pourrait ajouter que l’IA créant ses images en ce basant sur une base de données remplies d’images qui sont pour beaucoup protéger par le droit d’auteur il y a partage de droit d’auteur ou plagiat. Je ne me rappel plus ( et j’ai la flemme de chercher ) comment étaient gérer les œuvres type collage de morceau d’autres œuvres et/ou copie évidente d’un style.

#9

“Dessine moi une blonde à forte poitrine”

#10

Je veux dénoncer personne, mais c’est pas Seb :-$

#10.1

En tout cas Achille Talon n’aurais pas dit mieux. Un de ses meilleurs : “Va ! Laid. Et ris ! Car ici ne gisent qu’ares destins.”

#10.2

Si ce n’est pas lui alors c’est l’IA qui a lové le sous-titre.

Il reste donc à attribuer la paternité de cette création de l’esprit sans se contrefaire les nœuds !

#11

Pour moi la propriété de l’oeuvre est à la fois celle de l’auteur ET celle de l’I.A., car les deux ont grandement participé à sa création.

Un appareil photo ne participe que peu à la création puisqu’il ne fait que refléter ce qui passe à travers son objectif, modulo les choix artistiques et traitements numériques inclus dans l’appareil. Mais le meilleur des appareils photos n’est rien entre les mains d’un photographe incompétent. C’est encore plus vrai pour un pinceau ou un crayon.

Tandis qu’ici, on se retrouve avec un outil qui contribue à une partie importante, si ce n’est majeure de la création, et l’artiste ne fait que dicter ses choix à l’algorithme qui les traitera ensuite pour générer le résultat final. Donc, l’artiste à son rôle jouer, puisqu’il faut que son entrée soit créative pour que l’oeuvre le soit également, mais l’I.A. aussi car c’est elle qui “décide” d’après sa programmation d’une bonne partie dudit résultat final.

#11.1

Le souci est qu’une I.A. n’est pas reconnue comme une personne juridique dans notre droit, elle ne peut donc pas jouir du droit d’auteur.

La question est la même que celle de l’histoire de la macaque qui avait fait une photo d’elle-même avec l’appareil d’un photographe qu’elle avait piqué. Le photographe avait voulu déposer la propriété du cliché et ce fut contesté. La conclusion de l’histoire, qui eut lieu aux USA, était que le cliché ne pouvait être affublé d’un droit d’auteur puisqu’il n’y avait pas d’auteur (le singe n’étant pas une personne juridique).

En France il me semble que ça serait un peu plus complexe car la notion d’oeuvre orpheline n’est pas très reconnue par le CPI si je ne m’abuse. Je ne sais pas s’il y a eu des affaires similaires.

#11.2

Bien sûr que la juridiction n’est pas adaptée, ce qui est bien le coeur du problème ici :p

J’ai juste décrit ce qui, selon moi, serait la situation idéale. Maintenant, c’est plus que complexe à mettre en place.

#11.3

Ah désolé, je n’avais pas compris ton message en ce sens.

#12

le sous titre aurait aussi pu être: Le salvateur Dall-E

#13

Une oeuvre ne peut pas appartenir à un outil.

Un tableau n’appartient pas à un pinceau ni au concepteur du pinceau ni au vendeur du pinceau.

De la même manière, une photo apparient au photographe, pas au concepteur ni au vendeur de l’appareil photo.

De la même manière, le droit sur les ouvres générées par des algorithmes doit appartenir à celui qui utilise l’algo (par exemple en entrant une phrase et en cliquant sur “générer”).

À partir du moment où il y a une intention humaine de créer, et que la création a une valeur aux yeux des autres humains, il est clair qu’il y a une notion de propriété intellectuelle.

#14

“La SACEM, qui est intervenue dans la mission en question, n’est pas très encline à considérer que ces contenus puissent entrer de facto dans le domaine public.”

La SACEM semble globalement allergique à tout ce qui ressemble à du domaine public.

#15

Certes, mais il y a aussi une bonne partie de l’intention humaine dans celui qui a entraîné l’IA, donc le concepteur de l’algo. Et il y en a une autre bonne partie dans les images d’origine qui ont été données à manger à l’IA.

#15.1

Adobe pourrait prétendre avoir des droits sur des images créés avec des algos de Photoshop s’appuyant sur du machine learning ? (Il y en a pas mal, comme la “suppression intelligente” qui peut créer des parties entières d’une image).

Supposons qu’une IA contrôle un robot humanoïde.

Est ce que ça a du sens de considérer que le concepteur de l’IA (et non son utilisateur) est propriétaire de la valeur créé par l’IA à la demande et sous la supervision de l’utilisateur ?

#15.2

Une IA, ça veut tout et rien dire en même temps. Là, il est question de deep learning. Le deep learning marche avec une séance d’apprentissage sur une base de donnée qu’on lui montre. Ça ne semble pas déconnant que le choix des images qu’on donne en apprentissage à l’IA représentent une intention humaine. Et les images en elles-mêmes, qui au final ressortent dans le résultat façon patchwork, aussi.

À ton avis, c’est l’IA qui a inventé une image d’astronaute ? Elle a juste adapté une image qu’elle avait en stock.

L’algo d’Adobe qui duplique simplement des éléments qu’il y a dans la même image que celle qu’il reconstruit, ce n’est pas du tout le même fonctionnement.

#15.3

L’algo ne recrache pas juste une des images d’entraînement, c’est justement le but de l’entraînement, de faire en sorte que l’algo puisse généraliser. Si le système ne fait que reproduire ce qu’il a vu lors de l’entraînement c’est de l’overfit, et l’entraînement est conçu pour l’éviter.

Mais même si une image utilisée lors de l’entraînement est reconnaissable, ce qui arrive, c’est le droit d’auteur de cette image d’entraînement qui s’applique évidemment, pas le droit de celui qui a entraîné l’algo.

Tu peux créer une collection de samples à partir de musique que tu aimes, ça ne te rend pas propriétaire des droits sur ces samples.

Le concepteur d’un appareil photo aussi fait des choix avec une intention qui a une conséquence sur l’image produite. Mais c’est le photographe qui a l’intention de créer et qui décide de ce qu’il prend en photo, et qui possède tous les droits sur ses photos, comme l’utilisateur d’un algo devrait posséder les droits sur ses créations.

#15.4

Bien sûr que ça ne recrache pas une image toute faite de l’entrainement, heureusement. Il y a de la recomposition, l’image générée est une sorte de patchwork qui contient plein de petits morceaux vus dans d’autres images.

Mais l’IA n’a aucune “compréhension du monde”. Ce n’est pas comme ça que marche le deep learning. La machine ne sait pas qu’un astronaute va dans l’espace ni qu’une voiture est un moyen de transport. Pour l’IA, ce ne sont que des formes et des couleurs, associées à une étiquette par entraînement. Dans les différentes images, on voit bien que l’astronaute est un peu pimpé avec des bandes de couleurs différentes superposées dessus pour que ça ne fasse pas trop photocopie, mais à chaque fois, c’est le même modèle de scaphandre par exemple. Mais il ne faut pas se leurrer : la machine insère simplement ce qui lui a semblé être l’élément caractéristique des images qu’on lui a déjà présentées et qui portaient le mot ‘astronaute” dans leur description.

On voit bien les limites du truc sur l’échelle de piscine de cette photo, d’ailleurs. L’IA a vu qu’une échelle de piscine est un truc en métal, avec un tube et un arc de cercle au-dessus, mais le modèle d’échelle généré n’a aucun cohérence physique, un peu comme les artefacts que l’on obtient quand on recompose un panorama avec hugin.

#15.5

D’un certain point de vue, même le modèle d’Adobe qui remplit les trous a une forme de “compréhension du monde” (qui se limite aux aspects visuels des textures et motifs).

Attention au syndrome courant qui consiste à minimiser les capacités d’un modèle d’apprentissage machine par angoisse de la comparaison avec les humains (bien sûr les possibilités de l’apprentissage machine sont encore loin de ce que peut faire un humain… dans la plupart des cas).

Au final ça ne change pas grand chose au fait qu’un modèle de ce type est à mon sens un outil, et que le concepteur d’un outil n’a pas la propriété intellectuelle sur les productions faites avec son outil.

#16

Un outil comme celui-là va faire émerger une nouvelle vague de créateur de contenu artistique.

Actuellement, t’as beau avoir une superbe idée d’image, si tu sais pas dessiner ça restera dans ta tête.

Avec cet outil, tu demandes des morceaux de ce que t’as en tête à Dall-E, tu apprends à manier photoshop et tu fais ta composition : coupé, décalé, transformé, filtré…

Plus besoin de savoir dessiner pour créer. Je suis certain que plein de personnes ont des super idées artistiques, mais pas de compétences en dessin pour les réaliser.

#17

C’est assez incroyable (au sens premier :) ). Y’a beaucoup de Corky, astronaute et koala dans les exemples. Je serais curieux de voir ce qu’on peut faire réellement (si il’y a 10 mots reconnus on va pas aller beaucoup plus loin que les exemples du papier…

Ça ne serait pas un article du 1er avril ? Ou un “concept” de startup pour lever des fonds ?

#18

Vu que ca ne rapporte rien, quel intérêt il y a au domaine public?

#19

A noter que les risques liés à cette IA ont été soulignés dans un post de OpenAI.

La sections sur les biais et stéréotypes notamment est très instructive.

https://github.com/openai/dalle-2-preview/blob/main/system-card.md

#20

Ça correspond certainement à leur point de vue.

#21

C’est bien possible, difficile à dire. Les exemples montent qu’à priori (si il n’y a pas de manipulation des exemples donnés) le modèle à une compréhension du monde de haut niveau et est capable de générer des images complètement inédites.

Ce n’est pas une simple duplication.

Dans les deux cas l’auteur de l’algo a une intention qui impacte directement le résultat. (Indépendamment du fait que l’auteur de l’algo n’a pas les droits sur l’image d’origine).

Logiquement, l’auteur d’un algo pourrait faire payer autant qu’il veut l’accès à son algo, mais les créations des utilisateurs leurs appartiennent à 100%, sauf si une autre œuvre est clairement reconnaissable dans l’œuvre finale (dans ce cas les droits sont partagés selon les règles déjà en vigueur).

#22

Je sais pas si c’est bidon, mais si c’est vrai, Duchamps et Magritte auraient sûrement adorer faire joujou avec.

#22.1

Pas con :

Ceci n’est pas une urinoire… c’est un ISOLOIRE ! Yeah !

VOTEZ DALL-E : pissez au second tour

#23

Attention au syndrome courant de croire que, parce que ça s’appelle “intelligence” artificielle, c’est de l’intelligence. Il n’y a pas d’intelligence dedans. Un algo de deep learning, ce n’est jamais qu’un système de pattern matching un peu sophistiqué.

Quand tu manipules toi-même du deep learning, tu te rends vite compte à quel point le truc est stupide.

#24

Comme notre cerveau

Se rendre compte que l’intelligence artificielle n’est pas de l’intelligence humaine n’est que la première étape. L’étape suivante quand on pratique soit même est de savoir apprécier le niveau des meilleurs comme OpenAI et DeepMind.