Les députés examineront le 16 février prochain la proposition de loi « portant diverses dispositions d'adaptation au droit de l'Union européenne en matière de prévention de la diffusion de contenus à caractère terroriste en ligne ». Derrière le nom à rallonge, la mise en route d’un mécanisme de blocage en une heure des contenus considérés comme terroristes.

Ce retrait ultra rapide avait déjà été envisagé lors de la loi contre la haine en ligne. En janvier 2020, un amendement du gouvernement ramenait de 24 heures à 60 minutes, le délai inscrit à l’article 6-1 de la loi sur la confiance dans l’économie numérique.

Cet article autorise le ministère de l’Intérieur à exiger des sites et des hébergeurs le retrait d'un contenu rattaché à la pédopornocriminalité ou incitant au terrorisme et, faute de réponse dans le temps imparti, à ordonner un blocage d’accès entre les mains des FAI. Et ce, sans l’intervention d’un juge, s’agissant d’une procédure uniquement administrative.

Ce passage de 24 à 1 heure avait néanmoins été censuré par le Conseil constitutionnel, non sans explication pédagogique : d’un, la détermination du caractère illicite des contenus en cause était « soumise à la seule appréciation de l'administration ». De deux, si un droit au recours avait été prévu, il n’était pas suspensif. Impossible donc d'obtenir une décision du juge avant d'être contraint de retirer les contenus litigieux. Et de trois, l'hébergeur ou l'éditeur qui ne répondrait pas dans le délai risquait d’être condamné à une peine d'emprisonnement d'un an et à 250 000 euros d'amende. Le Conseil y a vu une atteinte excessive portée à la liberté d'expression et de communication.

Le débat n’a pas été si vite enterré puisque le principe du retrait en une heure est parallèlement monté d’un cran, au stade européen, dans le cadre d’un règlement destiné à imposer cette même contrainte dans l’ensemble des États membres.

C’est dans la lignée de ce texte du 29 avril 2021, qu’une proposition de loi (sans étude d’impact ni d’avis du Conseil d’État) a été portée par l’ensemble des députés LREM afin d’adapter notre droit à ce nouveau régime.

Un appel d’air pour les algorithmes ?

Le 9 février dernier, en commission des lois, Laëtitia Avia (LREM) a décrit un « texte important » qui « nous donne les armes nécessaires pour lutter contre des contenus qui se répandent avec viralité sur les réseaux et internet, comme sur des sites plus secrets, réservés, mais tout aussi dangereux ».

Après avoir rappelé que sa proposition de loi contre la haine en ligne a été censurée par le Conseil constitutionnel faute de garde-fous suffisants, la députée pense que le texte que s’apprêtent à examiner les députés en séance change la donne. Il « a une assise européenne puisqu’il fait l’objet d’un règlement, que l’ensemble des États membres a adopté », et qui entrera en vigueur le 7 juin 2022 tout en confiant de nouveaux pouvoirs à l’ARCOM.

Le discours n’est pas vraiment le même dans les autres camps. Avec un tel retrait en une heure, Paul Molac (Libertés et Territoires) anticipe un usage encore plus intensif aux algorithmes afin de tenir l’agenda. « C’est donc soit une machine soit l’autorité administrative qui décidera des contenus autorisés ou non. J’aurais préféré que ce soit le juge. C’est certes plus long et plus compliqué, mais aussi plus respectueux de la séparation des pouvoirs ».

Craintes partagées par Ugo Bernalicis, à la France Insoumise : « certes, il n’y a pas pour les plateformes d’obligation de recourir à des algorithmes ou des filtres, mais il n’y a pas d’interdits non plus. Ces dernières ont déjà annoncé qu’elles mettraient en place des algorithmes sans lesquels il leur serait impossible, disent-elles, de s’acquitter de leur tâche. Or lors de son audition à l’Assemblée, Frances Haugen nous a fait la démonstration de la perversité de tels algorithmes : alors qu’ils sont censés nous protéger, ils laissent passer certains contenus haineux et en censurent d’autres qui ne le sont pas ».

Au contraire, pour Laetitia Avia (LREM), « il ne faut pas se tromper de sujet. Le retrait d’un contenu dans un délai d’une heure n’est pas le fait d’un algorithme. Le retrait algorithmique est un retrait préventif, qui a lieu avant tout signalement. Lorsqu’un contenu est retiré à la suite d’un signalement, ce n’est pas le fait d’un algorithme », assure-t-elle.

Alexandre Linden, personnalité qualifiée de la CNIL chargée de contrôler les actuelles mesures de blocage administratif, assure pourtant qu'en raison de la brièveté du délai d’intervention imposé aux plateformes, « celles-ci devront se reposer avant tout sur des systèmes automatisés pour traiter les notifications, même si le règlement prévoit qu’aucune obligation de prendre des mesures spécifiques ne comporte l’obligation pour le fournisseur de services d’hébergement d’avoir recours à des outils automatisés ».

Pays d’origine, pays de destination

Stéphane Peu (GDR) s’interroge néanmoins : « en vertu du règlement, ne pourrait-on pas voir les caricatures de Charlie Hebdo, qui ont abouti au drame que l’on sait, censurées au nom d’une conception restrictive de la liberté d’expression dans certains pays selon laquelle le blasphème est assimilé à du terrorisme ? »

La rapporteure a tenté de rassurer l’élu : « s’agissant des injonctions de retrait transfrontalières, le principe du pays d’origine est imposé par le règlement. Toutes les autorités nationales sont soumises à ces dispositions, qui sont claires et directement applicables. Elles seront donc bien contraintes de retirer les contenus manifestement illicites, n’importe où dans l’Union ».

Mais c’est exactement ce que craint l’élu GDR : « tout État membre de l’Union pourra intervenir sur des contenus, alors que nous n’avons pas tous le même rapport à ceux-ci. Il ne faudrait pas que des choses auxquelles nous sommes très attachés, comme le blasphème ou la caricature, puissent être censurées au nom même des principes de certains États membres. Il serait paradoxal de vouloir lutter contre le terrorisme ou l’incitation au terrorisme en ligne et que cela se traduise par des sanctions contre ceux qui en sont victimes – par exemple Charlie Hebdo ».

Doutes sur la conformité constitutionnelle

Paul Molac s’est interrogé également sur la conformité de ces normes avec la Constitution. « Comment surmonter un tel obstacle ? La révision de la Constitution n’est pas envisageable dans les quinze jours qu’il nous reste… Quelle sera donc la pérennité de la proposition de loi ? ». Une analyse partagée avec Philippe Latombe, dans les rangs du MoDem. « L’article 1er prévoit un dispositif identique à celui que le Conseil constitutionnel avait censuré dans sa décision du 18 juin 2020. Dès lors comment pourrait-il être conforme à la Constitution alors que celle-ci n’a pas été modifiée ? ».

Aude Bono-Vandorme, corapporteure, ne voit aucun risque de non-conformité. « Le dispositif prévoit des garanties qui en assurent sa conformité à la Constitution. D’abord, la proposition de loi traduit simplement le droit européen : sa transposition est une obligation pour la France et le Conseil constitutionnel prévoit, à ce titre, un examen de constitutionnalité restreint ».

Ensuite, ajoute-t-elle, « le périmètre matériel de l’infraction n’est pas le même que celui qui avait été retenu dans la loi Avia. La nature des contenus à caractère terroriste est précisément définie, tant dans notre code pénal que dans le règlement européen ».

Enfin, « le champ d’application du texte est plus clair juridiquement, d’autant plus que seuls les contenus manifestement illicites sont visés », ce qui n’était pas le cas avec la proposition de loi Avia. « En cas de non-respect des obligations administratives à la charge des hébergeurs, la proposition de loi ne prévoit pas de sanction immédiate, mais d’abord une mise en demeure ».

En outre, conclut-elle, « s’agissant des obligations de retrait de contenus, la première notification est soumise à une information préalable de l’hébergeur au moins douze heures avant l’injonction. L’ensemble de ces éléments contribue à sécuriser ce texte et garantit à mon sens sa constitutionnalité ».

Des arguments qui n’ont pas convaincu tous les députés lors des discussions en commission des lois. « Je ne vois pas en quoi l’article unique de cette proposition de loi est conforme aux prescriptions du Conseil constitutionnel » a persisté Philippe Latombe.

Laetitia Avia est venue en renfort pour soutenir que ce règlement propose bien plus de garanties que son propre texte lourdement censuré : le règlement « définit les contenus à caractère terroriste » et il prévoirait un recours suspensif, assure-t-elle.

Le rapport d'Alexandre Linden, à la CNIL, relève pour sa part que « des mécanismes de réclamation sont prévus pour rétablir des contenus retirés par erreur, après vérification ». En somme, les recours ne seraient pas suspensifs. Même analyse à la Quadrature du Net.

Les chiffres du blocage administratif

Au fil des échanges sur cette proposition relative à la lutte contre le terrorisme, les chiffres des retraits administratifs ont été fournis. L’Office central de lutte contre la criminalité liée aux technologies de l’information et de la communication (OCLCTIC) a ainsi reçu en 2020 plus de 289 000 signalements depuis sa plateforme Pharos.

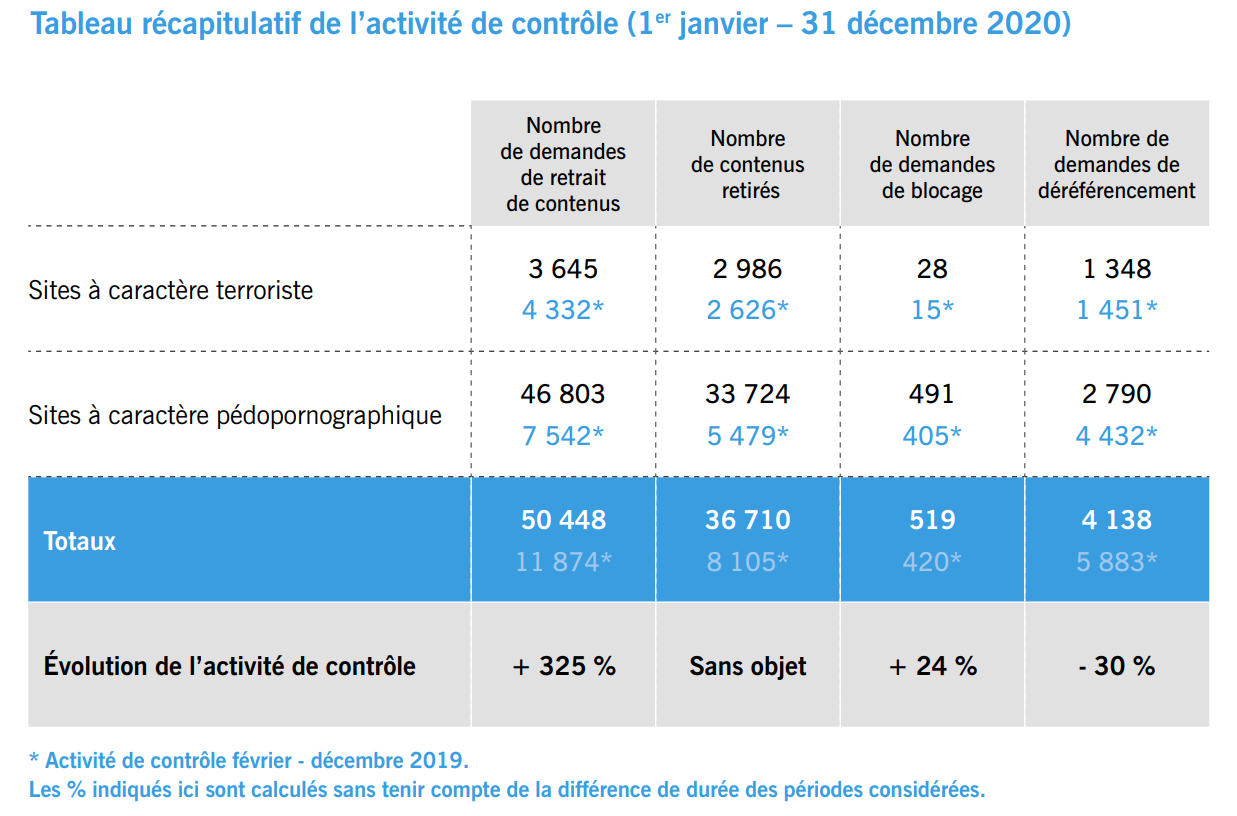

La même année, l’OCLCTIC «a formulé plus de 50 000 demandes de retrait, 500 demandes de blocage et plus de 4 100 demandes de déréférencement » a détaillé la députée LREM Aude Bono-Vandorme, rapporteure de la proposition de loi.

Cependant, une telle présentation est loin d’être assez précise, dans la mesure où s’inscrivant dans un débat sur la lutte contre le terrorisme, elle pourrait faire croire que l’intégralité de ces demandes administratives relève de ce champ.

Pour obtenir les vrais chiffres, ventilés, il faut se pencher non sur ces échanges, mais sur le rapport dressé par la personnalité qualifiée de la CNIL.

Page 8 du dernier rapport annuel portant sur 2020, on découvre que sur 50 448 demandes de retrait, 3 645 ont concerné les sites à caractère terroriste et 46 803 les sites à caractère pédopornographique. Pour le blocage : 491 demandes ont visé des sites « pédo », contre 28 pour les sites à caractère terroriste.

Commentaires (12)

#1

On sait tous que le “contenu terroriste” va glisser en “contenu qui ne plait pas au poudré”. Triste époque pour la liberté d’information et d’expression.

#1.1

C’est pour ça que les modérations ont besoin d’un peu de temps. Pour vérifier si oui ou non c’est terroriste, illicite ou autre. C’est n’est pas toujours évident.

#2

« tout État membre de l’Union pourra intervenir sur des contenus, alors que

nous n’avons pas tous le même rapport à ceux-ci. Il ne faudrait pas que des choses

auxquelles nous sommes très attachés, comme le blasphème ou la caricature, puissent

être censurées au nom même des principes de certains États membres. Il serait paradoxal

de vouloir lutter contre le terrorisme ou l’incitation au terrorisme en ligne et que cela se traduise

par des sanctions contre ceux qui en sont victimes – par exemple Charlie Hebdo ».

#3

c’est assez incroyable de se coller volontairement des œillères et de refuser de voir les énormes dommages collatéraux que cette loi porte. n’importe qui pourra être automatiquement censuré en 1h en abusant d’un système qui sera à l’évidence automatisé.

ah c’est sûr, après examen on pourra rendre à nouveau disponible le contenu, mais le mal sera fait.

#4

Ben en même temps ça arrangerait bien le pouvoir de censurer certaines choses sous des motifs fallacieux…

Aussi bien Macron que n’importe quel dirigeants que la France a eu ou aura.

Mais clairement ce voilé autant la face est ahurissant : plus que le risque de censure , c’est s’exposer à des moyens de pression diplomatique d’autres état membre (par exemple censurer Charlie Hebdo) et donc possiblement influer la position de l’état sur des directives européennes importantes.

C’est vraiment jouer avec le feu

#5

Du point de vue des dirigeants c’est un très bel outil.

Le fait que ce soit la transposition d’une loi européenne en dis surtout long sur leurs initiateurs, et sur la faiblesse des mécanismes légaux censé juguler ces dérives.

Un autre point qui est intéressant c’est de mettre en parallèle la RGPD (qui est l’une des directive les plus protectrices des citoyens contre les entreprises) et cette loi (et les autres du même acabit) qui autorisent les gouvernements à censurer sans boucle judiciaire.

=> Pour moi ça montre une certaine vision paternaliste, voire bergère des dirigeants (et je pense ici particulièrement aux très nombreux fonctionnaires non élus, mais pas uniquement) envers la population.

C’est un point de vue qui se défends , mais j’aurais quand même aimé qu’il soit débattu.

#6

Il faudrait que ce genre de contenu censuré soit inscrit sur une liste, et transmis en temps réel aux média. Ainsi, cela pourrait faire un garde-fou à de la censure politique, dérive qui a eu lieu dans tout les pays ayant mis en place ce genre de censure administrative (Australie, …).

#7

Maintenant que cette connerie est passée au niveau de l’U.E., on l’a dans l’os…

Il reste à espérer qu’un gros truc mettra le feu, genre un site important, légitime et avec pignon sur rue censuré par une de nos trop nombreuses demokratures européennes, et que cela permettre de se rendre compte d’à quel point on est occupés à s’enfoncer dans les pratiques abusives et totalitaires.

#7.1

Maintenant que cette connerie est passée au niveau de l’U.E., on l’a dans l’os..

en effet, ça va être difficile

à moins qu’ils épinglent par erreur une grosse boîte

genre “Google, Amazon,” etc.. qui EUX s’auront se défendre !

#8

Comme lorsqu’une plainte DMCA avait demandé à déréférencer Wikipédia et VLC dans Google ?

#9

Ça alors, je suis d’accord avec une affirmation de Laetitia AVIA : il ne faut pas se tromper de sujet. Le retrait d’un contenu dans un délai d’une heure n’est pas le fait d’un algorithme. Le retrait algorithmique est un retrait préventif, qui a lieu avant tout signalement. Lorsqu’un contenu est retiré à la suite d’un signalement, ce n’est pas le fait d’un algorithme »,

En effet, c’est l’autorité administrative qui émet une injonction de retrait d’après ce projet de loi.

Et aussi quand elle dit que le règlement « définit les contenus à caractère terroriste », mais pas quand elle dit que le recours est suspensif.

#10

Tout de même