Lancée sur une stratégie open source et communautaire, la startup française cherche à développer sa monétisation grâce à des services d’inférence et d’entrainement des modèles. Nous nous sommes entretenu avec Julien Chaumond, CTO (directeur technique) et cofondateur de Hugging Face.

L’histoire de Hugging Face a commencé il y a environ deux ans et demi, quand elle a lancé sa bibliothèque Transformers. Dédiée au traitement du langage naturel (NLP, pour Natural Language Processing) et open source (licence Apache 2.0), elle fonctionne avec PyTorch et TensorFlow 2.0.

Elle est rapidement devenue une référence. La devise de l’entreprise est d’ailleurs « Solving NLP, one commit at a time » (Résoudre le NLP, un commit à la fois). Elle lève aujourd'hui 40 millions de dollars. Mais pour quoi faire ?

De Transformers aux offres payantes

Avant d’aller plus loin, évoquons rapidement deux notions importantes : l’entrainement et l’inférence. Le premier consiste à présenter des informations déjà étiquetées, par exemple des photos de chats. On obtient alors un modèle. Plus on entraine, plus il devient efficace. L’inférence consiste à appliquer ce modèle entrainé à des informations non étiquetées. Il est alors chargé de créer des relations et de repérer tout seul ce qu’on lui a appris (sur la base de références). Cela peut aussi bien servir pour identifier des oiseaux que repérer du spam.

Depuis sa création, Transformers a récolté plus de 40 000 étoiles sur GitHub et compte plus de 6 000 contributeurs. Elle est aujourd’hui le cinquième projet le plus actif sur GitHub. Elle a d’abord surtout attiré des scientifiques, puis des ingénieurs pour des applications plus concrètes et optimisations en fonction de besoins spécifiques. Elle dispose aujourd’hui d’une bonne abstraction et peut être utilisée par des développeurs plus généraux.

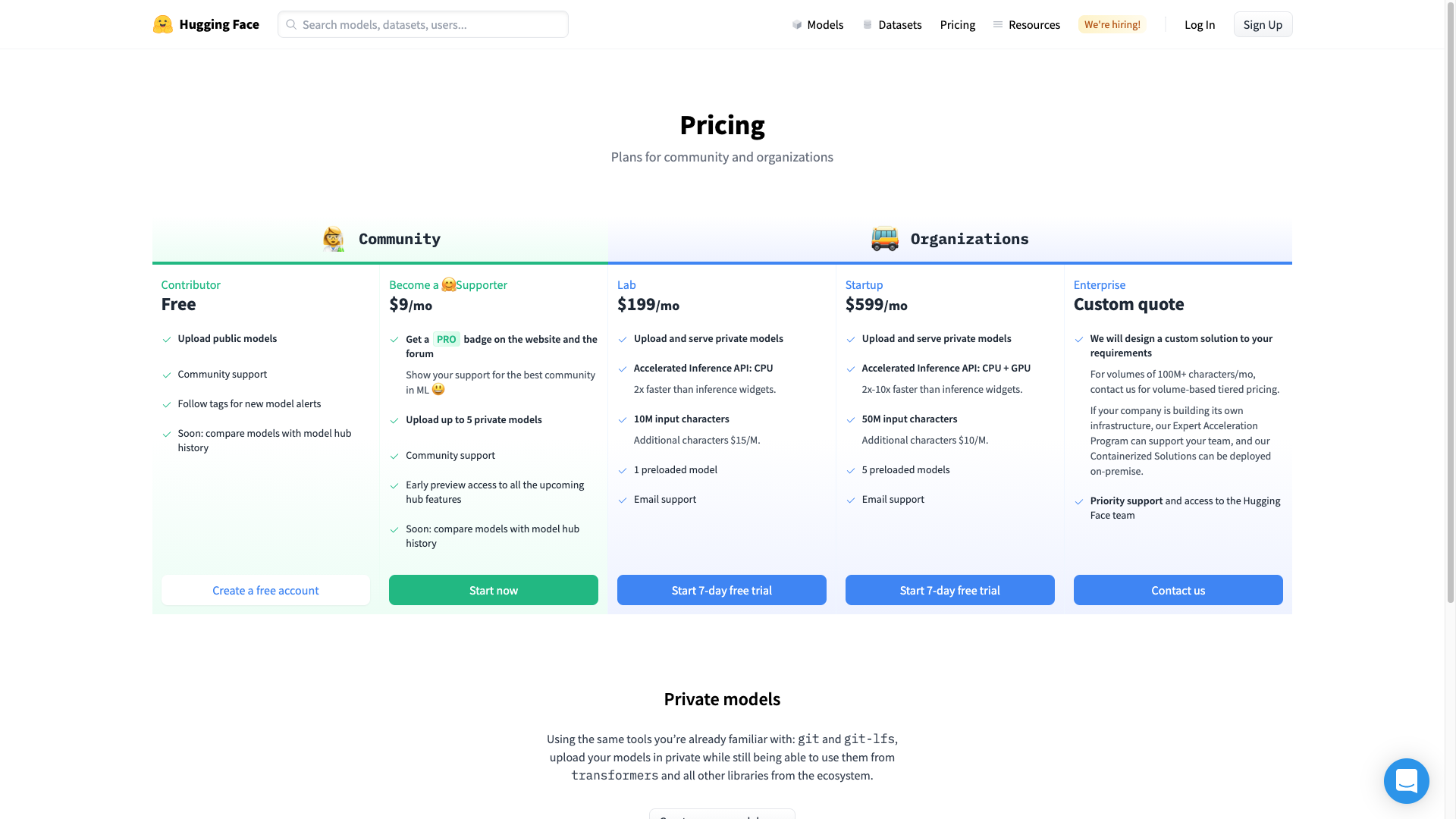

Hugging Face s'est depuis aussi fait connaître pour son hébergement de modèles. Toute personne physique ou morale peut venir créer un compte et en importer, pour les partager, recueillir des avis ou profiter des services fournis par l'entreprise. Le site a ainsi évolué vers une solution d’hébergement communautaire et open source pour modèles de tous poils, avec services payants pour les entreprises aux besoins plus importants.

Ces services sont de plusieurs types. Principale différence avec la formule gratuite : l’importation de modèles privés. Une structure peut vouloir garder secrets ses travaux, qu’il s’agisse ensuite de les rendre publics ou de les garder pour elle. Mais Hugging Face propose également de réaliser des opérations d’inférence, dont les performances dépendent du niveau de souscription. Dans les offres pour entreprises, elles vont de x2 à x2-10, la comparaison se faisant par rapport à la version purement open source hébergée par l'utilisateur.

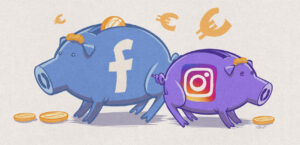

Le service servant au stockage des modèles possède actuellement 100 000 utilisateurs actifs et compte 5 000 entreprises réparties entre formules gratuites et payantes. Parmi ces dernières, on trouve notamment Facebook, Google et Microsoft (qui l’utilise pour Bing notamment).

40 millions de dollars de plus dans l’escarcelle

L’entreprise avait déjà levé 15 millions de dollars, mais, comme nous l'indique Julien Chaumond, « 90 % de la somme sont toujours sur nos comptes ». Pourquoi dès lors lever 40 millions de dollars supplémentaires (série B) ? Parce que Hugging Face a de vastes projets : il veut devenir le « GitHub du machine learning »,

Plus concrètement, il s'agit principalement de l’expansion des services monétisés de l’entreprise, sans toucher à la partie communautaire. Le modèle est semblable à GitHub (d'où la comparaison), avec une solide partie gratuite et des services spécifiques pour des besoins plus importants ou spécifiques.

La levée a été menée, par Lee Fixel (fond Addition) ainsi que les trois investisseurs historiques : Lux Capital, A.Capital et Betaworks. Des investisseurs français ont répondu à l’appel, notamment Olivier Pomel (cofondateur et CEO de Datadog), Florian Douetteau (CEO de Dataiku), Thibaud Elzière, Clément Benoit, Nicolas Steegmann, Anh tho chuong ou encore Ludovic Huraux.

À quoi vont servir exactement ces 40 millions ? Julien Chaumond nous répond : « Notre première action sera d’embaucher pour tripler la taille de l’équipe actuelle. Nous avons pour l’instant une trentaine de personnes, dont un peu plus de la moitié à Paris. Nous comptons embaucher 30 à 40 personnes en France d’ici la fin de l’année, avec des profils très différents : ingénieurs, scientifiques, commerciaux, support, etc. »

Hugging Face veut mettre une équipe renforcée pour s’occuper de la clientèle payante. Les offres vont d’ailleurs se développer, car en plus de proposer un service d’inférence, l’entreprise proposera bientôt un service d’entrainement des modèles NLP. Ce n’est d’ailleurs pas un mystère : un lien est disponible sur la page d’accueil du site et propose de s’inscrire sur liste d’attente pour être averti de sa disponibilité.

Selon le directeur technique, 4 000 demandes ont déjà été faites.

« Nous proposerons d’abord uniquement une interface en ligne de commande. Les clients pourront entrainer leurs modèles et comparer les performances. Le service pourra trier les modèles selon plusieurs critères comme les performances, la précision, etc. Nous proposerons d’optimiser ces modèles pour de meilleures résultats », ajoute Julien Chaumond. Actuellement, la gestion de modèles privées est prisée par une centaine d’entreprise, dont Grammarly, Typeform, Intel et Qualcomm, et le service d’inférence par une cinquantaine.

Le responsable nous confirme d’ailleurs que l’un des objectifs de la nouvelle équipe renforcée sera de faire grossir ces chiffres. Et concernant le service d’entrainement des modèles ? « Nous en espérons beaucoup », déclare-t-il, sans plus de détails. Hugging Face a également pour projet d’élargir son horizon vers un machine learning plus général. Ce développement se fera cependant autour de la communauté et de manière « organique ».

Comprendre que cette extension sera progressive, selon les demandes exprimées. Le processus commence tout juste, avec « quelques premiers clients en inférence audio et computer vision, mais ça reste petit pour l’instant ».

Commentaires (4)

#1

HF fait du beau boulot, c’est une belle startup avec un beau modèle. Bravo à l’équipe.

#2

Connaissant la nature humaine et l’expérimentation de Microsoft qui avait laisser le public entrainer un modèle, j’espère qu’il ont prévu des sécurités pour éviter les images inappropriées ou des tags ne correspondant pas à l’image.

#3

gros risque de se faire copier/voler par github non ?

#3.1

Microsoft rachète facilement quand elle galère. 1. Start up, 2. Cash In, 3. Sell Out, 4. Bro Down