L'intelligence artificielle est un vaste sujet qui touche de nombreux domaines : les jeux, la reconnaissance d'images et de la voix, la publicité ciblée, etc. Elle n'en est pourtant qu'à ses débuts et l'avenir s'annonce riche en « nouveautés », notamment avec une possible intelligence artificielle forte. Est-ce un danger ou bien une aide pour l'humanité ?

C'est fait : une machine a battu à plate couture (4 à 1) l'un des meilleurs joueurs de Go au monde, Lee Sedol. Comme nous l'avions déjà expliqué, il s'agit d'une intelligence artificielle qui porte le nom d'AlphaGo (créée par DeepMind, une filiale de Google) et qui utilise des réseaux de neurones avec de l'apprentissage profond. Cette victoire arrive plus tôt que ne le pensaient certains et soulève des questions sur les prochaines évolutions de l'intelligence artificielle.

Sera-t-on bientôt aux portes de films de science-fiction comme Ex Machina, I, Robot ou Terminator pour ne citer que ceux-là ? Pour reprendre une phrase de Laurent Alexandre, spécialiste de l'intelligence artificielle et chef d'entreprise, « on a dit tellement de conneries en matière d'intelligence artificielle et de robotique qu'il faut être prudent ». Nous avons donc décidé de faire le point sur le chemin parcouru depuis les années 80, en ayant les yeux tournés vers l'avenir d'ici 2050 et au-delà.

Une intelligence artificielle, c'est quoi ?

Avant toute chose, commençons par le rappel de quelques fondamentaux : qu'est-ce qu'une intelligence artificielle ? D'après le Larousse, il s'agit d'un « ensemble de théories et de techniques mises en œuvre en vue de réaliser des machines capables de simuler l'intelligence humaine ».

Yann Ollivier, chercheur au CNRS spécialisé dans l'intelligence artificielle, expliquait lors d'une émission Bibliothèque Médicis présentée par Jean-Pierre Elkabbach, qu'une intelligence artificielle doit « comprendre des situations humaines et réagir aussi intelligemment ou bêtement que le ferait un humain... parce qu'un humain ce n'est pas toujours très intelligent ».

Des réseaux de neurones...

Pour arriver à mettre artificiellement de l'intelligence dans un programme, il existe plusieurs méthodes, mais la plus couramment utilisée consiste à exploiter des réseaux de neurones. Le chercheur en donne la définition suivante : « Les réseaux de neurones artificiels ont pour objet de reproduire le genre de capacités que l'on observe chez l'humain. On essaye d'avoir le même principe, sans forcément mimer la biologie ».

Leur but est de mémoriser des informations (en très, très grandes quantités) afin de classifier des éléments. Par exemple, on peut montrer des milliers (voire des millions) d'images de chaises à un programme informatique afin qu'il « apprenne » ce que c'est. Ensuite, il devrait être capable d'en reconnaitre une sur une photo ou une vidéo, du moins avec une marge d'erreur acceptable. Une opération que l'on peut reproduire pour tous les objets de la vie courante, mais aussi pour les mots et tout ce que l'on peut finalement quantifier.

... à l'apprentissage profond

Lors d'une conférence à l'USI (voir vidéo ci-dessous), le français Yann LeCun, patron de l'intelligence artificielle chez Facebook, expliquait que « pour de la reconnaissance d'images ou de la parole, on a quelques centaines de millions de boutons à ajuster [NDLR : soit autant de paramètres], ce sont vraiment des systèmes de grandes tailles. On a quelques millions ou quelques milliards mêmes d'exemples pour s'entrainer, des milliers de catégories et reconnaitre chaque objet prend quelques milliards d'opérations ».

Smartphone à la main, il propose une petite démonstration avec un programme maison qui tourne sur un portable taillé pour du jeu afin de disposer d'un gros GPU. La vidéo tourne à environ 5 ips et chaque reconnaissance demande 5 milliards d'opérations.

Pour en savoir plus sur les méthodes algorithmiques utilisées par l'apprentissage profond, on ne peut que conseiller de regarder cette vidéo d'environ 45 minutes. Pas d'inquiétude, malgré la présence de quelques formules mathématiques qui ne sont pas forcément compréhensibles par tout le monde, la grande majorité de la conférence est accessible :

Des méthodes déjà utilisées dans les années 80/90

Ces techniques ne sont par contre pas nouvelles et elles étaient déjà utilisées dans les années 90. Le problème était alors la limite de la puissance des ordinateurs, ainsi que la quantité de données disponibles pour l'apprentissage. Cela n'a pas empêché Yann LeCun de mettre sur pied un programme capable d'identifier des chiffres dès le début des années 90, en utilisant par contre une puce dédiée aux traitements du signal (20 millions d'opérations par seconde à l'époque).

Un avis partagé par Laurence Devilliers, spécialiste des émotions dans l'intelligence artificielle, également présente dans l'émission Bibliothèque Médicis : « J'ai l'impression que l'on n'a pas fait tant de progrès que cela. On combine plusieurs algorithmes de type apprentissage profond, ou des techniques qui sont très à la mode en ce moment, avec des techniques qu'on utilisait déjà dans les années 80 qui sont du renforcement d'apprentissage ».

Ce qui a par contre changé depuis les années 80, c'est la quantité de données accessibles aux géants du Net pour entrainer et développer une intelligence artificielle.

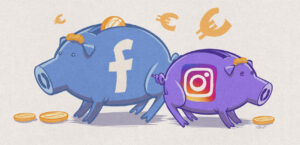

Les GAFA profitent de vos données pour éduquer leur IA

Pour mener à bien ce genre d'opérations, il faut en effet disposer d'une quantité astronomique de données (qui se chiffre en millions ou en milliards), ce qui est le cas des GAFA (Google, Apple, Facebook, Amazon et Microsoft entre autres) qui peuvent profiter des images, des messages et des autres contenus déposés chaque jour par centaines de millions d'utilisateurs. « Toutes les informations que nous mettons sur Facebook, sur Google, toutes ces données-là sont très utiles pour éduquer l'intelligence artificielle » explique Laurent Alexandre.

À titre d'exemple, Yann LeCun (responsable de l'intelligence artificielle chez Facebook, pour rappel) annonçait en juillet 2015 que les utilisateurs du réseau social de Mark Zuckerberg téléchargeaient 600 millions d'images par jour sur Facebook. Si on ajoute les autres applications comme WhatsApp et Instagram, on arrive à un chiffre décoiffant de 2 milliards.

« En moins de deux secondes, chacune des 600 millions de photos est envoyée à deux réseaux cognitifs, un qui fait l'identification des objets dans l'image pour faire le tri et l'association en fonction de l'intérêt des gens, et un autre qui fait la reconnaissance des visages », sauf en Europe depuis maintenant plus de trois ans.

Ce n'est pas forcément une surprise, mais l'une des applications de l'intelligence artificielle est de proposer de la publicité ciblée en fonction des centres d'intérêt des utilisateurs, le nerf de la guerre pour bon nombre de géants du Net. Ces derniers se préparent d'ailleurs à une évolution importante : personnaliser notre expérience (au sens large du terme) en fonction de nos émotions et de celle des gens qui nous entourent. Bref, l'intelligence artificielle est déjà partout et le moindre contenu que l'on dépose est consciencieusement analysé, décortiqué et catalogué.

Dans les méandres du Big Data et de la gestion des données personnelles, Google tente de jouer la carte de l'ouverture, du moins en apparence. Si une partie des algorithmes utilisée par DeepMind est librement accessible, ce n'est pas le cas des données utilisées pour entrainer les réseaux de neurones. Or, les données sont le nerf de la guerre car sans elles, point d'intelligence artificielle.

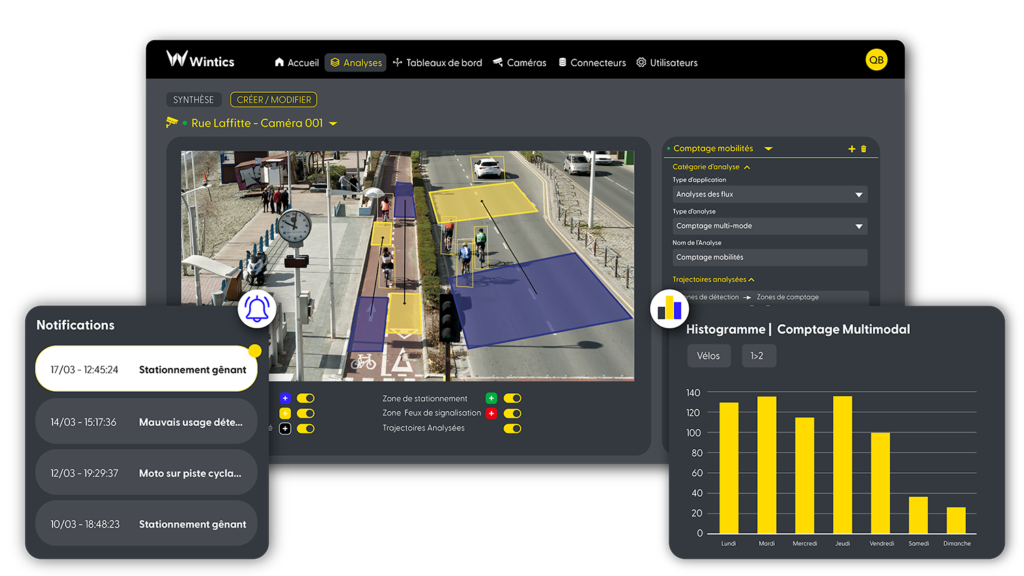

Contrôle parental, voiture, médecine : l'intelligence artificielle est déjà omniprésente

L'intelligence artificielle et l'apprentissage profond sont donc déjà largement utilisés dans notre vie quotidienne et pas uniquement pour la publicité ou la reconnaissance d'images. Les filtres pour le contrôle parental peuvent ainsi l'exploiter pour estimer si une page propose des contenus pornographiques ou potentiellement choquants. Dans tous les cas, il « suffit » de disposer de suffisamment de données pour construire un modèle dont les résultats sont fiables... dans une certaine mesure.

On peut également citer les voitures intelligentes capables de détecter un piéton ou un danger, ainsi que les véhicules autonomes comme la Google Car. Cette dernière a déjà réalisé des millions de kilomètres, mais elle vient seulement d'avoir son premier accident, où Google reconnait d'ailleurs avoir une responsabilité. Ironie de l'histoire, c'est en voulant « faire comme les conducteurs humains » que l'accrochage a eu lieu.

Lors d'un changement de file, la voiture autonome pensait en effet que le bus allait la laisser passer, tandis que le bus pensait que la voiture n'allait pas s'engager sur la voie... « c'est ce type de malentendu qui se passe tous les jours entre les conducteurs humains ». Bref, un comportement aussi intelligent ou bête qu'un humain, on est donc bien en face d'une intelligence artificielle selon la définition de Yann Ollivier.

On peut également imaginer que les autoroutes en viennent à se transformer comme dans Minority Report, avec une intelligence artificielle centrale qui s'occupe de la répartition des véhicules. Les hommes n'ont plus rien à faire, si ce n'est profiter du paysage.

Même chose pour la manutention où l'on peut imaginer qu'un robot comme Atlas de Boston Dynamics soit doté d'une intelligence artificielle afin de réaliser certaines tâches en autonomie.

Bien évidemment, c'est dans les domaines où les informations sont très nombreuses que l'intelligence artificielle montre pour le moment tout son potentiel. Par exemple, l'analyse des données des malades du cancer (20 000 milliards d'informations par patient), ne pourrait pas être réalisée individuellement par un médecin, pour chaque personne. Néanmoins, Laurent Alexandre ajoute que les machines sont « encore très loin d'atteindre les médecins dans la synthèse ». Cela pourrait éventuellement être le cas un jour, mais probablement pas avant 2030 ou 2040.

Quand l'intelligence artificielle fait des opérations mathématiques sur... du texte

Des évolutions sont bien évidemment en marche, notamment sur la reconnaissance de langage naturel, avec un chamboulement qui pourrait bien se préparer : « l'identification de mots ou de texte par des vecteurs fixes sur lesquels on peut faire des opérations » explique Yann LeCun. Par exemple, on associe Beijing à la Chine, Paris à la France et du coup on peut réaliser l'opération suivante : « Beijing - Chine + France = Paris », logique non ? Cette méthode pourrait être utilisée pour relier des questions et des réponses entre elles afin de « faire des systèmes qui répondent à n'importe quelle question ».

La traduction de phrases d'une langue à une autre en profite également : « on prend un texte en anglais, on le passe dans un réseau récurent, qui extrait un long vecteur qui représente le sens de la phrase, et ensuite un autre réseau récurrent régurgite la phrase dans une autre langue, par exemple le français ». Cette solution a des performances un peu plus élevées que les systèmes actuels, mais n'est pas encore largement utilisée, car elle demande plus de puissance de calcul et revient donc plus chère. Néanmoins, pour Yann LeCun, « il est probable que d'ici peu les systèmes de traduction automatique soient basés sur des réseaux de neurones ».

Quoi qu'il en soit, toutes les intelligences artificielles qui existent aujourd'hui (sans exception) sont dites supervisées, c'est-à-dire qu'il faut leur donner des informations pour qu'elles apprennent. Il n'est pas encore question d'une intelligence artificielle qui puisse apprendre par elle-même, simplement en observant le monde, comme le ferait un enfant par exemple.

Si malgré cela l'intelligence artificielle peut être très forte et dépasser l'humain sur certaines tâches, il en reste encore de nombreuses où elle n'arrive même pas à la cheville d'un jeune enfant. Microsoft abonde d'ailleurs dans ce sens avec son projet AIX.

Les limites actuelles de la machine

Olivier Teytaud, toujours lors de l'émission Bibliothèque Médicis, explique ainsi que « la machine est très douée sur les questions très difficiles. Vous lui posez une question de relativité générale, elle va chercher sur Internet, elle trouve une réponse très profonde sur le temps, l'espace, la matière ». Elle sera probablement complètement perdue sur des sujets pourtant triviaux pour quasiment n'importe qui. Un exemple tout bête : demander à une intelligence artificielle si « les hippopotames jouent au ping-pong ? »

D'autres domaines sont également hors de portée de l'intelligence artificielle pour le moment : résumer un livre, produire une synthèse de documents, avoir des sentiments (et pas uniquement de l'empathie), rêver, avoir des réflexions philosophiques, etc. Impossible également de demander à une intelligence artificielle d'inventer quelque chose de « joli » ou d'harmonieux par exemple. Il s'agit de concept difficile à appréhender.

Yann LeCun partage cette vision : « il y a pour le moment certaines choses que l'on ne sait pas faire, qui sont vraiment essentielles, pour pouvoir construire des machines plus intelligentes. Il y a un mode d'apprentissage en particulier qui est non supervisé », c'est-à-dire sans que l'on soit obligé de donner le nom de chaque objet des millions de fois à la machine. En effet, « on apprend la nature et la structure du monde de manière spontanée, simplement en vivant dans le monde », contrairement aux machines. Problème, on ne sait même pas comment implémenter cela dans une machine.

Une intelligence artificielle forte verra-t-elle le jour ?

Une intelligence artificielle avec un apprentissage non supervisé n'est pour autant pas à exclure définitivement, et cela pourrait arriver un jour. Pour autant, il faudra probablement attendre plusieurs décennies, et pas avant 2050 selon plusieurs spécialistes. Il serait alors question d'une intelligence artificielle forte, capable de penser, d'avoir conscience d'elle-même, d'avoir des projets, etc. Nombreux scientifiques s'accordent à dire que ce sera possible un jour, mais pas de suite. Pour d'autres, c'est une chimère.

Selon Laurence Devilliers, « sans corps et sans vivant à l'intérieur d'un robot on ne pourra pas faire ça ». Une phrase que l'on peut mettre en parallèle d'une déclaration d'Elon Musk (patron de Tesla et SpaceX) : « J'espère que nous ne sommes pas uniquement un boot loader pour une superintelligence artificielle. Malheureusement, cela est de plus en plus probable ».

Hope we're not just the biological boot loader for digital superintelligence. Unfortunately, that is increasingly probable

— Elon Musk (@elonmusk) 3 août 2014

Si l'intelligence artificielle progresse et, même si on arrive à une IA forte, il n'est pour le moment pas possible de savoir où cela s'arrêtera. Arrivera-t-on à créer une machine qui soit plus intelligente que l'humain sur tous les domaines ? La question reste ouverte pour le moment, et probablement encore pour de longues années.

Il faut que le monde et les politiques décident d'une orientation

Quel que soit l'avenir, avec une intelligence artificielle forte ou non, les différents scientifiques et spécialistes présents à Bibliothèque Médicis veulent qu'un grand débat s'ouvre rapidement sur l'IA, au niveau mondial. Les enjeux sont importants et cela aura des conséquences pour tout le monde ; certains parlent d'ailleurs d'un « changement de civilisation ».

Si les voitures autonomes débarquent en masse (ou plutôt quand elles arriveront en masse), que se passera-t-il pour les milliers, voire les millions de chauffeurs ? Organiser une reconversion générale ne sera pas facile. Mais il ne s'agit que d'un exemple et d'autres secteurs seront également impactés à plus ou moins longue échéance. Certains sont d'ores et déjà identifiés, d'autres non.

Le risque est donc d'avoir d'un côté des personnes hautement qualifiées qui peuvent accéder à des emplois dans la robotique et de l'autre le reste de l'humanité. D'autant plus qu'on peut imaginer que les robots se construisent eux-mêmes un jour, réduisant de plus en plus le besoin pour l'homme d'intervenir dans le processus.

Pour d'autres, l'avenir s'annonce sous de meilleurs hospices puisque les robots effectueront toutes les tâches ingrates à notre place, des scénarios déjà mis en avant dans de nombreux films de science-fiction. Mais là encore qui fournira les robots ? Seulement deux ou trois sociétés au monde qui se partageront le pactole ? Impossible à dire pour le moment.

Gille Babinet, « digital champion » de la France à la commission européenne, abonde dans ce sens et dresse un portrait assez sombre en cas d'immobilisme de la société : « Il faudrait ainsi souhaiter qu’émerge un débat sur le rôle que nous souhaitons confier aux machines : soit permettre de libérer l’homme du taylorisme et l’aider à conjurer définitivement les cauchemars malthusiens (il nous faut nourrir 11 milliards d’individus dès 2050) et sur un tout autre plan, explorer de nouveaux horizons de conscience, soit la victoire de la vision – glaçante – des transhumanistes et la soumission de l'humanité aux robots. Choix qui pourrait s'imposer si nous laissions place à l'émergence d'une innovation sans débat ».

Cynique et provocateur comme à son habitude, Laurent Alexandre évoque pour sa part un sujet sensible qui fait débat aux États-Unis : « faut-il autoriser la pédophilie robotique ou faut-il l'interdire ? ». Même si les robots sexuels avec de l'intelligence artificielle ne sont pas encore là, la question commence déjà à remonter à la surface...

Quelle que soit la manière d'aborder la question, il apparait comme important de se saisir de ce sujet dès maintenant, au plus haut niveau, afin de définir des lignes directrices. Mais cela ne sera pas facile de faire bouger la classe politique sur ce genre de questions, qui en dépassent bien souvent certains.

Il faudrait également que l'école avance davantage sur la robotique et l'intelligence artificielle car cette dernière sera encore plus présente pour nos enfants qu'elle ne l'est pour nous. Si l'algorithmique commence à faire son nid, la mise en pratique n'est pas simple dans de nombreuses écoles par faute de moyens et/ou de formations spécialisées des enseignants.

Skynet est-il à nos portes ? Et dans quelques dizaines d'années ?

Maintenant que l'on a pu voir comment les robots et l'intelligence artificielle pouvaient nous aider et quelles sont les dispositions que l'on doit prendre, il est temps d'envisager une autre possibilité : quid de l'intelligence artificielle dans des robots tueurs ? C'est déjà plus ou moins une réalité avec des drones capables de trier les civils des assaillants hostiles afin de lancer une frappe aérienne... mais toujours avec une marge d'erreur malheureusement.

Les robots militaires sont également de plus en plus performants et, malgré une lettre ouverte demandant l'arrêt de fabrication de ce genre d'armes, les choses devraient continuer de plus belle dans les années qui viennent. La question que se posent certains est de savoir si un robot ou un drone peut décider, subitement, de nous attaquer pour on ne sait quelle raison. Pour Yann Ollivier et d'autres scientifiques, la réponse est non : « si l'intelligence artificielle devient hostile avec les capacités qu'on a aujourd'hui, c'est parce que quelqu'un aura fabriqué une intelligence artificielle hostile, volontairement ».

L'expérience Tay de Microsoft peut prêter à sourire, mais elle montre à quel point il est difficile d'anticiper le comportement d'une intelligence artificielle. Pour rappel, celle-ci n'est restée en ligne que quelques heures avant d'être retirée pour aliénation mentale. Elle est désormais de retour, sous surveillance.

Mais que se passera-t-il avec une intelligence artificielle forte, capable d'avoir des envies et des rêves ? Si on lui propose, par exemple, de simplement « faire ce que tu veux » ? À quoi faut-il s'attendre ? Le robot va-t-il prendre du bon temps ? Aider son prochain ? Essayer de devenir le maitre du monde ? Impossible à dire pour le moment et il parait difficile d'envisager toutes les possibilités.

À défaut de connaitre la réponse, « il faut envisager tous les scénarios »

Pour Laurent Alexandre, « personne au monde ne peut dire si l'intelligence artificielle peut dépasser l'intelligence humaine et devenir hostile, c'est un débat entre spécialistes »... du moins pour le moment. Prudent, il ajoute tout de même que, en attendant, « il faut envisager tous les scénarios ». Ce à quoi les autres scientifiques acquiescent.

Pour le moment, deux tendances se dégagent. D'un côté on a des scientifiques qui pensent que les robots pourraient être une grave menace pour l'humanité (Stephen Hawking, Elon Musk et Bill Gates pour ne citer qu'eux). Le patron de Tesla et SpaceX va même plus loin : « Avec l’intelligence artificielle, nous invoquons le démon. Vous savez, ces histoires où vous avez un homme avec un pentagramme, et l’eau bénite, et il fait comme si il pouvait contrôler le démon ? Ça ne fonctionne jamais ». D'autres par contre estiment au contraire qu'il s'agira d'une aide précieuse.

De son côté, Gilles Babinet aurait plutôt tendance à rejoindre le premier groupe : « avec l’émergence de l’intelligence artificielle, le risque serait que ce ne soient plus nos auxiliaires, mais bien que ce soit nous qui en soyons devenus les auxiliaires ». Dans tous les cas, impossible de trancher cette question pour le moment. Il faut attendre et essayer de se préparer au mieux, à tous les niveaux.

Commentaires (61)

#1

Comme d’habitude, l’IA n’est (ou ne sera) qu’un outil (on n’est pas encore au point où une IA serait suffisamment avancée pour exigée la reconnaissance de ses droits en tant que personne). Son acceptation et développement commercial éventuel dépend(ra) de ses utilisations possibles, de sa finalité ou d’un tas d’autres facteurs essentiellement inconnus pour le moment. Et tant qu’on ne les connait pas (personne n’est prophète), je ne vois aucune raison de mettre la charrue avant les bœufs (politiques).

#2

Excellent dossier, merci bien !

" /> Aves ses 3 lois de la robotique (4 même en incluant la loi 0 embrassant l’Humanité), on est tranquilles …

" /> Aves ses 3 lois de la robotique (4 même en incluant la loi 0 embrassant l’Humanité), on est tranquilles …  " />

" />

A propos de la phrase suivante :

Le patron de Tesla et SpaceX va même plus loin : « Avec l’intelligence artificielle, nous invoquons le démon. Vous savez, ces histoires où vous avez un homme avec un pentagramme, et l’eau bénite, et il fait comme si il pouvait contrôler le démon ? Ça ne fonctionne jamais »

=> Ca tombe bien, les démons n’existent pas, donc leur contrôle encore moins … sacré Elon Musk ! Quel bel exemple !

Bon, par contre, aucune mention de Asimov dans l’article

(Je précise : évidemment, je plaisante hein. D’ailleurs même en implémentant ces 3 lois, ça ne suffirait pas … cf. les nombreux romans et nouvelles qu’Asimov a écrit à ce sujet, justement en jouant sur ces 3 lois et les interprétations et situations originales qui pouvaient en être faites.)

#3

Et puis bon, la loi 0 a quand même conduit les robots à rendre la Terre invivable hein ;)

#4

Merci bien pour cet article très intéressant. On voit bien que, comme dit dans l’article, depuis des décennies, ce sujet interpelle l’humain.

Et surtout la remise en cause de la suprématie de l’être humain sur le reste du vivant, notamment dès le jour où l’IA sera égale voire plus performante que l’intelligence humaine et se comportera de la même manière.

#5

Article très intéressant.

Effectivement, le cas de

« faut-il autoriser la pédophilie robotique ou faut-il l’interdire ? »

soulève tout un tas de nouvelles questions.

#6

A mon avis le plus grand danger de l’I.A c’est qu’elle soit créée par des humains qui sont très loin d’être parfaits il me semble… " />

" />

#7

Le problème avec la définition actuelle de l’IA, c’est qu’on parle de caractéristiques/traits humains pour quelque chose qui n’est (ou ne sera) pas humain.

Le terme “intelligence” regroupe tout un tas de caractéristiques comme le raisonnement, la compréhension, l’ambition, la création, la conscience, l’imagination, …

Pour certaines on a déjà des théories/techniques artificielles, et pour d’autre non. Le moment où l’on décidera que “ca y est, on a une intelligence artificielle” est subjectif. En 2014, une machine a réussi le test proposé par Turing. Faut-il se fixer de nouvelles limites ?

#8

La question que se posent certains est de savoir si un robot ou un drone peut décider, subitement, de nous attaquer pour on ne sait quelle raison. Pour Yann Ollivier et d’autres scientifiques, la réponse est non : « si l’intelligence artificielle devient hostile avec les capacités qu’on a aujourd’hui, c’est parce que quelqu’un aura fabriqué une intelligence artificielle hostile, volontairement ».

Donc c’est certain que ça va se produire tôt ou tard. L’homme a toujours cherché la puissance pour soumettre son prochain.

#9

#10

Vaste sujet… Et difficile de se faire une idée, compte tenu des possibilités d’évolution exponentielle qui peuvent apparaître du jour au lendemain (ou pas).

Je note toutefois qu’il y a loin de la coupe aux lèvres :

Yann LeCun partage cette vision : « il y a pour le moment certaines choses que l’on ne sait pas faire, qui sont vraiment essentielles, pour pouvoir construire des machines plus intelligentes. Il y a un mode d’apprentissage en particulier qui est non supervisé », c’est-à-dire sans que l’on soit obligé de donner le nom de chaque objet des millions de fois à la machine. En effet, « on apprend la nature et la structure du monde de manière spontanée, simplement en vivant dans le monde », contrairement aux machines. Problème, on ne sait même pas comment implémenter cela dans une machine.

Le reste n’est que spéculation pour le moment.

#11

Dans ce domaine,l’homme pourra -t-il enfin se débarrasser de la femme? C’est le plus important. Comme ça plus de prise de tête.

L’IA sera à l’image de l’homme avec ses défauts.

#12

#13

#14

Tout ceci est déjà arrivé, et tout ceci recommencera Gaïus…..

En tout cas j’èspère qu’asimov n’aura pas raison au niveau des robots (même si c’est mal partie pour le moment)…. :/

#15

On finira assujetti aux machines programmes, dans une matrice

#16

L’intérêt d’une machine de guerre pseudo-autonome qui décide d’engager le combat est que si elle fait des erreurs, tu peux difficilement l’amener au tribunal ; et quand bien même, tu pourra la condamner à mort sans état d’âme. Tout bénéf pour l’armée, donc.

#17

Personne n’a prétendu que tous les êtres humains étaient intelligents.

#18

Aucun risque tant qu’on a pas trouvé une source d’énergie compacte aussi bien faite que la biologie.

Pour l’instant tous les bidules technos on une autonomie complètement ridicule et une alimentation tellement complexe à réaliser qu’on est loin, mais alors très loin, d’une quelconque intelligence artificielle capable de la compléter.

L’IA est capable de battre n’importe quel humain au jeu de Go. Soit.

Mais elle est pas foutue de planter la betterave qui lui maintiendra son fonctionnement.

#19

#20

Et dire qu’on m’a bâché comme un malpropre quand je citait l’USI et Laurent Alexandre. Sur ce même site !

Putain.

First they ignore you,

then they laugh at you,

then they fight you,

then you win.

Mahatma Gandhi

Note : L’IA ? on va tous en crever si on ne prends pas des mesures maintenant.

#21

Alors que nous apprenons aux machines la complexité et les nuances, nous sommes nous même encore souvent très binaire : intelligent ou pas intelligent, amie ou ennemie… Difficile de se défaire de 2000 ans de manichéisme. Sacré Jésus. Avec tes histoires de bien et de mal, tu as fini par nous mener à une impasse dont nous avons bien du mal à sortir.

Les programmes savent aujourd’hui fait des choses qu’aucun humain n’arrivent à faire et en même temps n’importe quel enfant sera plus doué que le meilleur des programmes sur d’autres tâches. Mais bien des enfants sauraient se montrer plus doué que moi. Alors où est l’intelligence ?

On l’a longtemps défini comme ce qui nous sépare de l’animal. Mais on sait aujourd’hui que la différence est de niveau, pas de nature. De perdons pas le même temps avec des réflexions binaires.

Peu importe que l’IA soit forte ou pas (encore), la question vraiment intéressante est de savoir ce qu’on veut faire d’elle. Quel pouvoir souhaite-on lui donner ?

Pour partir en vacances l’ordinateur peut nous indiquer l’itinéraire le plus rapide, mais pas le meilleur itinéraire. Pas celui où l’on va aimer se perdre. Car faire des choix, faire ses propres expériences, c’est ça vivre.

Alors quels choix voulons nous prendre nous même ?

Quelle est la part de pouvoir que l’on ne veut pas déléguer, pour encore avoir le sentiment d’exister?

Je serais pas en train de parler de démocratie là ?

#22

… dans la cas de la physique quantique (elle va nous amener vers des passerelles révolutionnaires) je dirai oui, là : un peu des deux !

" />

" />

Pour L’IA : juste non, ce n’est pas l’atome, ou la relativité , Google veut sauvegarder notre cerveau . On clone déjà les êtres vivants (c’est en production au Brésil , en argentine pour les bovins …) … je vous laisse faire l’assemblage des deux … !!!

#23

Article qui semble passionnant je lis de suite ….

#24

Sauf qu’en fait dans la réalité on sait déjà plus ou moins le faire. un robot d’il y a quelques années (2009 je dirai) était capable de distinquer les objets et de demander leur nom. Ce qu’un humain fait pour apprendre.

Le véritable problème à l’époque était de faire la relation entre “pomme granny” et une “pomme gala” par exemple, car l’objet était bien différent mais nous n’avons qu’un mot pour le décrire.

Je m’interesse pas mal au sujet et le véritable moment ou on pourra parler d’IA sera le moment ou le robot pourra faire un “euréka” et résolvera un problème en créant de soit même de nouveaux capteurs et pourra de lui même créer un “concept” sur un autre “concept” pour résoudre un problème

(exemple : le robot en utilisant un couteau va apprendre qu’un couteau peut couper des objets tendres de facon régulière.

Il sait que la pomme est tendre et qu’il vaut mieux qu’elle soit en morceau pour qu’un humain la mange facilement.

De là le robot déduire de lui même que si le couteau coupe des choses il peut couper une pomme avec (il aura deja du déduire par le toucher que l’intérieur d’une pomme est “tendre”)

Vu qu’il peut couper la pomme il peut le faire plusieurs fois => morceaux

Pour cela il est n,écessaire de pouvoir mettre en relation des choses qui n’ont pas forcément grand chose à voir, c’est “l’euréka” de l’humain qui est le concept sur lesquels les meilleurs chercheurs en IA s’arrachent les cheveux (et oui mettre tout en rapport avec tout marcherait mais demanderait trop d’essais et de puissances de calcul).

#25

Surtout que tu lui imposes comment à ton intelligence qui pense d’elle-même de respecter les lois de la robotique ? On n’y arrivera pas mieux qu’avec des êtres humains, voire moins facilement puisqu’elle risque d’être plus intelligente…

#26

… un article qui aborde bien le sujet.

Mais je lis :Le risque est donc d’avoir d’un côté des personnes hautement qualifiées qui peuvent accéder à des emplois dans la robotique et de l’autre le reste de l’humanité. D’autant plus qu’on peut imaginer que les robots se construisent eux-mêmes un jour, réduisant de plus en plus le besoin pour l’homme d’intervenir dans le processus.

en tant qu’urbaniste/archi système je peux déjà vous dire que nous y sommes déjà!

déjà en 90 un as/400 s’autoscallait tout seul sur les query. Mieux : installer un serveur virtuellement, un os dessus, installer une pile LAMP, placer un word press … c’est un clic dans un datacenter !

Donc on parle déjà au present…

#27

quelles conneries ?

#28

Merci pour cet article.

Je ne suis pas spécialement intéressé au sujet mais lire un truc de style ça fait plaisir. Ça résume la situation et les enjeux.

#29

#30

un pessimiste est un ‘optimiste’ qui a compris !

#31

”…et un autre qui fait la reconnaissance des visages », sauf en Europe depuis maintenant plus de trois ans.”

Sauf en Europe ?

En effet ça n’apparaît plus chez nous, mais il y a fort à parier que ça passe quand même à la moulinette !

#32

#33

Arrêtons l’anthropomorphisme.

On est déjà foutrement incapable de se mettre dans les baskets de son voisins, alors imaginer le raisonnement d’un processeur…

Quant aux objectifs d’une éventuelle IA, ben je mets ma main au feu que ce seront ceux que le programmeur voudra bien lui donner. Pour nous, c’est le cerveau reptilien qui nous dit de rester en vie, de respirer, de manger etc… Ce n’est pas pour rien que les IA actuelles sont très pointus dans un domaine et un seul, c’est parce que les programmeurs qui l’ont codés l’ont limité à un seul domaine. En gros, oui il faut y penser, mais il faut arrêter de croire que la fin du monde viendra forcément des machines. A mon avis, l’humain reste le meilleur candidat pour le foutre en l’air. Notamment par des upgrade d’ADN foireux par exemple.

#34

« on a dit tellement de conneries en matière d’intelligence artificielle et de robotique

" />

" />

qu’il faut être prudent ».

c’est, aussi, mon avis !

#35

Mouais bon ok, le deep learning et les réseaux de neurones ça fait des trucs cools, mais on est encore très très trèèèès loin d’avoir une IA telle qu’on peut les imaginer dans la science fiction avec une “conscience” et la capacité d’apprendre et réfléchir par soi même.

Nos IA d’aujourd’hui sont plutôt débiles et ne font que ce qu’on leur demande. Le seul “progrès” aujourd’hui, c’est l’évolution du net qui a permis à certaines grosses boîtes d’emmagasiner des quantités astronomiques de données qui n’étaient pas dispo avant. Mais dans tout les cas le maître à bord est l’humain.

Donc pour moi ce qu’il faut craindre aujourd’hui ce sont des humains mal intentionnés qui feraient usage des technos actuelles pour de mauvaises choses ou encore un bug de conception qui aurait des conséquences lourdes (dans l’armement par exemple). Mais dans les deux cas ça reste un problème de source humaine.

Le jour où une machine pourra vraiment “réfléchir” n’arrivera pas de mon vivant je pense (et je suis pas si vieux que ça ^^)

#36

#37

Ce qui me fait rire, c’est qu’on en soit toujours à utiliser la dichotomie entre le corps et l’esprit (Descartes Style, qui date sérieusement).

Sans corps, il ne peut y avoir de conscience, c’est une seule et même chose. Et pas uniquement des gros tas de neurones. Un enfant apprend parce qu’il a froid, parce qu’il a envie de pisser, parce qu’il tombe par terre et se relève et surtout parce qu’il prend le temps de grandir, qu’il dort, rêve etc.

Donc oui, on peut industrialiser des tâches complexes, ce qui est certainement plus dangereux que d’avoir une IA consciente (cf. drones de guerre, traitement des données personnelles…).

Je pense que les humains auront ravagé la planète en toute conscience bien avant une IA consciente.

#38

Pour moi la 1er problématique est d’autre sémantique voir philosophique.

Avant de définir ce qu’est (ou pourra être) une intelligence artificielle. Il faudra pourvoir de manière exhaustive ce qu’est l’intelligence et déj) rien que ce point est sujet à controverse.

Cf Espèce humaine vs reste de la biologie.

Pour moi, en résumant mon humble raisonnement, je dirais que l’intelligence est la capacité de survivre en trouvant des solutions originales.

#39

#40

#41

Cloner le cerveau n’est probablement pas suffisant, il va falloir cloner les neurones de l’intestin (moins nombreux certes) et toutes les bactéries/microbes qui nous asservissent d’une manière ou d’une autre.

#42

#43

#44

je te renvoie à la définition d’un clone.

Sinon ce reportage est pas trop mal :https://www.youtube.com/watch?v=uW5pbviK-vY

#45

#46

#47

#48

#49

Nous sommes dans une ère où l’être humain s’octroie le pouvoir par le biais de l’argent. Comme cela a très bien été relevé dans le tout premier commentaire, l’IA n’est qu’un des multiples outils pour un petit groupe de personnes/multinationales de parvenir à amasser encore plus et pour manipuler encore plus pour maximiser leurs profits. On peut philosopher jusqu’à la fin de nos jours sur l’utilité ou non d’un tel outil, en l’occurrence l’IA, mais pour résoudre ce problème, il faut l’attaquer bien plus en amont:

D’aucuns ont l’arrogance et la prétention de croire aujourd’hui que le salut de l’être humain passe inévitablement par le développement technologique, autrement dit par le développement d’outils.

Donnez un ordinateur neuronal à un nouveau né et il n’en fera rien. Donnez une robot doté d’une IA complète à ce même nouveau né et vous en ferez ce que vous voudrez, vous le formerez à l’image que vous voulez. Donc, il faut en venir aux valeurs de base de l’être humain.

Dans quelle école maternelle publique enseigne-t-on, dans des leçons dédiées, à dialoguer entre être humains, à gérer ses émotions, à gérer les conflits, à développer un sens critique, à collaborer constructivement au lieu de se concurrencer destructivement (etc., etc.) au même titre que les mathématiques, le français ou les sciences?

Ne cherchez pas, là n’est pas le but de l’école publique: nous sommes formatés pour répondre au besoin de notre paradigme économique actuel, c’est-à-dire croissance infinie, consommation à outrance et poursuite illusoire de satisfaction de la cupidité humaine.

En conclusion, le développement de l’humanité doit non pas passer par le développement d’outils extérieurs, mais bel et bien par le développement de l’être humain lui-même: sa mentalité et sa prise de responsabilité par rapport aux conséquences ses actes.

À ce niveau-là, nous n’en sommes guère qu’au tout premiers simulacres de réelle “intelligence humaine”. Alors apprenons d’abord à consolider les bases de notre propre civilisation avant de vouloir jouer avec le feu et jouer les dieux en créant des “êtres à notre image”.

Je vous invite à y méditer.